통합 이미지 위조 탐지를 위한 Forensim: 복제·스플라이스 위조를 동시에 잡는 주의 기반 상태공간 모델

초록

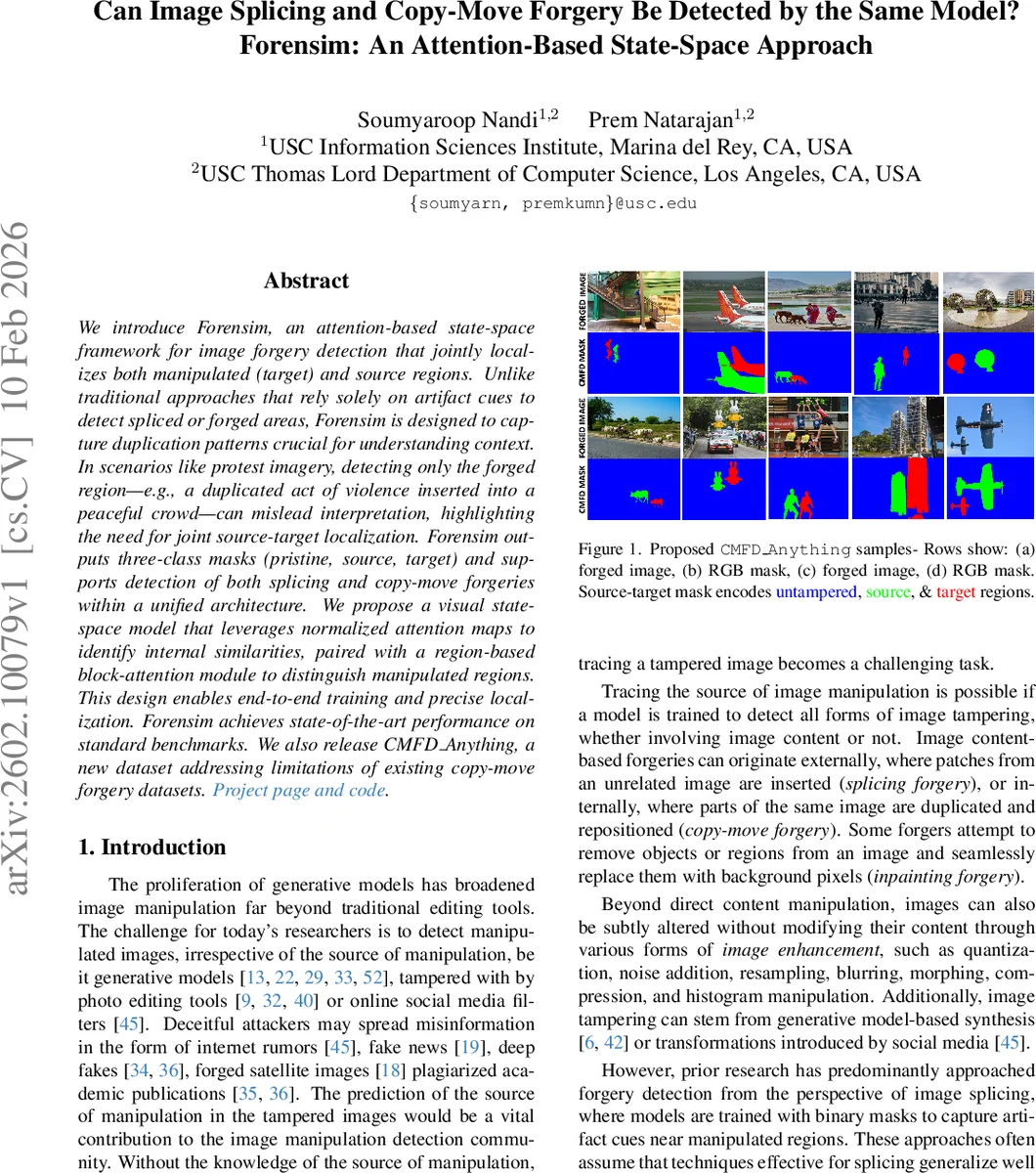

Forensim은 주의(attention)와 상태공간(state‑space) 메커니즘을 결합해 이미지 위조를 세 클래스(정상, 복제 원본, 위조 대상)로 동시에 구분한다. 복제·스플라이스 위조를 하나의 통합 프레임워크에서 처리하며, 새로운 고해상도 데이터셋 CMFD Anything을 공개한다.

상세 분석

본 논문은 이미지 위조 탐지(IMDL) 분야에서 “스플라이스와 복제 위조를 동일 모델로 탐지할 수 있는가?”라는 근본적인 질문에 답하고자 한다. 기존 연구는 주로 압축 오류, 노이즈 패턴 등 인공적인 아티팩트를 이용해 이진 마스크(위조/정상)만을 예측했으며, 복제 위조의 경우 원본 영역을 별도로 표시하지 못했다. Forensim은 이러한 한계를 극복하기 위해 (1) 세 클래스 마스크(정상, 소스, 타깃)를 학습 목표로 설정하고, (2) 시각적 상태공간 모델(VSSM)을 기반으로 한 두 종류의 주의 모듈—Similarity Attention(Sim Attn)과 Manipulation State‑Space Attention(MSSA)—을 도입한다.

Sim Attn은 이미지 내 모든 위치 간의 유사성을 나타내는 N×N 어피니티 행렬을 명시적으로 계산한다. 여기서 N은 픽셀 수이며, RoPE와 ELU 활성화를 통해 공간적 위치 정보를 보강한다. 어피니티 행렬은 거리 기반 가중치 K와 소프트맥스 정규화를 거쳐 최종 유사도 맵을 생성한다. 이 과정은 복제된 영역이 서로 높은 유사도를 보이는 특성을 활용해 소스와 타깃을 구분한다.

MSSA는 다중 스케일 상태공간 블록을 사용해 전역 컨텍스트와 로컬 디테일을 동시에 포착한다. 각 블록은 여러 헤드의 주의를 적용해 고해상도 이미지에서도 선형 복잡도로 연산한다. LePE와 RoPE를 결합해 지역적 위치 인코딩을 강화하고, 최종적으로 MSSA 맵을 통해 위조된 영역을 강조한다. 두 맵(Sim map, MSSA map)은 채널 차원에서 결합되어 디코더에 전달되고, 3‑클래스 세그멘테이션 헤드가 최종 마스크를 출력한다.

학습 측면에서 Forensim은 스플라이스 데이터(이진 마스크)와 CMFD Anything(소스‑타깃 마스크)를 혼합해 다중 태스크 학습을 수행한다. 이는 모델이 아티팩트 기반 특징과 복제 패턴을 동시에 학습하도록 유도한다. 또한, 상태공간 기반 구조는 긴 종속성을 효율적으로 모델링하면서 메모리 사용량을 크게 줄인다.

CMFD Anything 데이터셋은 Segment Anything 프로젝트에서 추출한 고해상도 이미지(>1024×1024)를 기반으로, 실제 사진 편집 파이프라인을 모방해 다양한 변형(색상 변조, 압축, 노이즈 등)을 적용한 복제 위조 샘플을 제공한다. 기존 MS‑COCO 기반 CMFD 데이터셋이 눈에 띄게 인위적이고 저해상도였던 점을 보완한다.

실험 결과는 Forensim이 기존 스플라이스 전용 모델(ManTraNet, CAT‑Net 등)과 복제 전용 모델(BusterNet, DOA‑GAN 등)을 모두 능가함을 보여준다. 특히, F1‑score와 IoU 기준에서 3‑클래스 세그멘테이션 정확도가 4~7%p 상승했으며, 복제 영역을 정확히 소스와 매칭시키는 능력이 크게 향상되었다. Ablation study에서는 Sim Attn과 MSSA 각각이 독립적으로 성능을 끌어올리지만, 결합했을 때 시너지 효과가 가장 크게 나타난다.

전반적으로 Forensim은 (1) 통합된 3‑클래스 프레임워크, (2) 상태공간 기반 효율적 주의 메커니즘, (3) 고품질 복제 위조 데이터셋이라는 세 축을 통해 이미지 위조 탐지의 새로운 패러다임을 제시한다. 향후 연구에서는 텍스트‑이미지 생성 모델에 의한 위조, 비디오 프레임 간 복제 등 멀티모달·시계열 위조 탐지로 확장할 가능성이 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기