주의 기반 프로세스 감독으로 효율적 추론 구현

초록

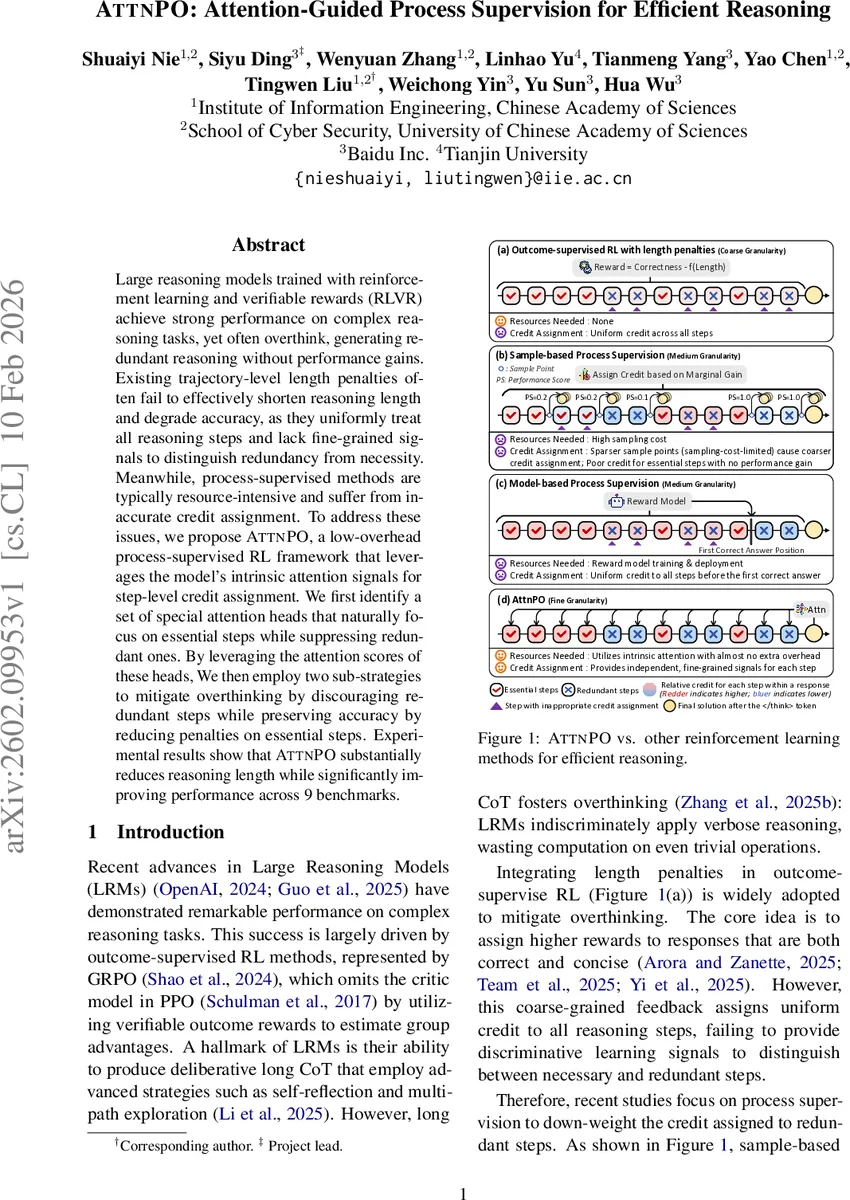

ATTNPO는 대형 추론 모델의 내부 어텐션을 활용해 핵심 단계와 중복 단계를 구분하고, 단계별 보상을 재조정함으로써 추론 길이를 크게 줄이면서 정확도까지 향상시키는 저오버헤드 강화학습 프레임워크이다.

상세 분석

본 논문은 대형 추론 모델(LRM)이 복잡한 문제를 해결할 때 과도하게 긴 사유 과정을 생성하는 ‘오버싱킹’ 현상을 지적한다. 기존의 길이 페널티는 전체 응답에 균일하게 보상을 적용해 핵심 단계와 불필요한 단계 사이의 미세한 차이를 구분하지 못한다. 이를 해결하기 위해 저자들은 모델 내부의 어텐션 헤드 중 일부가 최종 답변을 생성할 때 본질적인 단계에만 높은 어텐션을 할당하고, 중복 단계는 억제한다는 현상을 발견하였다. 이러한 헤드를 “Key‑Focus Heads”(KFH)라 명명하고, KFH가 주로 중후반 레이어에 집중하며, 강화학습 과정에서도 그 행동이 크게 변하지 않음을 실험적으로 입증한다.

ATTNPO는 KFH의 어텐션 스코어를 이용해 각 단계별 ‘스케일링 팩터’ γ를 계산하고, 기존의 outcome‑level advantage A를 단계별로 재조정한다(ˆAₛₖ = γₛₖ·A). 두 가지 보정 전략을 도입한다. 첫째, 긍정적 advantage를 가진 올바른 응답에서 γ를 낮춰 중복 단계에 대한 보상을 감소시켜 오버싱킹을 억제한다. 둘째, 부정적 advantage를 가진 경우에는 핵심 단계에 대한 페널티를 완화해 성능 저하를 방지한다. 이러한 단계별 보정은 올바른 응답에만 적용함으로써 잘못된 응답에서 발생할 수 있는 노이즈를 최소화한다.

실험에서는 9개의 수학·논리·코드 베엔치마크에 대해 평균 7.3%p의 정확도 상승과 60% 이상의 추론 길이 감소를 달성했으며, KFH를 상위 2~3개만 사용해도 포화 효과가 나타나는 등 효율성이 검증되었다. 또한, 기존 샘플 기반·모델 기반 프로세스 감독 방식에 비해 추가 연산·샘플링 비용이 거의 없으며, 어텐션 기반 신호가 훈련 전후에 일관성을 유지한다는 장점을 가진다.

이러한 접근은 어텐션이 내부 정보 선택 메커니즘으로 작동한다는 가설을 실증하고, 강화학습에서 세밀한 단계‑레벨 신호를 저비용으로 활용할 수 있음을 보여준다. 다만 KFH가 모델 규모·아키텍처에 따라 변동될 수 있고, 복잡한 문제에서 ‘중복’으로 보이는 단계가 실제로는 중요한 탐색 역할을 할 가능성도 남아 있다. 향후 다양한 모델·도메인에 대한 일반화와, KFH 자동 탐색 및 동적 선택 메커니즘 개발이 연구 과제로 제시된다.

댓글 및 학술 토론

Loading comments...

의견 남기기