학습 없이 초저비트율을 위한 생성 기반 비디오 압축과 시간 일관성

초록

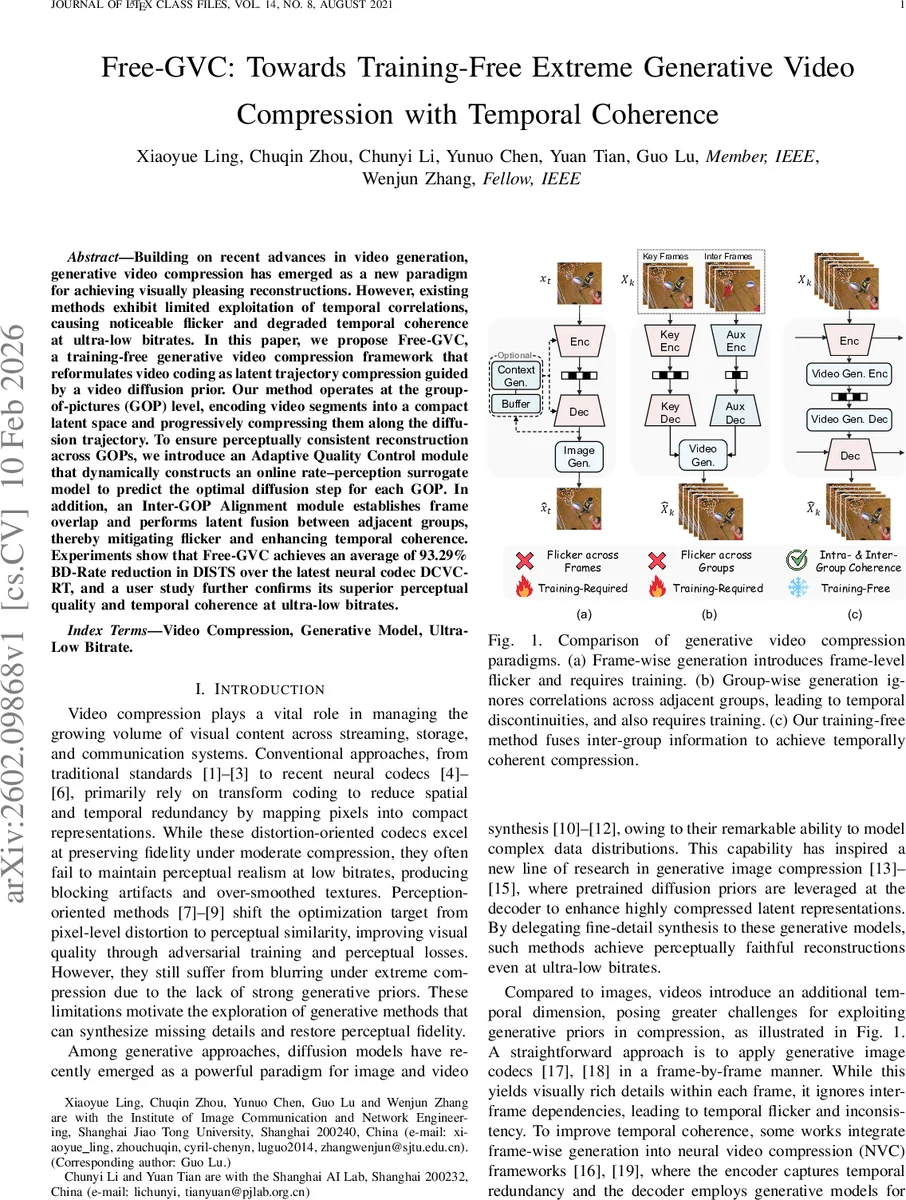

Free-GVC는 사전 학습된 비디오 확산 모델을 활용해 GOP 단위로 영상의 잠재 궤적을 압축하는 훈련‑프리 프레임워크이다. 적응형 품질 제어 모듈이 각 GOP에 최적의 확산 단계(비트레이트)를 예측하고, 인접 GOP 간 겹침 프레임과 잠재 융합을 통해 플리커를 감소시켜 초저비트율에서도 높은 지각 품질과 시간적 일관성을 제공한다.

상세 분석

Free‑GVC는 기존 생성 기반 비디오 코덱이 직면한 두 가지 핵심 한계, 즉(1) 시간적 상관관계를 충분히 활용하지 못해 프레임 간 플리커가 발생하고, (2) 고정된 확산 단계에 의존해 비트레이트‑지각 품질 트레이드‑오프가 콘텐츠에 따라 크게 변동한다는 점을 근본적으로 재설계한다.

첫 번째 단계는 영상을 GOP(그룹‑오브‑픽처) 단위로 분할하고, 사전 학습된 비디오 확산 모델의 인코더(VAE)를 통해 각 GOP를 저차원 잠재 yₖ 로 매핑한다. 이 잠재는 확산 과정에서 순차적으로 노이즈가 추가된 zₜ 로 변환되며, t가 클수록 노이즈 레벨이 높아져 비트레이트가 낮아진다. 여기서 RCC(Reverse Channel Coding)와 Poisson Functional Representation(PFR) 알고리즘을 적용해 zₜ 를 효율적으로 엔코딩한다. 즉, ‘노이즈 레벨 = 비트레이트’라는 직관적 매핑을 통해 압축을 진행하면서도, 확산 모델이 제공하는 강력한 사전 지식으로 손실된 세부 정보를 복원한다.

두 번째 핵심은 Adaptive Quality Control(AQC) 모듈이다. 기존 코덱은 QP(Quantization Parameter)와 같은 결정적 파라미터를 조정해 레이트‑디스토션 곡선을 최적화하지만, 확산 기반 복원은 확률적이므로 동일한 비트레이트라도 지각 품질이 크게 변한다. AQC는 인코딩 과정에서 실시간으로 ‘레이트‑지각 서베이’를 구축한다. 구체적으로, 각 후보 t에 대해 압축된 zₜ 를 디코딩하고 DISTS, LPIPS 등 지각 메트릭을 측정해 목표 품질과의 오차를 기록한다. 이 데이터를 기반으로 온라인 회귀(또는 가우시안 프로세스) 모델을 학습해 현재 GOP에 가장 적합한 t* 를 예측한다. 결과적으로 비트레이트는 동적으로 조정되면서도 지각 품질은 일정 수준을 유지한다.

세 번째 기여는 Inter‑GOP Alignment(IGA)이다. 기존 GOP‑단위 방법은 각 그룹을 독립적으로 처리해 경계에서 시간적 불연속성을 초래한다. IGA는 인코딩 시 각 GOP의 앞·뒤 프레임을 일정 비율(예: 24프레임) 겹치게 배치하고, 겹친 프레임들의 잠재를 평균 혹은 어텐션 기반 융합을 수행한다. 디코딩 단계에서는 이 융합된 잠재를 사용해 연속적인 프레임을 재생성함으로써 경계 플리커를 크게 감소시킨다. 또한, 겹침 프레임은 AQC의 품질 예측에 추가 샘플을 제공해 모델의 안정성을 높인다.E, UVG, MCL‑JCV 데이터셋에서 DISTS 기반 BD‑Rate를 기준으로 최신 신경 코덱 DCVC‑RT 대비 평균 93.29% 절감했으며, 사용자 연구에서도 동일 비트레이트에서 주관적 품질과 시간 일관성이 크게 우수함을 확인했다. 특히 0.5~0.6 bpp 수준의 초저비트율에서도 GLC‑Video와 같은 기존 확산 기반 코덱보다 플리커가 현저히 낮고, 전통적인 VVC와 같은 변형 코덱보다 지각 품질이 뛰어나다.

실험 결과는 설득력 있다. HEVC Class B

요약하면, Free‑GVC는 (1) 확산 모델을 이용한 잠재 궤적 압축이라는 새로운 패러다임, (2) 온라인 레이트‑지각 매핑을 통한 적응형 품질 제어, (3) 인접 GOP 간 잠재 융합을 통한 시간적 일관성 확보라는 세 축을 결합해, 훈련 없이도 초저비트율에서 실용적인 생성 기반 비디오 압축을 구현한다.

댓글 및 학술 토론

Loading comments...

의견 남기기