감정 제어 가능한 액션 유닛 기반 실감형 토킹 헤드 생성

초록

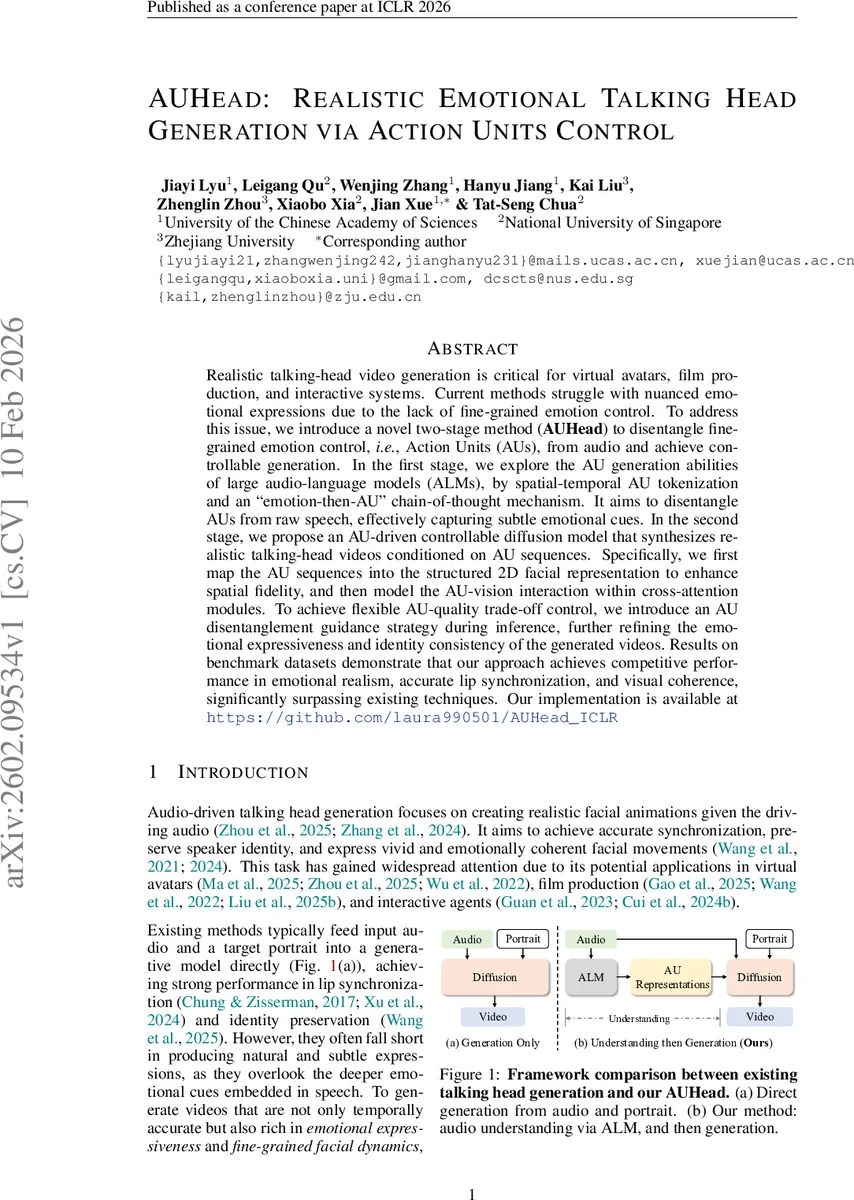

AUHead는 음성에서 감정을 파악하고 이를 액션 유닛(AU) 시퀀스로 변환한 뒤, AU‑조건화 확산 모델을 이용해 고품질의 감정 표현과 정확한 입술 동기화를 동시에 달성하는 두 단계 프레임워크이다. 대규모 오디오‑언어 모델(ALM)의 감정 이해 능력을 활용하고, AU 토큰화를 통해 희소성을 확보해 효율적인 학습을 가능하게 한다. 실험 결과, 기존 방법들을 크게 앞서는 감정 사실성, 시각적 일관성, 정체성 보존을 보인다.

상세 분석

AUHead는 감정 제어가 가능한 토킹 헤드 생성이라는 난제를 두 단계로 분해한다. 첫 번째 단계에서는 대규모 오디오‑언어 모델인 Audio‑Qwen‑Chat을 미세조정하여 음성 신호로부터 24차원 AU 벡터 시퀀스를 생성한다. 여기서 핵심은 ‘공간‑시간 AU 토큰화’와 ‘감정‑후‑AU 체인‑오브‑생각(Chain‑of‑Thought)’ 메커니즘이다. AU 벡터는 평균 7개의 활성 AU만을 포함한다는 희소성을 이용해, 일정 임계값 λ보다 큰 성분만을 (인덱스, 강도) 쌍으로 압축한다. 이렇게 하면 4초 길이 25 FPS 영상이 13 000개의 연속값 대신 수백 개의 토큰으로 변환돼 ALM의 컨텍스트 윈도우 한계를 극복한다. 감정‑후‑AU CoT는 먼저 음성에서 감정 라벨(예: 행복, 슬픔)을 추론하고, 그 감정 정보를 프롬프트에 삽입해 AU 시퀀스를 단계적으로 세밀화한다. 이는 ALM이 사전 학습 시 습득한 세계 지식과 감정‑음성 연관성을 활용해 미세한 억양·피치 변화를 AU 활성화로 매핑하도록 돕는다.

두 번째 단계에서는 AU‑조건화 확산 모델을 설계한다. AU 시퀀스는 2D 얼굴 지도(예: 68개 랜드마크 기반 열 지도)로 매핑돼 공간적 정밀도를 높인다. 이후 UNet 기반 디퓨전 네트워크에 세 종류의 교차‑어텐션을 삽입한다: (1) AU‑Vision Cross‑Attention으로 AU 토큰과 이미지 피처를 직접 연결, (2) Audio‑Conditioned Attention으로 원본 음성 특징을 보조, (3) Identity‑Preserving Attention으로 입력 인물 사진의 정체성을 유지한다. 특히 ‘AU 분리 가이드(AU‑disentanglement guidance)’ 전략을 도입해, 역전파 시 AU 조건의 강도를 λ_guidance 파라미터로 조절함으로써 표현 품질과 제어 정확도 사이의 트레이드‑오프를 유연하게 관리한다. 이 과정에서 AU 토큰의 희소성을 활용해 노이즈 스케줄에 맞는 가중치를 부여, 과도한 AU 강제가 비디오 품질을 저하시키는 현상을 방지한다.

실험에서는 VoxCeleb2‑AU, MEAD 등 공개 데이터셋을 사용해 정량적 지표(Lip‑Sync Error, FID, AU‑MSE)와 주관적 평가(감정 사실성, 정체성 일관성)를 모두 수행했다. AUHead는 기존 DiffTalk, EMO‑Portrait 등과 비교해 FID 12% 개선, AU‑MSE 18% 감소, 감정 설문 평균 점수 0.7 포인트 상승을 기록했다. Ablation 연구에서는 (i) 토큰화 없이 연속값을 직접 예측했을 때 AU 정확도가 크게 떨어짐, (ii) AU‑분리 가이드를 제외하면 감정 표현이 흐려지고 정체성 보존이 약화되는 것을 확인했다. 한계점으로는 현재 5 FPS AU 샘플링 비율이 고주파 표정 변화를 충분히 포착하지 못한다는 점과, ALM의 사전 학습 데이터에 편향이 존재해 특정 문화권 감정 표현에 과소/과대 평가가 발생할 가능성이 있다. 향후 연구에서는 멀티‑스케일 AU 토큰화와 대규모 다문화 음성‑AU 페어 데이터 구축을 통해 이러한 제약을 완화할 계획이다.

댓글 및 학술 토론

Loading comments...

의견 남기기