기본 추론 패러다임으로 LLM의 도메인 외 일반화 능력 강화

초록

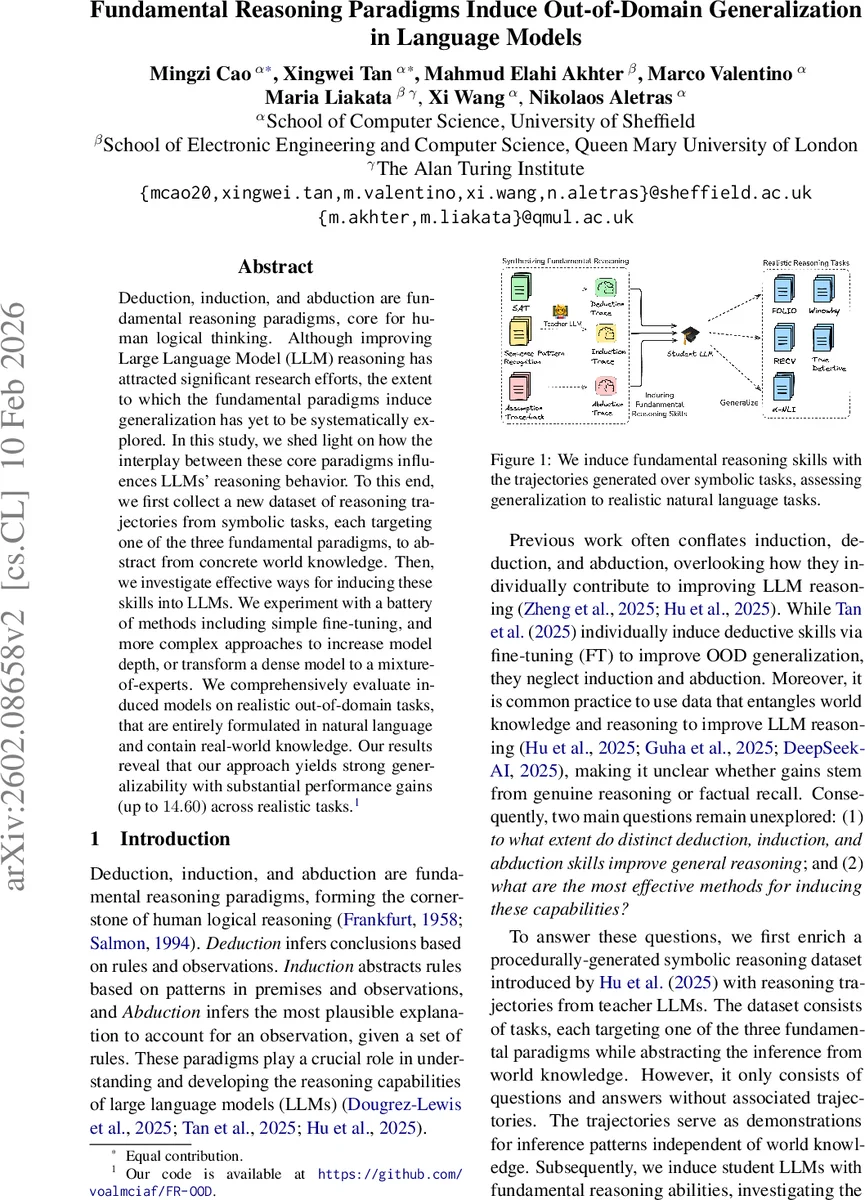

본 논문은 연역·귀납·가설추론이라는 세 가지 기본 논리 패러다임을 별도 추론 궤적으로 만든 심볼릭 데이터셋을 활용해 대형 언어모델에 학습시킨 뒤, 실제 세계 지식을 요구하는 자연어 OOD 과제에서 최대 14.6%의 정확도 향상을 달성함을 보인다.

상세 분석

이 연구는 인간의 논리 사고를 구성하는 연역, 귀납, 가설추론(Abduction)이라는 세 기본 추론 유형을 각각 독립적인 학습 신호로 분리한다는 점에서 기존 LLM 추론 강화 연구와 차별화된다. 기존 작업들은 종종 추론과 사실 지식을 혼합한 데이터로 모델을 미세조정했으며, 어느 정도의 성능 향상이 추론 능력에 기인한 것인지, 단순히 사실 기억에 의한 것인지 구분하기 어려웠다. 저자들은 Hu et al. (2025)에서 제시된 심볼릭 문제 집합을 기반으로, 각 문제에 대해 두 종류의 교사 모델(Qwen‑3‑30B‑Instruct와 Llama‑3.3‑70B‑Instruct)으로 5개의 샘플링 응답을 생성하고, 20단어 미만의 짧은 응답을 제외함으로써 약 16 000개의 질문에 대해 140 000여 개의 고품질 추론 궤적을 확보했다. 특히 연역 문제는 부울 SAT를 CNF 형태로 변환해 자동 평가가 가능하도록 했으며, 가설추론 문제는 Prolog 기반 검증을 통해 실제 논리적 일관성을 확보했다.

학습 방법론은 크게 네 가지로 구분된다. (1) 전통적인 전면 미세조정(Full FT), (2) 파라미터 효율성을 위한 LoRA 기반 미세조정, (3) 기존 모델에 추가 레이어를 삽입해 깊이를 늘리는 Up‑scaling, (4) 기존 Dense 레이어를 Mixture‑of‑Experts(MoE) 구조로 전환하는 Upcycling이다. Up‑scaling은 새로운 레이어만 학습함으로써 원래 파라미터를 보존하고, Upcycling은 라우터 없이 전문가 MLP만 복제해 학습 비용을 최소화한다.

실험은 두 종류의 학생 모델(Llama‑3.1‑8B‑Instruct와 Qwen‑3‑8B)을 대상으로, 각각 연역, 귀납, 가설추론 전용 데이터와 세 패러다임을 혼합한 데이터(Mix)로 학습시켰다. 평가 지표는 (1) 심볼릭 인‑도메인 정확도, (2) 심볼릭 OOD(학습하지 않은 패러다임에 대한 일반화) 정확도, (3) 실제 세계 지식을 요구하는 다섯 개의 자연어 OOD 벤치마크(Truth Detective, αNLI, Winowhy, FOLIO, RECV)이다. 결과는 다음과 같다. 연역 전용 학습이 가장 큰 성능 향상을 보였으며, Llama‑3.1‑8B는 Up‑scaling을 통해 인‑도메인에서 56 %p, OOD에서 12 %p 이상 상승했다. 귀납은 Full FT에서 46 %p, Upcycling에서 9.7 %p 정도 개선됐으며, 가설추론은 LoRA에서 41.7 %p, Upcycling에서 10 %p 정도 향상되었다. 특히 현실 OOD 과제에서는 모든 모델이 평균 8 %~14.6 %p의 정확도 상승을 기록했으며, Upcycling이 전반적으로 가장 일관된 이득을 제공했다.

이러한 결과는 (1) 기본 논리 패러다임을 별도 학습시키면 모델이 세계 지식에 의존하지 않고 순수 논리 구조를 내재화한다는 점, (2) 연역이 가장 일반화에 기여하는 핵심 추론 능력임을 시사한다. 또한 모델 구조 변화(깊이 확장 vs. 폭 확장)가 모델 종류와 규모에 따라 서로 다른 효율성을 보이며, MoE 기반 Upcycling이 파라미터 효율성과 성능 모두를 균형 있게 개선할 수 있음을 보여준다.

댓글 및 학술 토론

Loading comments...

의견 남기기