Malloc 전용 추론 모델의 기억 해제

초록

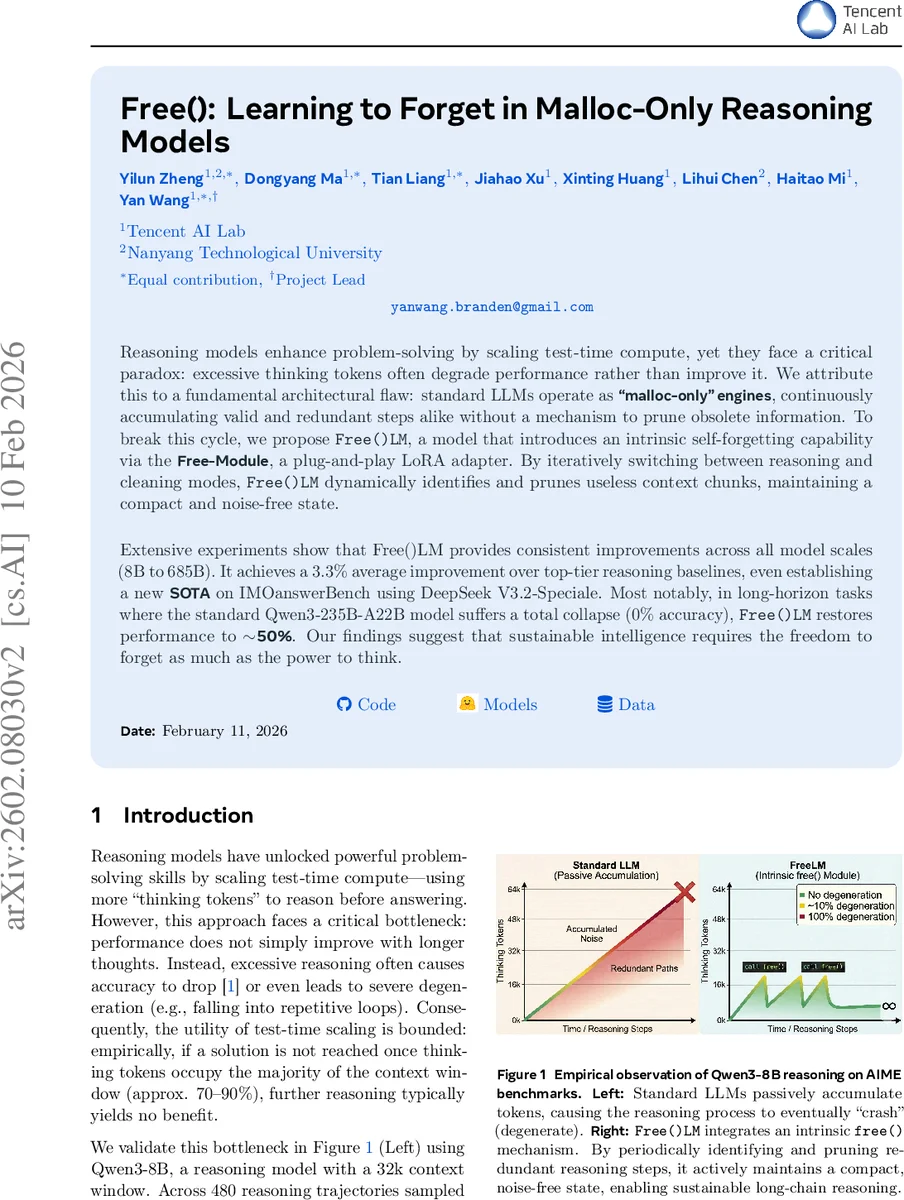

Free()LM은 기존 대형 언어 모델이 사고 토큰을 계속 누적하는 “malloc‑only” 구조적 한계를 극복하기 위해 설계된 플러그인형 LoRA 어댑터이다. 추론 모드와 정리 모드를 번갈아 가며 불필요한 컨텍스트 조각을 자동으로 식별·제거함으로써, 긴 추론 과정에서도 메모리를 압축하고 정확도를 평균 3.3% 향상시킨다.

상세 분석

본 논문은 대형 언어 모델이 테스트 시 사고 토큰을 늘릴수록 성능이 오히려 하락하는 현상을 “malloc‑only” 현상이라고 정의한다. 기존 모델은 생성된 모든 토큰을 KV 캐시에 그대로 보관하고, 불필요하거나 중복된 단계까지도 삭제하지 못한다. 이로 인해 컨텍스트 윈도우가 포화되면 반복 루프에 빠지거나 추론이 완전히 붕괴한다. 저자들은 이러한 구조적 결함을 해결하기 위해 Free()LM이라는 새로운 아키텍처를 제안한다. 핵심은 경량 LoRA 어댑터인 Free‑Module을 백본 모델에 플러그인 형태로 삽입하고, 필요 시 병합(merge)하여 “정리 모드”를 활성화하는 것이다. 정리 모드에서는 모델이 현재 컨텍스트를 스캔하고, 의미상 불필요한 구간을 prefix‑suffix 형태의 문자열 앵커로 지정해 JSON 명령으로 출력한다. 외부 실행기가 이 명령을 받아 문자열 치환으로 해당 구간을 삭제하고, KV 캐시의 위치 정보를 재조정한다. 이후 어댑터를 다시 분리(unmerge)하면 추론 모드가 재개된다.

정리 주기의 하이퍼파라미터 L_clean을 통해 일정 토큰 수마다 자동 정리를 수행하도록 설계했으며, 두 가지 캐시 관리 전략(재프리페일링, KV 캐시 절단)을 비교하였다. 실험에서는 재프리페일링이 현재 서빙 프레임워크(vLLM)와 호환성이 높아 기본 전략으로 채택되었다.

학습 단계에서는 기존의 In‑Context Learning(ICL) 기반 자체 정리 방법이 성능 향상이 미미함을 확인하고, 명시적 라벨이 부족한 문제를 해결하기 위해 데이터 합성 파이프라인을 구축했다. 먼저 DeepMath‑103k 데이터에서 1k 토큰 청크 단위로 후보 정리 명령을 Gemini‑2.5‑Pro를 이용해 생성하고, 8번의 독립 롤아웃을 통해 정리 후 정확도가 유지되거나 향상되는 경우만을 선별하였다. 이 과정을 통해 6,648개의 고품질 학습 샘플을 확보하였다.

실험 결과는 8B부터 685B까지 다양한 규모의 모델에 적용했을 때 일관된 성능 향상을 보여준다. 특히 Qwen3‑235B 모델은 80k 이상 사고 토큰이 필요했던 장기 추론 작업에서 기존은 0% 정확도였던 반면, Free()LM은 약 50% 수준으로 회복하였다. 또한 평균 3.3%의 정확도 상승과 함께 응답 토큰 수를 20% 이상 감소시켜 효율성도 크게 개선했다. 히스토리 압축 기반의 H2O, ThinkCleary와 같은 기존 휴리스틱 압축 기법은 성능 저하를 초래했지만, Free()LM은 정밀한 정리 명령을 학습함으로써 불필요한 정보를 최소화하면서도 핵심 논리 흐름을 보존한다는 점에서 차별성을 갖는다.

결론적으로, 모델이 스스로 “잊는” 능력을 갖추는 것이 장기 추론의 지속 가능성을 확보하는 핵심 요소이며, Free()LM은 플러그인형 LoRA 어댑터를 통한 간단하면서도 효과적인 구현 방법을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기