스칼라 보상에서 잠재 트렌드로 모델 기반 강화학습을 위한 잠재 풍경 형성

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

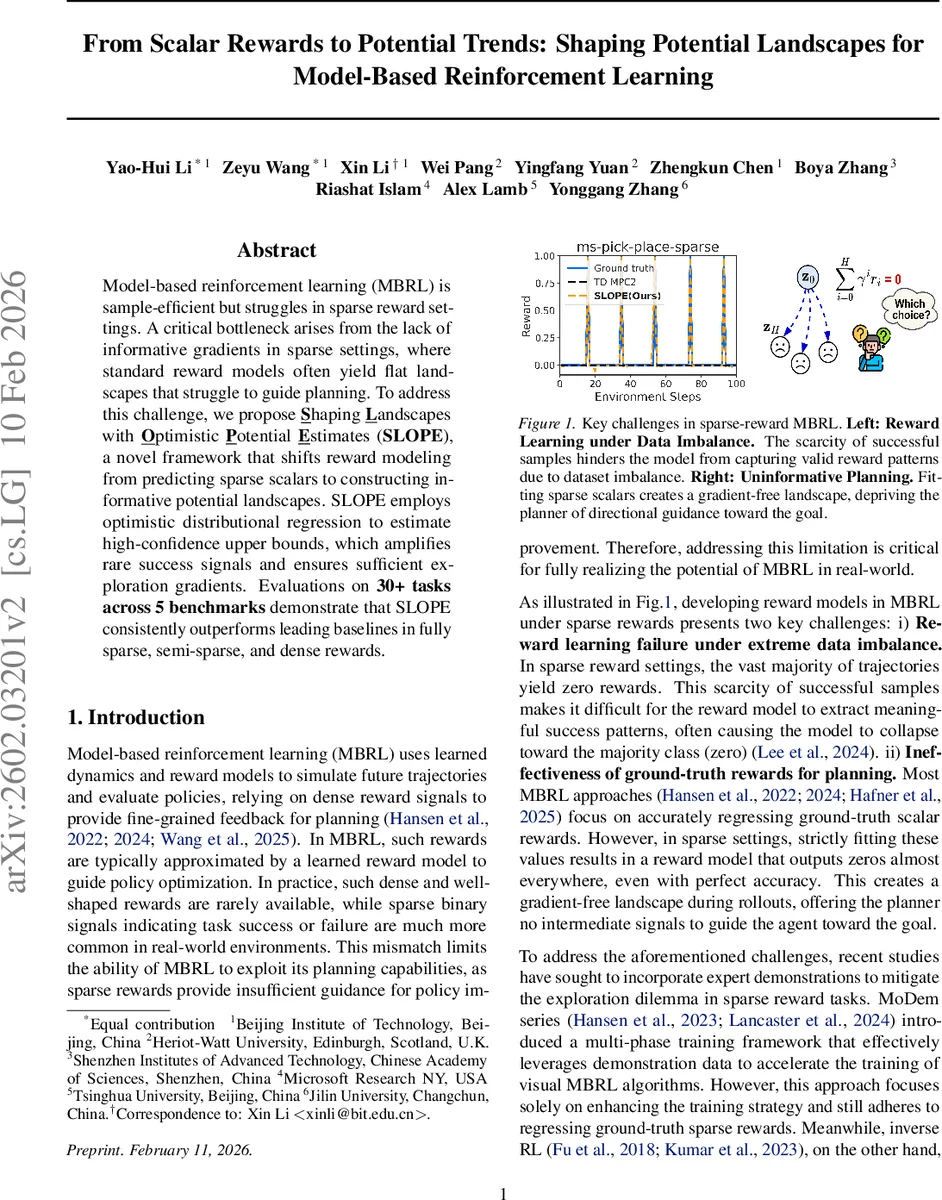

SLOPE는 희소 보상 환경에서 기존의 스칼라 보상 회귀가 만든 평탄한 가치 지형을 극복하기 위해, 낙관적인 분포형 회귀를 이용해 잠재 함수(잠재 풍경)를 추정한다. 잠재 기반 보상 형성(PBRS) 이론을 적용해 최적 정책을 보존하면서도 탐색을 유도하고, TD‑MPC2·Dreamer‑v3 등 다양한 MBRL 백본에 쉽게 통합된다. 5개 벤치마크 30여 개 과제에서 희소·반희소·밀집 보상 모두에서 기존 최첨단 방법들을 일관적으로 앞선다.

상세 분석

본 논문은 모델 기반 강화학습(MBRL)에서 희소 보상으로 인한 “그라디언트 고갈” 문제를 근본적으로 재구성한다. 기존 접근은 환경에서 관측되는 0/1 보상을 그대로 회귀시켜 보상 모델을 학습하고, 이를 기반으로 MPPI와 같은 샘플링 플래너가 행동을 선택한다. 하지만 목표에 도달하지 못하는 경우 대부분의 트래젝터리가 0 보상을 반환하므로, 학습된 보상·가치 함수는 전역적으로 0에 수렴하고, 플래너는 탐색 방향을 전혀 얻지 못한다.

SLOPE는 이 한계를 잠재 기반 보상 형성(PBRS, Ng et al., 1999)의 관점에서 해결한다. 에이전트가 학습한 Q‑함수를 잠재 Φ(s)로 간주하고, 보상 함수를 r′(s,a)=r(s,a)+γ E

댓글 및 학술 토론

Loading comments...

의견 남기기