감독학습이 모델 지식에 미치는 영향 분석

초록

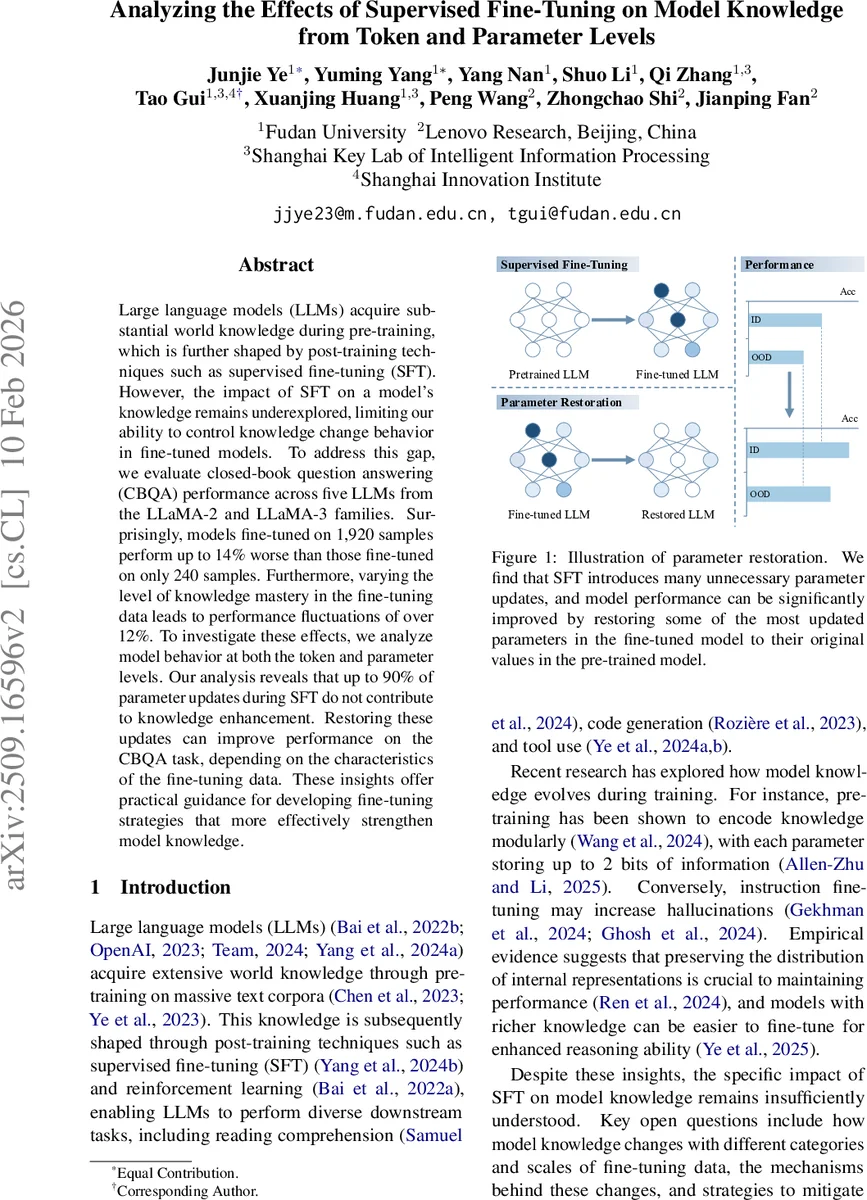

본 논문은 LLaMA‑2·3 시리즈 5개 모델을 대상으로 감독‑학습(SFT)이 폐쇄형 질문응답(CBQA) 성능에 미치는 영향을 체계적으로 조사한다. 데이터 규모가 240개일 때 최적 성능을 보이다가 1 920개로 확대하면 최대 14%까지 성능이 하락한다. 또한, 사전‑학습 모델이 이미 잘 알고 있는(마스터리 수준이 높은) 데이터와 그렇지 않은 데이터로 학습했을 때 성능 변동이 12% 이상 차이난다. 토큰‑레벨 KL 발산 분석과 파라미터‑레벨 복원 실험을 통해 SFT 과정에서 업데이트된 파라미터의 90%가 지식 향상에 기여하지 않으며, 이들을 원래 값으로 복원하면 성능 회복·향상이 가능함을 보여준다.

상세 분석

이 연구는 크게 두 가지 차원에서 SFT가 모델 지식에 미치는 영향을 파악한다. 첫 번째는 토큰‑레벨 분석이다. 논문은 fine‑tuned 모델과 사전‑학습 모델 사이의 로그 확률 분포 차이를 KL divergence로 측정한다. 데이터 규모가 60→240개일 때 KL 값이 감소하는데, 이는 미세조정이 사전‑학습된 내부 표현을 크게 왜곡하지 않으며 오히려 기존 지식을 보강한다는 것을 의미한다. 그러나 240개를 넘어 1 920개까지 확대하면 KL 값이 급격히 상승한다. 특히 ‘마스터리 0’(모델이 전혀 알지 못하는) 데이터로 학습했을 때 KL 상승 폭이 가장 크며, 이는 모델이 새로운 정보를 받아들이는 과정에서 기존 파라미터를 과도하게 조정해 기존 지식이 손상된다는 증거이다.

두 번째는 파라미터‑레벨 분석이다. 저자들은 fine‑tuned 모델에서 가장 크게 변한 파라미터들을 순위화하고, 상위 10%부터 100%까지 원래 사전‑학습 값으로 복원한다. 흥미롭게도 복원 비율이 70%~90%에 이를 때도 성능이 유지되거나 오히려 10% 이상 향상되는 현상이 관찰된다. 이는 SFT 과정에서 대부분의 파라미터 업데이트가 ‘노이즈’에 가깝고, 실제 지식 강화에 기여하는 핵심 파라미터는 극히 일부에 불과함을 시사한다. 특히 데이터 마스터리 수준이 낮은 경우(‘마스터리 0’), 불필요한 파라미터 변동이 크게 발생해 성능 저하가 심각해진다.

실험 설계 측면에서 저자들은 5개의 마스터리 레벨(0~4)과 3가지 데이터 규모(60, 240, 1 920)를 조합해 15가지 조건을 만든 뒤, LLaMA‑2‑7B/13B/70B와 LLaMA‑3‑8B/70B 총 5개 모델에 동일 프로토콜을 적용했다. 평가 지표는 정확도(accuracy)이며, 인‑도메인과 아웃‑도메인 테스트 셋을 모두 사용해 일반화 능력을 검증했다. 결과는 모든 모델군에서 일관되게 나타났으며, 특히 LLaMA‑3‑8B가 가장 큰 성능 변동을 보였다.

이 논문의 주요 시사점은 다음과 같다. 첫째, SFT는 무조건적인 데이터 확대가 지식 향상으로 이어지지 않는다. 적절한 규모(수백 개 수준)와 높은 마스터리 수준을 갖춘 데이터가 오히려 더 효율적이다. 둘째, 파라미터 업데이트의 대부분이 지식 강화와 무관하므로, ‘파라미터 복원’ 혹은 ‘업데이트 선택적 적용’과 같은 새로운 미세조정 전략이 필요하다. 셋째, KL divergence와 파라미터 변동량을 모니터링하면 과적합 위험을 사전에 감지할 수 있다. 이러한 통찰은 향후 LLM을 특정 도메인에 맞게 튜닝하면서도 기존 지식 손실을 최소화하는 실용적인 가이드라인을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기