논리적 추론 기반 다중 객체 추적을 위한 ReaMOT 벤치마크와 무학습 프레임워크

초록

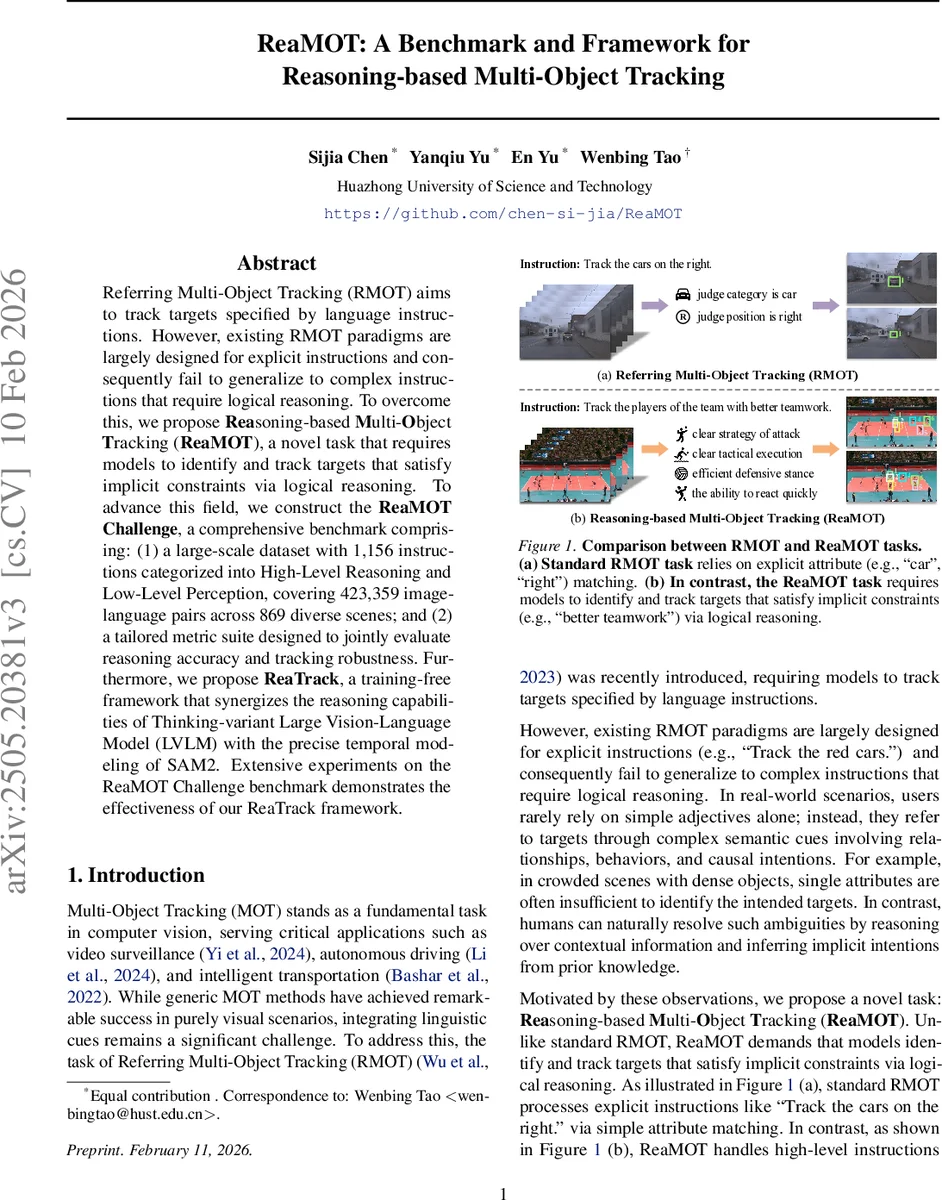

ReaMOT은 언어 지시문의 암시적 제약을 논리적으로 추론해 목표를 식별·추적하는 새로운 과제이다. 1,156개의 고난이도·저난이도 지시문, 423 359개의 이미지‑언어 쌍, 869개의 장면을 포함한 대규모 데이터셋과, 추론 정확도와 추적 견고성을 동시에 평가하는 메트릭을 제공한다. 제안된 무학습 프레임워크 ReaTrack은 Thinking‑variant LVLM의 추론 능력과 SAM2의 마스크 기반 시간 전파를 결합해 제로샷 설정에서 기존 방법을 크게 앞선 성능을 기록한다.

상세 분석

본 논문은 기존 Referring Multi‑Object Tracking(RMOT)이 “빨간 차를 추적한다”와 같은 명시적 속성 매칭에만 의존해 복합적인 언어 지시를 처리하지 못한다는 한계를 정확히 짚어낸다. 이를 극복하기 위해 고수준 논리 추론이 요구되는 상황을 모델이 이해하도록 설계된 ReaMOT 과제를 정의하고, 두 단계의 난이도(High‑Level Reasoning, Low‑Level Perception)로 지시문을 구분한다. 데이터 구축 과정에서는 12개의 공개 MOT·비디오 데이터셋을 통합하고, ‘공간 위치·동작·복장·인간 속성·객체 속성·특정 명사·보조 수식·기타’ 8가지 카테고리로 구성된 속성 기준을 사전 정의한다. 이 기준을 바탕으로 GPT‑4o가 자동으로 대상의 외형·동작·관계·구별 특성을 기술하도록 프롬프트를 설계하고, 인간 annotator가 결과를 검증·재작성하는 3단계 파이프라인을 도입해 고품질의 추론‑지향 지시문을 확보한다.

평가 메트릭은 기존 MOTA·IDF1에 더해 RHO_TA(Reasoning‑HO), RIDF1, RRcll, RPrcn 등 추론 정확도와 트래킹 일관성을 별도 측정하도록 설계돼, 모델이 “팀워크가 좋은 팀의 선수”와 같은 암시적 조건을 올바르게 해석했는지 정량화한다.

제안된 ReaTrack 프레임워크는 학습 없이 동작한다. 첫 단계인 Reasoning‑Aware Detection에서는 Thinking‑variant LVLM이 입력 영상과 지시문을 동시에 처리해 논리적 추론을 수행하고, 대상 후보 마스크를 생성한다. 두 번째 단계인 Mask‑Based Temporal Propagation에서는 최신 비디오 세그멘테이션 모델 SAM2를 이용해 이전 프레임의 마스크를 시간적으로 전파, 움직임 프라이어를 확보한다. 마지막 Reasoning‑Motion Association 단계에서는 LVLM이 제공한 의미적 라벨과 SAM2의 움직임 예측을 결합해 트랙 초기화·연결·종료를 관리한다. 이 구조는 각 모듈이 독립적으로 최첨단 성능을 발휘하도록 설계돼, 전체 파이프라인이 복잡한 논리 추론과 정확한 시계열 연관을 동시에 만족한다.

실험 결과, ReaTrack은 High‑Level Reasoning 셋에서 RHO_TA 42.28%를 기록, 기존 최첨단 대비 약 6배 향상된 점수를 얻었다. Low‑Level Perception에서도 전반적인 MOTA·IDF1을 상회한다. Ablation study는 LVLM의 추론 모듈이 없을 경우 성능 급락을, SAM2 없이 마스크 전파가 제한적일 경우 트랙 지속성이 크게 감소함을 보여준다.

하지만 몇 가지 한계도 존재한다. 첫째, LVLM에 대한 의존도가 높아 모델 자체의 오류(예: 잘못된 추론) 전파가 전체 성능에 직접적인 영향을 미친다. 둘째, SAM2 기반 마스크 전파는 고해상도 영상에서 연산 비용이 크게 증가해 실시간 적용에 제약이 있다. 셋째, 현재는 제로샷 설정만 평가했으며, 대규모 도메인‑특화 파인튜닝을 통한 성능 향상 가능성을 탐색하지 않았다. 향후 연구는 추론‑추적 통합 학습, 경량화된 마스크 전파, 멀티모달 교차‑주의 메커니즘 등을 통해 실시간성과 일반화 능력을 동시에 강화할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기