다중모달 프로토타입 증강을 통한 소수샷 학습

초록

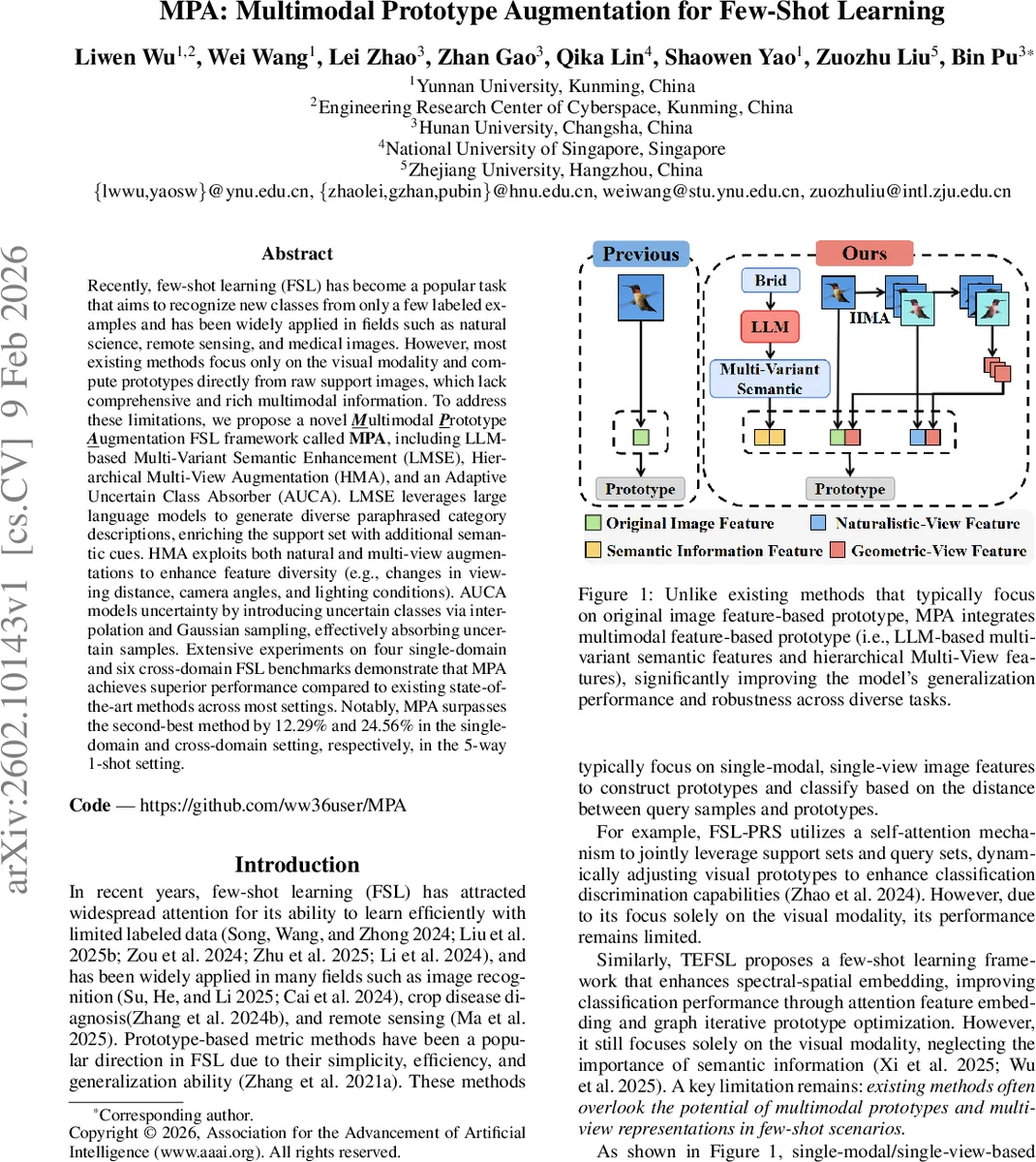

MPA는 대규모 언어 모델을 이용해 클래스 설명을 다변화하고, 계층적 다중‑뷰 이미지 변환과 불확실 클래스 흡수 기법을 결합해 프로토타입을 강화한다. 시각·텍스트·다중‑뷰 정보를 통합함으로써 단일 도메인·크로스 도메인 5‑way 1‑shot 설정에서 기존 최첨단 방법보다 각각 12.29%·24.56% 높은 정확도를 달성한다.

상세 분석

본 논문은 기존 소수샷 학습(FSL)에서 시각 정보에만 의존하는 한계를 극복하기 위해 ‘멀티모달 프로토타입 증강(MPA)’ 프레임워크를 제안한다. 핵심은 세 가지 모듈로 구성된다. 첫 번째인 LLM‑Based Multi‑Variant Semantic Enhancement(LMSE)는 GPT‑4와 같은 대형 언어 모델을 활용해 각 클래스명에 대해 원문과 네 개의 패러프레이즈된 설명을 생성한다. 이렇게 얻은 텍스트는 CLIP 텍스트 인코더에 입력되어 고차원 의미 임베딩으로 변환되고, 이미지 임베딩과 결합돼 프로토타입을 보강한다. 이는 특히 시각적 차이가 미미한 미세분류(예: 새 종류)에서 텍스트가 제공하는 속성 정보가 판별력을 크게 높이는 효과를 만든다. 두 번째인 Hierarchical Multi‑View Augmentation(HMA)은 자연적 변형(중심 크롭, 회전, 색상 왜곡)과 기하학적 변형(수평 반사)을 계층적으로 적용한다. 각 변형마다 CLIP 이미지 인코더를 통해 특징을 추출하고, 원본과 결합해 다중‑뷰 특징 집합을 만든다. 이렇게 하면 제한된 지원 샘플에서도 다양한 시점·조명·구도 정보를 확보해 모델의 일반화와 견고성을 향상시킨다. 세 번째인 Adaptive Uncertain Class Absorber(AUCA)는 클래스 간 프로토타입 유사도를 기반으로 동적으로 불확실 클래스 샘플을 생성한다. 구체적으로, 서로 다른 클래스의 프로토타입을 선형 보간(α∈

댓글 및 학술 토론

Loading comments...

의견 남기기