스펙터티브 디코딩의 에너지 절감: 모델·전략·데이터셋 별 종합 벤치마크

초록

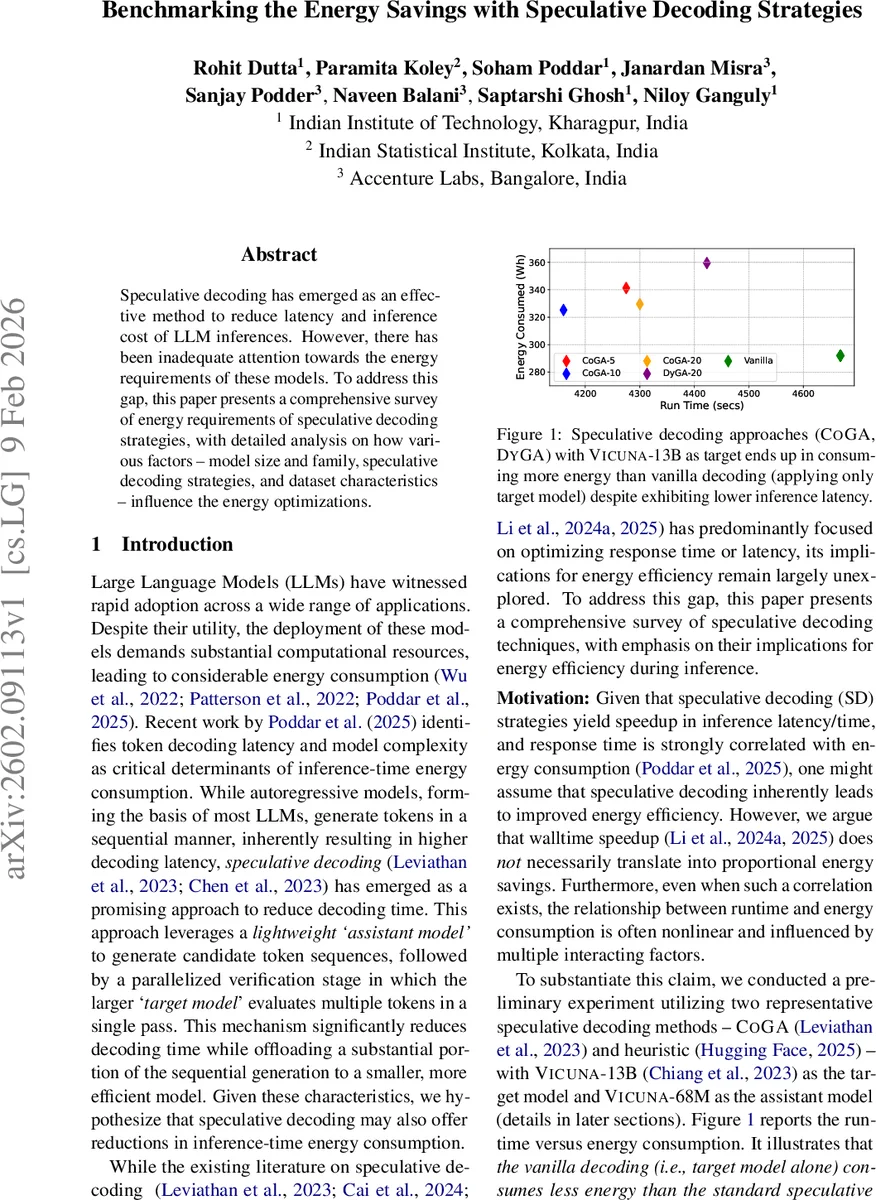

본 논문은 스펙터티브 디코딩(SD) 기법이 지연 시간 감소에 기여하지만, 에너지 절감과는 반드시 일치하지 않음을 실험적으로 입증한다. 모델 규모·패밀리, 보조 모델·대상 모델 비율, 데이터셋 특성 등 8가지 요인을 체계적으로 분석해 LLaMA·FLAN‑T5 계열은 에너지 효율이 높지만, Vicuna·Qwen은 경우에 따라 에너지 소비가 증가한다는 결과를 제시한다.

상세 분석

본 연구는 스펙터티브 디코딩이 “속도 = 에너지 절감”이라는 단순 가정을 깨뜨리는 첫 번째 대규모 에너지‑관점 벤치마크이다. 실험은 4가지 모델 패밀리(Vicuna, LLaMA, FLAN‑T5, Qwen)와 8개의 대상‑보조 모델 조합을 사용했으며, 각 조합에 대해 CoGA‑x, DyGA‑x, EAGLE‑2/3, Medusa 네 가지 SD 전략을 적용했다. 주요 분석 포인트는 다음과 같다.

-

속도와 에너지의 비선형 관계: Figure 1에서 보듯, CoGA‑20과 DyGA‑20은 런타임을 1.3‑1.5배 가속시켰음에도 GPU 에너지 절감률(γ_GPU)이 0.8‑0.9 수준에 머물러 전체 에너지(γ_Total)까지는 1.0 이하, 즉 절감 효과가 미미하거나 오히려 증가한다. 반면 EAGLE‑3은 2.5‑2.9배 속도 향상에 맞춰 γ_Total이 1.8‑2.5배까지 상승한다. 이는 고도화된 초안 트리와 토큰 직접 예측이 보조 모델의 연산량을 크게 낮추면서도 목표 모델의 호출 횟수를 크게 줄인 결과이다.

-

모델 패밀리별 차이: LLaMA‑8B와 LLaMA‑70B는 CoGA·DyGA에서도 1.2‑1.4배 정도 에너지 절감을 보였지만, Vicuna‑7B/13B는 동일 전략에서 거의 절감이 없거나 0.7배 이하로 감소한다. 이는 Vicuna가 토큰 예측 정확도가 낮아 보조 모델 초안이 자주 재검증되면서 목표 모델 호출이 늘어나기 때문이다. FLAN‑T5‑L/B는 인코더‑디코더 구조가 병렬화에 유리해 CoGA·DyGA에서도 2.0배까지 절감한다. Qwen‑4B/8B는 전체적으로 1.0배에 근접하거나 오히려 0.9배 이하로 감소해, 최신 대형 모델일수록 SD 전략 적용 시 에너지 효율이 떨어질 가능성을 시사한다.

-

데이터셋·태스크 의존성: HumanEval(코드 생성)에서는 가장 높은 γ_Total(2.5배)과 γ_t(2.9배)를 기록했으며, 이는 초안이 높은 정확도를 보인 덕분이다. 반면 CNN‑DM(요약)에서는 대부분의 전략이 γ_Total≈1.0 이하이며, 특히 LLaMA‑70B는 오히려 에너지 소비가 증가한다. GSM‑8K(수학 추론)에서도 EAGLE‑2/3이 일관된 절감을 보였지만, CoGA·DyGA는 1.1‑1.3배 수준에 머물렀다. 즉, 초안 품질이 태스크 난이도와 직접 연관되어 에너지 절감 효과가 크게 변동한다.

-

보조‑대상 모델 크기 비율: 보조 모델이 대상 모델보다 10배~100배 작을수록(예: Vicuna‑68M vs Vicuna‑13B) γ_Total이 크게 상승한다. 논문은 “크기 차이가 클수록 에너지 최적화가 가파른 직선 형태”라는 경험적 관계를 제시한다. 그러나 LLaMA‑70B와 LLaMA‑1B 조합처럼 보조 모델이 충분히 작아도 초안 품질이 낮으면 기대 이하의 절감률을 보인다.

-

플랫폼·프레임워크 차이: HuggingFace와 vLLM을 동일 설정으로 비교했을 때, HuggingFace가 전반적으로 γ_t와 γ_Total 모두 5‑10% 정도 우수했다. 이는 vLLM이 메모리 매핑 최적화에 집중하면서 GPU 활용 효율이 다소 낮아 발생한 것으로 해석된다.

-

측정 방법론 및 한계: 에너지 측정은 CodeCarbon을 이용해 GPU, CPU, RAM 전체 전력을 추정했으며, 배치 크기 1, 단일 GPU 환경을 고정했다. 다중 GPU, 배치 확대, 양자화 수준 변화 등 실운영 환경과의 차이가 존재한다. 또한, 초안 길이 x를 5,10,20으로만 실험했으며, 더 큰 초안이나 동적 조정 전략에 대한 탐색은 부족하다.

핵심 인사이트

- 스펙터티브 디코딩은 “속도 향상 = 에너지 절감”이 아니라, 모델 패밀리·크기 비율·데이터셋·초안 품질이 복합적으로 작용한다.

- EAGLE‑2/3과 같은 고도화된 초안 트리는 대부분의 경우 에너지 효율을 크게 끌어올리지만, 구현 복잡도와 메모리 요구량이 증가한다.

- 실무 적용 시, 목표 모델과 보조 모델의 크기 차이를 충분히 크게 잡고, 초안 정확도가 높은 태스크(코드 생성, 간단 요약 등)에서 SD를 적용하는 것이 에너지 절감에 가장 효과적이다.

댓글 및 학술 토론

Loading comments...

의견 남기기