마스크 비트 모델링으로 구현한 고성능 자동회귀 이미지 생성

초록

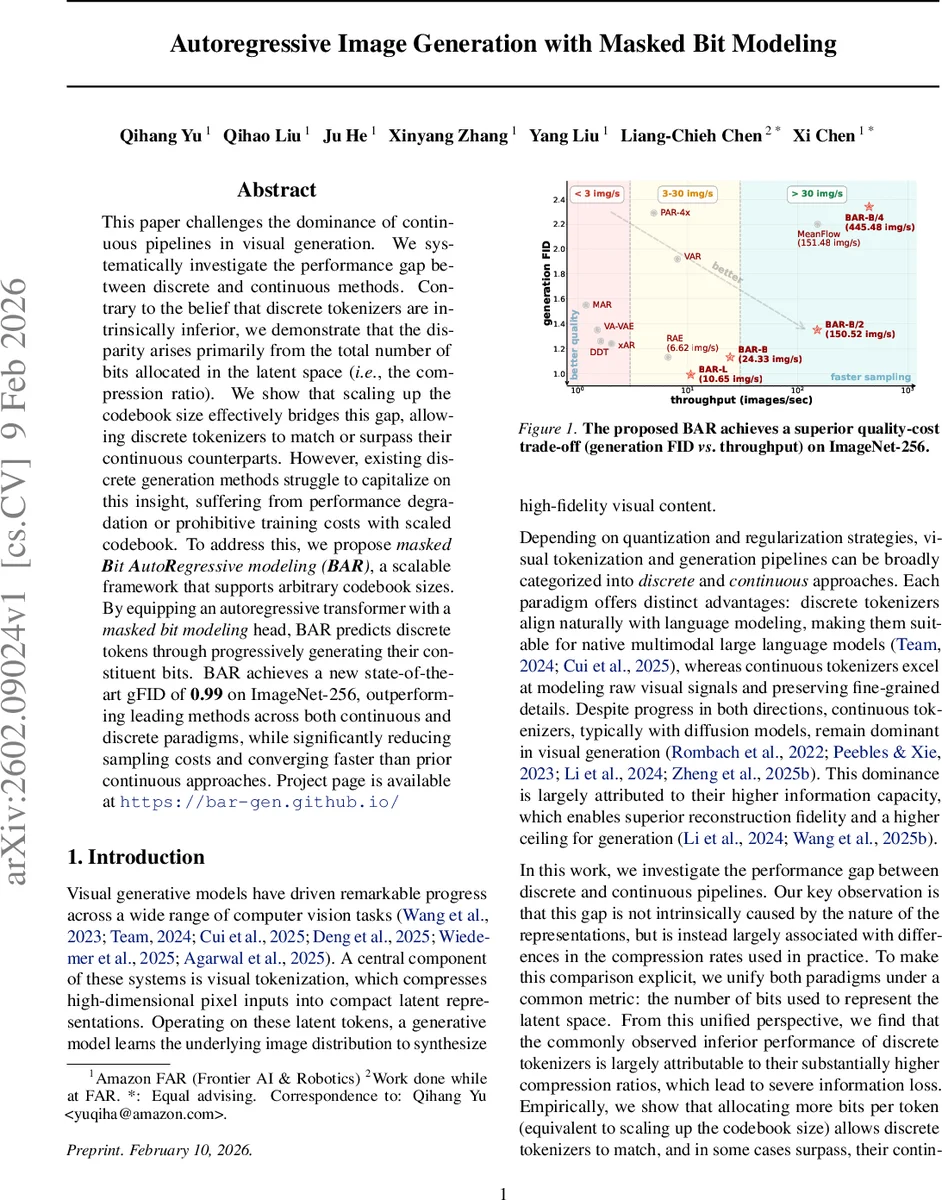

본 논문은 이미지 토크나이저의 성능 차이가 압축 비트 수에 기인한다는 점을 실험적으로 입증한다. 코드북 크기를 확대해 비트 예산을 늘리면 이산 토크나이저가 연속식 파이프라인을 능가할 수 있음을 보였다. 그러나 기존 이산 생성 모델은 대규모 코드북을 다루기 어려워 성능이 저하된다. 이를 해결하기 위해 저자들은 마스크 비트 자동회귀 모델(BAR)을 제안한다. BAR는 토큰 인덱스를 직접 예측하는 대신 비트를 순차적으로 생성하는 헤드를 도입해 무한대에 가까운 코드북 크기를 효율적으로 지원한다. 실험 결과 BAR는 ImageNet‑256에서 gFID 0.99를 달성하며, 연속식 확산 모델보다 3‑4배 빠른 샘플링 속도를 보였다.

상세 분석

이 논문은 시각 토크나이저를 “비트 예산(Bit Budget)”이라는 통일된 척도로 평가함으로써 이산·연속 파이프라인 간의 성능 격차를 정량화한다. 비트 예산은 이미지당 할당된 총 비트 수(H·W·f·log₂C 혹은 H·W·f·16·D)로 정의되며, 이는 압축률과 직접 연결된다. 실험 결과, 동일한 비트 예산을 갖는 경우 이산 토크나이저가 재구성 FID에서 연속식 VAE와 거의 동등하거나 오히려 우수함을 확인한다. 이는 기존에 이산 토크나이저가 열등하다고 여겨졌던 이유가 코드북 크기(즉, 비트 예산)의 제한 때문임을 시사한다.

하지만 코드북을 2¹⁸(262 K) 이상으로 확장하면 전통적인 자동회귀 모델은 어마어마한 어휘 크기로 인해 메모리·연산 부담이 급증하고, 학습이 불안정해진다. 이를 극복하기 위해 저자들은 “마스크 비트 자동회귀(Masked Bit Autoregressive, BAR)”라는 새로운 헤드를 설계한다. BAR는 토큰 인덱스를 직접 예측하는 대신, 각 토큰을 구성하는 비트 시퀀스를 마스크된 언어 모델처럼 순차적으로 예측한다. 이 방식은 (1) 어휘 크기에 독립적인 선형 연산을 유지해 메모리 요구량을 크게 낮추고, (2) 비트 단위의 확률 분포를 학습함으로써 대규모 코드북에서도 안정적인 학습이 가능하도록 만든다.

구현 측면에서 저자들은 FSQ(Fixed‑Size Quantizer)를 사용해 2²⁵⁶까지 확장 가능한 코드북을 구축한다. FSQ는 각 채널당 1비트를 할당하고, 채널 수를 늘려 코드북 크기를 조절한다. 이렇게 구성된 이산 토크나이저는 비트 예산을 65 536비트까지 확대해 재구성 rFID 0.33을 달성, 기존 SD‑VAE( rFID 0.62)를 능가한다.

학습 및 샘플링 효율성도 크게 개선되었다. BAR‑B/4, BAR‑B/2, BAR‑B 등 다양한 모델 크기에서 10 ~ 445 이미지/초의 처리량을 보이며, gFID 0.99를 기록한 최상위 모델은 415 M 파라미터에 불과하다. 이는 동일 성능을 내는 최신 확산 모델보다 3.68배 빠른 속도이며, One‑Step 모델인 MeanFlow와도 2.94배 속도 차이를 만든다.

결과적으로 이 논문은 (1) 이산 토크나이저의 성능 한계가 비트 예산에 있음을 실증하고, (2) 마스크 비트 헤드를 통해 대규모 코드북을 효율적으로 활용함으로써 이산 생성 모델이 연속식 확산 모델을 능가할 수 있음을 입증한다. 또한, 비트 기반 예측이 언어 모델링과 자연스럽게 결합되어 멀티모달 LLM과의 연계 가능성을 열어준다.

댓글 및 학술 토론

Loading comments...

의견 남기기