그리드 세계에서 LLM 에이전트의 목표 지향성 평가

초록

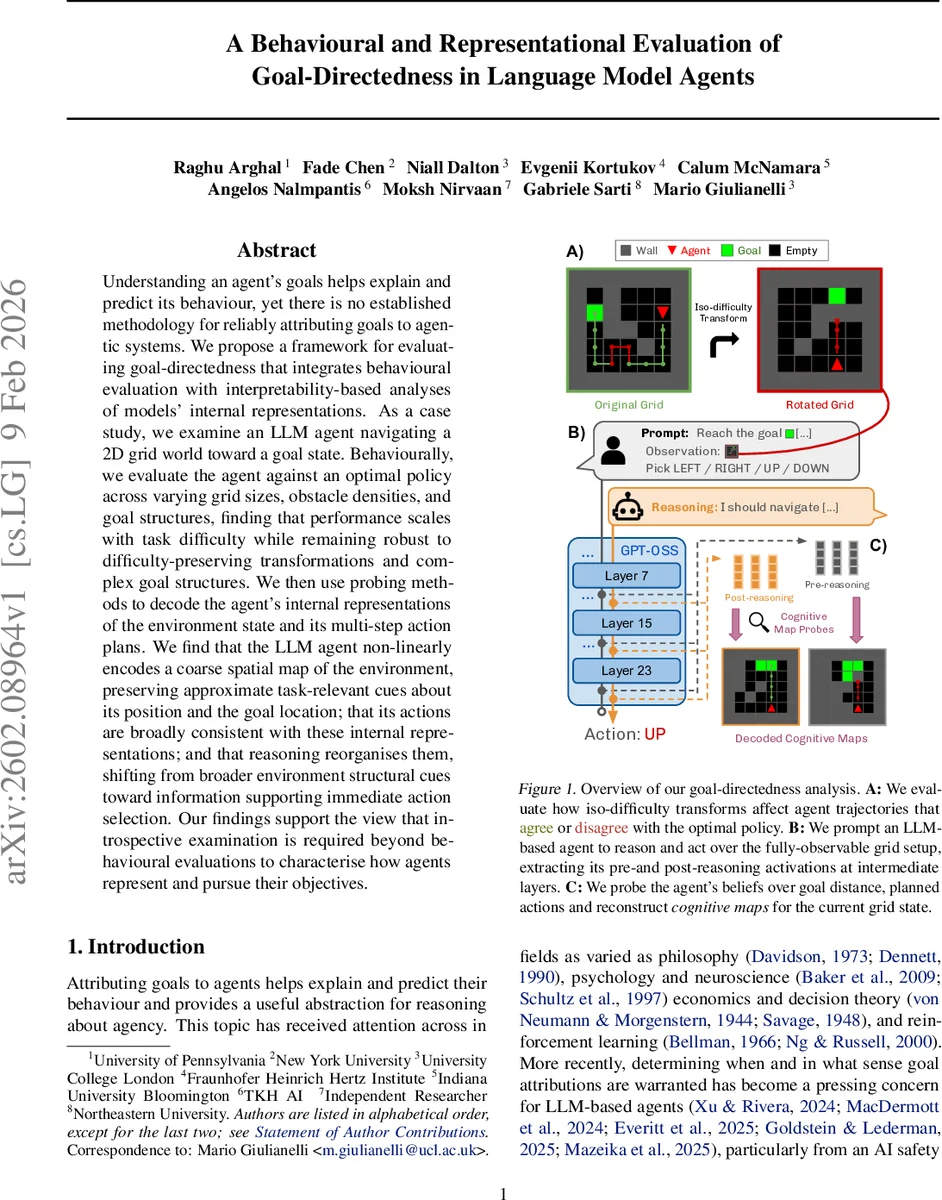

본 논문은 행동 평가와 내부 표현 탐사를 결합한 프레임워크를 제시하고, 완전 관측 가능한 2D 그리드 세계에서 GPT‑OSS‑20B 기반 에이전트가 목표 지점까지 이동하는 과정을 통해 목표 지향성을 정량·정성적으로 분석한다. 행동 측면에서는 최적 정책과의 정확도·JSD를 다양한 그리드 크기·장애물 밀도·변형에 대해 측정했으며, 내부 표현 측면에서는 프로빙 기법으로 에이전트가 위치·목표 및 다단계 행동 계획을 어떻게 코딩하는지 밝혀냈다. 결과는 행동만으로는 충분히 파악하기 어려운 내부 목표 표상이 존재함을 보여준다.

상세 분석

이 연구는 목표 지향성을 평가하기 위한 두 축, 즉 외부 행동과 내부 표현을 동시에 검증하는 ‘화이트박스’ 접근법을 제안한다. 행동 평가에서는 A* 기반 최적 정책을 기준으로 에이전트의 행동 정확도와 최적 정책과의 Jensen–Shannon Divergence(JSD)를 측정하였다. 그리드 크기(7×715×15)와 장애물 밀도(0.01.0)의 조합 30여 가지에 대해 10개의 무작위 그리드와 각각 10개의 트래젝터리를 생성, 온도 0.7의 샘플링으로 정책을 추정하였다. 결과는 그리드가 커지고 장애물이 많아질수록 행동 정확도가 선형적으로 감소하고 JSD가 증가함을 보여준다. 특히 목표와의 거리 역시 정확도 저하와 불확실성 증가에 기여했으며, 20스텝 이하에서는 선형 관계가 뚜렷했다.

다음 단계로 ‘iso‑difficulty’ 변환(반사, 90도 회전, 시작‑목표 교환, 전치)을 적용했을 때 행동 지표에 유의미한 차이가 없음을 확인함으로써 에이전트가 특정 배치에 편향되지 않고 난이도에만 민감함을 입증했다.

내부 표현 분석에서는 레이어별 활성값에 대해 선형·비선형 프로빙 클래스를 훈련시켜, (1) 현재 위치와 목표 위치에 대한 ‘인지 지도’를 복원하고, (2) 다단계 행동 계획을 디코딩했다. 흥미롭게도 사전 추론(pre‑reasoning) 단계에서는 넓은 공간 구조와 장기 계획이 유지되는 반면, 추론 후(post‑reasoning) 단계에서는 즉시 행동 선택에 필요한 정보가 강조되는 ‘재구성’ 현상이 관찰되었다. 이는 LLM이 추론 과정에서 목표‑지향적 표상을 동적으로 재편성한다는 증거다.

또한, 프로빙 결과는 에이전트가 환경 상태를 완전하게 재현하지는 않지만, 목표 달성에 필요한 핵심 좌표와 거리 정보를 비선형적으로 압축해 저장한다는 점을 시사한다. 이러한 내부 표상은 행동 정확도와 높은 상관관계를 보였으며, 행동이 최적 정책과 일치하지 않을 때도 내부 표상은 일관된 목표 정보를 유지한다는 점에서 ‘내재된 목표 의도’를 추론할 수 있는 근거가 된다.

전반적으로 이 논문은 (1) 행동만으로는 목표 지향성을 완전히 판단하기 어렵고, (2) 내부 표상의 해석이 목표 추론에 필수적이며, (3) LLM 기반 에이전트가 복합적인 환경에서도 목표‑관련 정보를 비선형적으로 코딩하고 추론 과정에서 재구성한다는 세 가지 주요 통찰을 제공한다. 이러한 발견은 AI 안전·정렬 연구에서 에이전트의 내부 목표 표상을 모니터링하고 조정하는 새로운 방법론의 토대를 마련한다.

댓글 및 학술 토론

Loading comments...

의견 남기기