테스트 시점 적응형 연산을 위한 신뢰도 기반 자기정제 프레임워크 CoRefine

초록

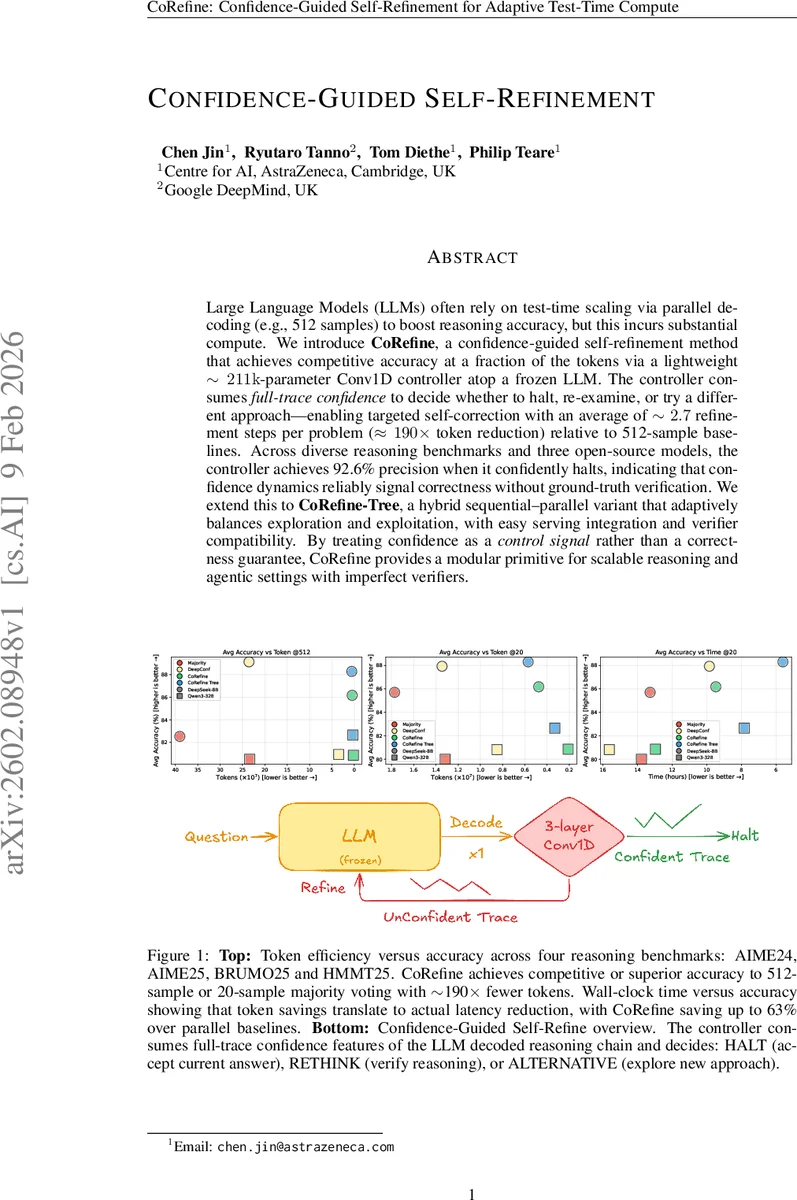

CoRefine은 대규모 언어 모델의 토큰‑레벨 신뢰도 정보를 활용해, 211 k 파라미터 규모의 경량 Conv1D 컨트롤러가 “HALT·RETHINK·ALTERNATIVE” 세 가지 행동을 선택하도록 한다. 평균 2.7번의 정제 단계만으로 512‑샘플 병렬 디코딩 대비 약 190배 적은 토큰을 사용하면서도 동등하거나 우수한 정확도를 달성한다. 신뢰도 패턴이 정확성을 직접 예측하지는 않지만, “신뢰도는 제어 신호”라는 관점에서 효율적인 정제 시점과 방법을 결정한다.

상세 분석

CoRefine은 기존의 테스트‑타임 스케일링, 즉 수백 개의 샘플을 병렬로 생성해 다수결로 정답을 선택하는 방식이 연산 비용을 급격히 증가시킨다는 문제를 근본적으로 재구성한다. 핵심 아이디어는 LLM이 생성 과정에서 제공하는 토큰‑레벨 로그확률을 이용해 ‘신뢰도 트레이스’를 만든 뒤, 이를 압축·특징화하여 경량 컨트롤러에 입력하는 것이다. 신뢰도는 상위 k (=20) 토큰의 평균 로그확률의 부호 반전값으로 정의되며, 높은 값은 확률 분포가 뾰족함을, 낮은 값은 불확실성을 의미한다.

실험적으로 두 모델(DeepSeek‑8B, Qwen3‑32B)의 2만 여개 이상 추론 트레이스를 분석했을 때, 올바른 추론은 후기 단계에서 일관되게 신뢰도가 상승하고, 오류가 있는 추론은 초기에는 과도하게 높은 신뢰도를 보이다가 후기에는 급격히 하락하는 ‘초기 과신 패러독스’를 보였다. 이러한 패턴은 모델마다 차이가 있지만, 전반적인 ‘신뢰도는 시간에 따라 변한다’는 사실이 컨트롤러가 학습할 충분한 신호임을 입증한다.

컨트롤러는 16개의 다운샘플링된 신뢰도 구간을 입력으로 받아 1‑D ConvNet(64‑128‑256 필터, 커널

댓글 및 학술 토론

Loading comments...

의견 남기기