제스처와 언어로 추상화: 협업 물리 작업에서 다중모달 관습 형성

초록

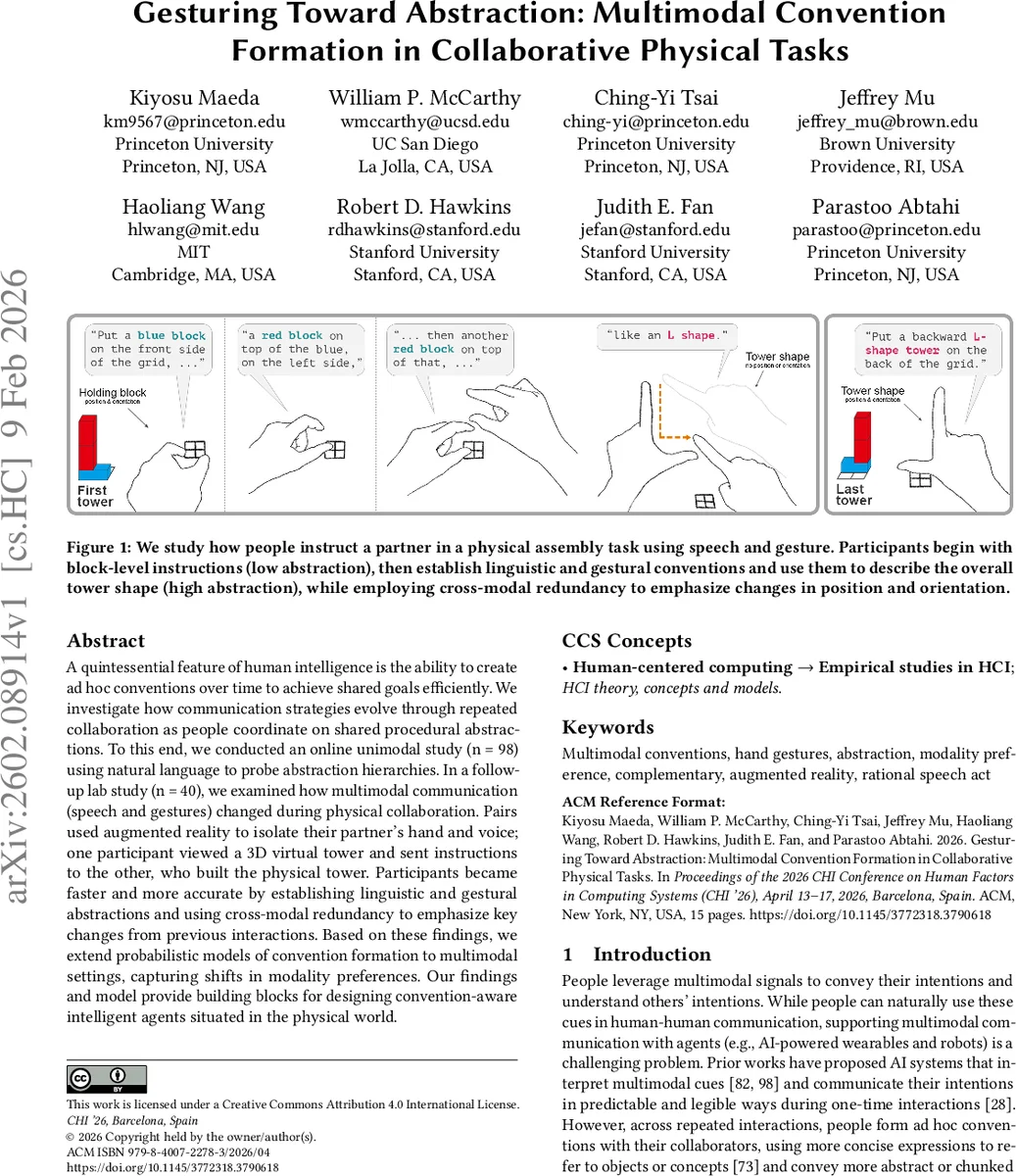

본 연구는 반복적인 물리 조립 과제에서 말과 손짓을 이용해 어떻게 추상적인 관습이 형성되는지를 조사한다. 온라인 단일모달 실험으로 언어적 추상화 과정을 확인하고, AR 실험에서 음성·제스처가 어떻게 상호보완·중복되어 효율성을 높이는지 분석한다. 또한 RSA 기반 확률 모델을 다중모달 어휘에 확장해 관습 형성과 모달리티 전환을 정량화한다.

상세 분석

이 논문은 인간‑인간 협업에서 관습이 어떻게 진화하는지를 다중모달 관점에서 최초로 체계화한 점이 큰 의의다. 먼저 98명의 참가자를 대상으로 한 온라인 텍스트 실험에서는 동일한 블록 타워를 반복 제시하면서 참가자들이 블록‑레벨 설명에서 타워‑레벨 추상 표현으로 전환하는 과정을 정량화했다. 평균 F1 점수가 초기 0.88에서 0.98로 상승하고, 지시 길이가 8.5단어씩 감소한다는 결과는 언어적 압축이 빠르게 일어남을 보여준다. 이어 40명의 페어를 대상으로 한 AR 실험에서는 한 사람은 가상 3D 타워를 보고, 다른 사람은 물리적 블록을 조립한다. AR 헤드셋을 이용해 파트너의 손과 음성을 차단함으로써 순수한 음성·제스처 정보를 분리했다. 실험 결과, 반복이 진행될수록 참가자들은 “업사이드‑다운 U”, “롱 C”, “롱 L” 등 고유한 제스처와 용어를 도입해 추상화 수준을 높였으며, 특히 타워‑레벨 변화를 전달할 때 음성과 제스처를 동시에 사용해 교차‑모달 중복을 강화했다. 이는 정보 전달의 신뢰성을 높이는 동시에 인지 부하를 감소시키는 전략으로 해석된다. 모델링 측면에서는 기존 Rational Speech Act(RSA) 프레임워크를 확장해 다중모달 어휘를 연속값으로 표현하고, 관습 형성 과정에서 모달리티 선택 확률을 학습하도록 설계했다. 시뮬레이션은 인간 데이터와 일치하게 추상 프로그램을 습득하고, 참가자별로 음성‑제스처 사용 비중이 어떻게 변하는지를 재현한다. 이 모델은 관습‑인식 에이전트가 인간 파트너와 장기 협업 시 적절히 모달리티를 전환하고, 새로운 추상 개념을 공동으로 정의할 수 있는 기반을 제공한다. 논문의 기여는 (1) 대규모 온라인 언어 실험, (2) AR 기반 다중모달 물리 실험 및 데이터셋 공개, (3) 다중모달 관습 형성을 포괄하는 확률 모델 제시이며, 향후 인간‑로봇 협업 시스템 설계에 직접 적용 가능성을 시사한다. 다만, 실험 환경이 제한된 실내 AR 설정이며, 제스처 인식 정확도와 음성 잡음 등에 대한 외부 타당성 검증이 부족한 점은 향후 연구에서 보완되어야 한다.

댓글 및 학술 토론

Loading comments...

의견 남기기