데이터 레이크 간 컬럼 타입 자동 라벨링, LakeHopper로 적은 비용에 적응하기

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

**

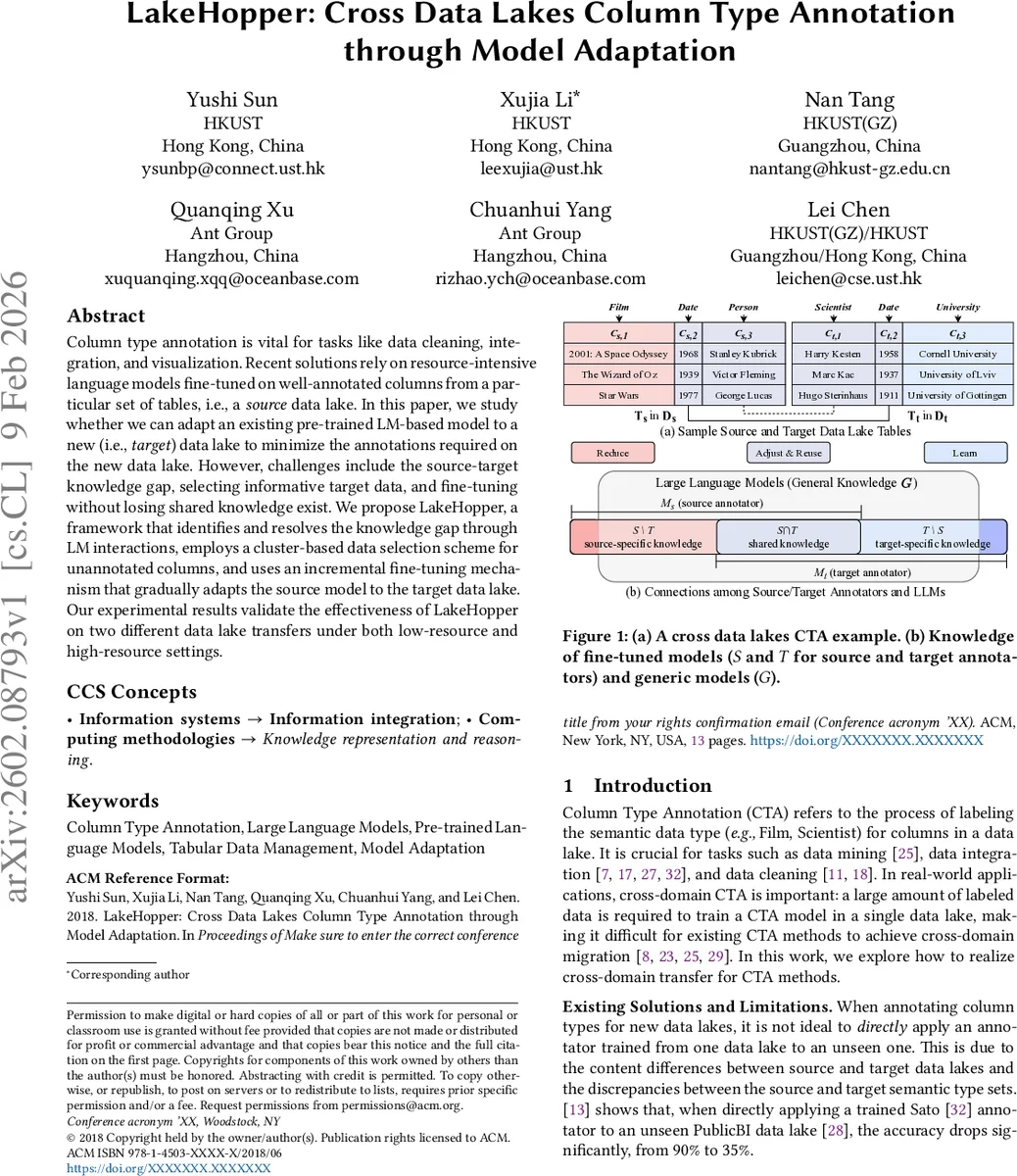

LakeHopper는 기존에 학습된 대규모 언어 모델(LLM)을 새로운 데이터 레이크에 최소한의 라벨링만으로 빠르게 적응시키는 프레임워크이다. 소스‑타깃 간 지식 격차를 LM‑기반 질의·응답으로 탐지하고, 라벨 집합 차이를 보정한 뒤, 클러스터 기반 샘플 선택으로 핵심 컬럼을 선별한다. 이후 점진적(인크리멘털) 파인튜닝을 통해 공유 지식은 유지하면서 타깃 특화 지식을 습득한다. 실험 결과 두 개의 서로 다른 레이크 전이에서 저자원·고자원 설정 모두 기존 방법보다 높은 정확도와 제로‑샷 성능을 보였다.

**

상세 분석

**

본 논문은 컬럼 타입 어노테이션이 데이터 정제·통합·시각화에 필수적임을 전제로, 기존 방법이 대규모 라벨링 비용과 특정 레이크에 종속된 한계를 지적한다. 이를 해결하기 위해 제안된 LakeHopper는 세 가지 핵심 모듈로 구성된다.

-

지식 격차 식별(Knowledge Gap Identification)

- 소스 어노테이터 Mₛ와 타깃 어노테이터 Mₜ가 공유하는 라벨 집합 S와 타깃 전용 라벨 T를 정의하고, S∩T와 S\T, T\S을 명시적으로 구분한다.

- 라벨 집합 차이 조정(Label Set Difference Adjustment) 단계에서 소스 모델 출력 레이어를 재구성해 S와 T 사이의 매핑을 학습한다. 이는 “Scientist”와 “Person”처럼 미세한 의미 차이를 보정한다.

- LM‑기반 질의·응답을 활용해 S와 T 사이의 의미적 차이를 정량화하고, 차이가 큰 컬럼에 대해 Φ(v) 값을 계산해 지식 격차를 시각화한다.

-

타깃 샘플 선택(Weak Sample Selection)

- 전체 타깃 컬럼을 임베딩하고 K‑means 클러스터링을 수행한다. 각 클러스터에서 대표성을 갖는 Nₜ 개의 샘플을 선택해 라벨링 비용을 최소화한다.

- 선택된 샘플은 Mₜ 의 초기 파인튜닝 데이터로 사용되며, 클러스터 중심과 라벨 불확실도(Entropy)를 결합해 정보량이 높은 컬럼을 우선한다.

-

점진적 파인튜닝(Incremental Fine‑tuning)

- 첫 번째 라운드에서는 선택된 샘플만으로 Mₜ,0 을 학습한다. 이후 Mₜ,i 의 출력이 Mₛ 와 크게 차이나는 컬럼을 재선별해 추가 파인튜닝을 수행한다(갭‑홉핑).

- 파라미터 동결 전략을 도입해 공유 지식(일반 언어 이해)은 유지하고, 타깃 전용 파라미터만 점진적으로 업데이트한다. 이는 catastrophic forgetting을 방지한다.

실험에서는 (1) 영화·인물 메타데이터 레이크와 (2) 과학·대학 레이크 사이의 전이를 수행했으며, 저자원(라벨 1 % 이하)·고자원(라벨 10 % 이상) 모두에서 기존 PLM‑기반, LLM‑기반, LLM‑+ 방법보다 평균 +8 %~+15 %의 F1 점수를 기록했다. 특히 라벨이 전혀 없는 제로‑샷 상황에서도 S∩T 에 해당하는 컬럼에 대해 70 % 이상의 정확도를 달성했다.

주요 인사이트

- 라벨 집합 차이를 명시적으로 모델에 반영하면 소스와 타깃 간 의미 격차를 효과적으로 메꿀 수 있다.

- 클러스터 기반 샘플 선택은 데이터 규모가 클 때도 라벨링 비용을 크게 절감한다.

- 점진적 파인튜닝은 공유 지식을 보존하면서 새로운 도메인에 적응하는 가장 안정적인 방법으로 확인되었다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기