가우시안 스플래팅 기반 효율적 카메라 레이다 융합

초록

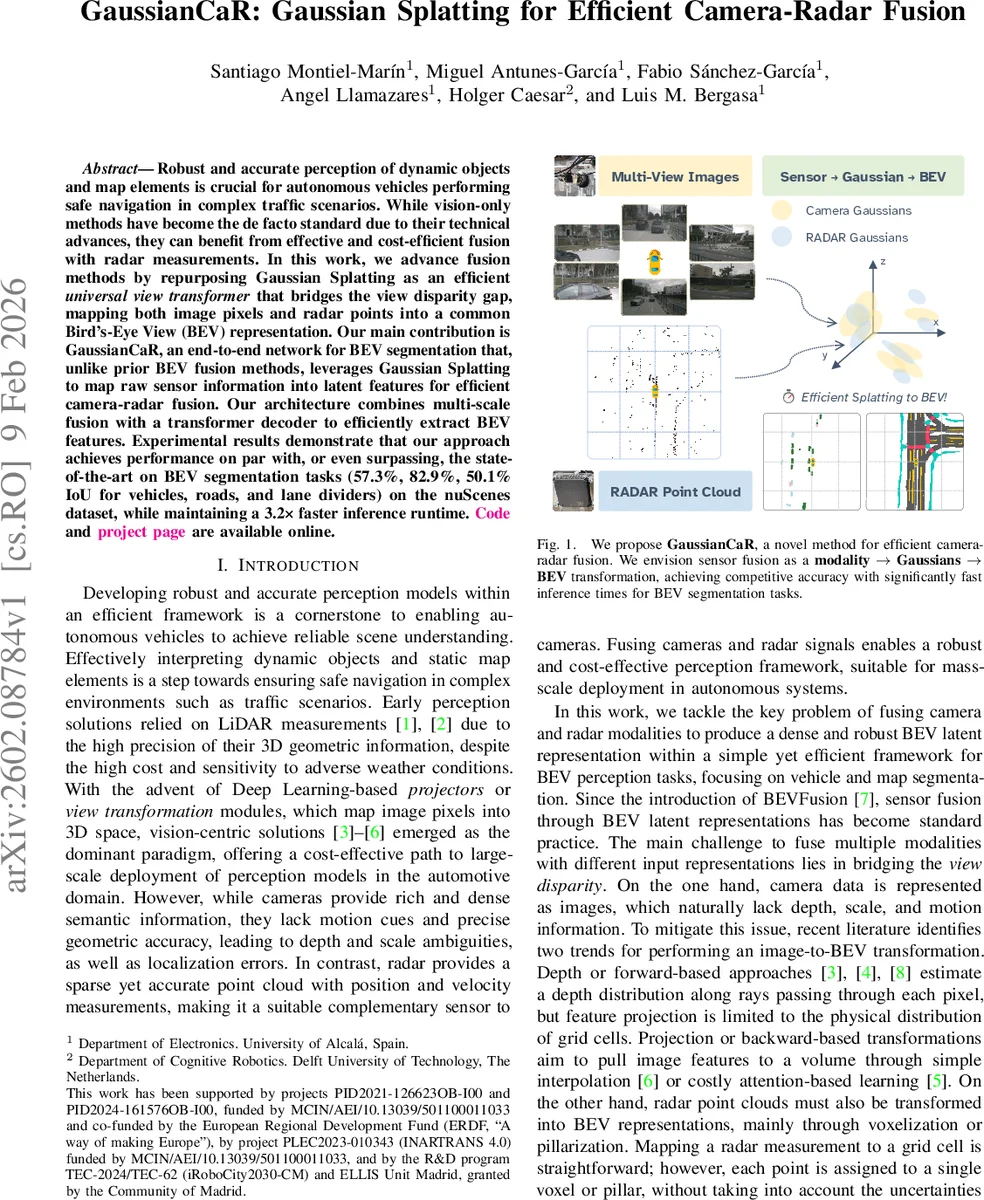

본 논문은 Gaussian Splatting을 보편적인 뷰 변환기로 활용하여 다중 카메라 이미지와 레이다 포인트 클라우드를 공통의 Bird‑Eye View(BEV) 공간으로 매핑한다. 픽셀‑투‑가우시안과 포인트‑투‑가우시안 두 인코더를 통해 각각의 센서 특징을 3차원 가우시안 프리미티브로 변환하고, 차별화 가능한 가우시안 레스터라이징으로 BEV 특징을 생성한다. 이후 멀티스케일 트랜스포머 기반 융합 및 DPT 디코더를 적용해 차량, 도로, 차선 등 세 가지 클래스를 동시에 세그멘테이션한다. nuScenes 데이터셋에서 기존 최첨단 방법과 동등하거나 상회하는 IoU(차량 57.3 %, 도로 82.9 %, 차선 50.1 %)를 달성하면서, 추론 속도는 3.2배 가속화하였다.

상세 분석

GaussianCaR는 기존 BEV‑Fusion 파이프라인이 직면한 ‘뷰 격차(view disparity)’ 문제를 근본적으로 재구성한다. 카메라 이미지와 레이다 포인트를 각각 픽셀‑투‑가우시안(Pixels‑to‑Gaussians)과 포인트‑투‑가우시안(Points‑to‑Gaussians) 모듈을 통해 3‑D 가우시안 집합으로 변환함으로써, 두 센서의 데이터 형식 차이를 가우시안이라는 공통 표현으로 통일한다. 이 과정에서 가우시안은 위치(p), 크기(s), 회전(R), 불투명도(α), 그리고 고차원 특징(f)으로 파라미터화되며, 특히 위치 추정은 coarse‑to‑fine 전략을 사용한다. 깊이 히스토그램을 기반으로 한 coarse 단계에서 광선상의 확률 분포를 추정하고, offset 헤드를 통해 연속적인 미세 조정을 수행함으로써 이산적인 깊이 bin의 한계를 극복한다. 또한, 가우시안의 공분산 행렬을 통해 측정 불확실성을 명시적으로 모델링하고, 이를 스케일과 회전에 반영한다는 점이 기존 voxel‑based 혹은 pillar‑based 레이다 변환 방식보다 훨씬 풍부한 공간 정보를 제공한다.

레이다 측면에서는 경량화된 Point Transformer v3(PTv3)를 이용해 포인트 클라우드의 지역적·전역적 컨텍스트를 캡처한다. PTv3는 공간‑필링 커브와 이웃 매핑을 통해 포인트를 순차적인 토큰 시퀀스로 변환하고, 패치‑단위 어텐션을 적용해 효율적인 특징 집합을 만든다. 이후 MLP 헤드가 레이다 포인트를 가우시안 파라미터로 변환하는데, 여기서는 이미 알려진 포인트 위치를 기반으로 offset만을 예측해 위치 정밀도를 높인다. 크기와 회전은 공분산 행렬의 6개 요소를 직접 예측하고, softplus 활성화를 통해 양의 고유값을 보장한다.

두 모달리티에서 생성된 가우시안 집합은 차별화 가능한 가우시안 레스터라이징을 통해 BEV 평면에 투사된다. 이때 orthographic projection을 사용해 깊이와 스케일 정보를 보존하면서, 불투명도 α에 따라 각 가우시안의 기여도를 가중한다. 결과적으로 고밀도이면서도 불확실성을 내포한 BEV 특징 맵이 형성된다.

Fusion 단계에서는 CMX 기반 멀티스케일 융합기를 도입해 카메라와 레이다 가우시안 특징을 BEV 레벨에서 결합한다. CMX는 cross‑modal attention을 활용해 서로 다른 스케일의 특징을 정교히 정렬하고, 정보 손실을 최소화한다. 이후 DPT(Depth‑aware Pyramid Transformer) 디코더가 다중 레이어 트랜스포머 구조로 BEV 특징을 단계별로 업샘플링하고, 최종적으로 차량, 도로, 차선에 대한 픽셀‑레벨 세그멘테이션 맵을 출력한다.

실험 결과는 nuScenes 베이스라인과 비교했을 때, 차량(57.3 % IoU), 도로(82.9 % IoU), 차선(50.1 % IoU)에서 기존 최첨단 방법과 동등하거나 약간 상회함을 보여준다. 특히 추론 시간은 3.2배 가속화되어 실시간 적용 가능성을 크게 높였다. 메모리 사용량 또한 가우시안 파라미터(≈128‑차원)와 효율적인 레스터라이징 덕분에 기존 voxel‑based 방법보다 훨씬 낮다.

핵심 기여는 (1) 가우시안 스플래팅을 보편적인 뷰 변환기로 재정의함으로써 이미지와 레이다를 동일한 연산 파이프라인에 통합, (2) 불확실성을 명시적으로 모델링한 가우시안 파라미터를 통해 sparse 레이다 데이터를 효과적으로 보강, (3) 경량화된 트랜스포머 기반 인코더와 CMX 융합기로 고성능·고효율 BEV 세그멘테이션을 구현했다는 점이다. 이러한 설계는 향후 라이다 없이도 레이다와 카메라만으로도 충분히 정밀한 BEV 인식을 가능하게 하며, 비용 효율적인 자율주행 시스템에 큰 파급 효과를 기대한다.

댓글 및 학술 토론

Loading comments...

의견 남기기