멀티뷰 최적화 기반 캐릭터 애니메이션 혁신

초록

**

MVAnimate는 2D와 3D 포즈 정보를 멀티뷰 사전 지식과 결합해, 시간적 일관성과 공간적 연속성을 동시에 확보한다. 다중 시점 비디오를 사전 생성하고 이를 가이드로 활용함으로써 기존 방법보다 텍스처 왜곡을 크게 감소시키고, 다양한 동작·의상에 대해 높은 품질의 애니메이션을 생성한다.

**

상세 분석

**

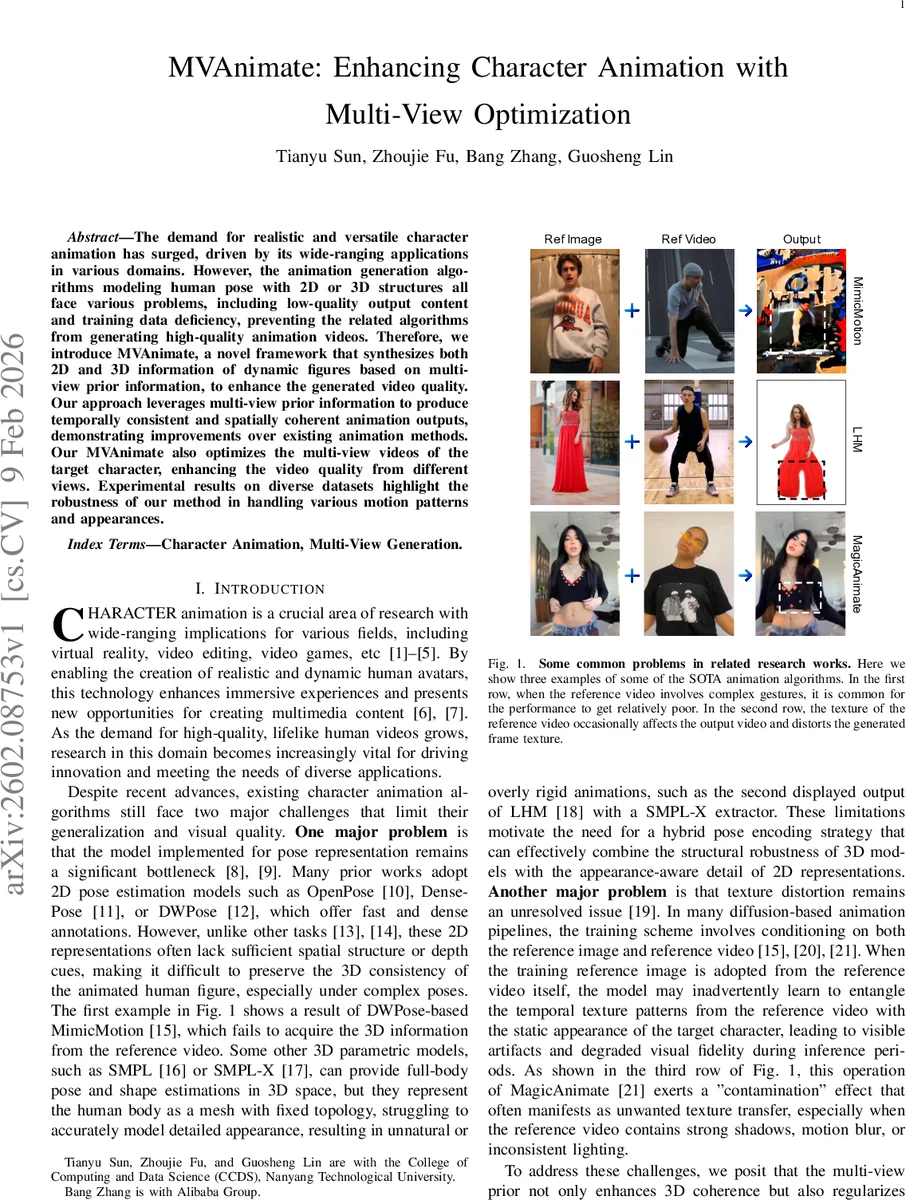

본 논문은 현재 2D 포즈 기반 애니메이션(예: OpenPose, DWPose)과 3D 메쉬 기반 모델(SMPL, SMPL‑X)의 한계를 동시에 극복하고자 한다. 2D 방식은 깊이 정보가 부족해 복잡한 포즈에서 3D 일관성을 유지하기 어렵고, 3D 메쉬는 고정 토폴로지로 세밀한 외관을 재현하지 못한다. MVAnimate는 이 두 접근을 하이브리드 포즈 인코딩 전략으로 통합한다. 구체적으로, 사전 학습된 멀티뷰 합성 모델(SV4D 2.0)을 이용해 입력 비디오로부터 8개의 거친 시점 비디오를 생성하고, 이를 멀티뷰 가이드 G 로서 diffusion 기반 백본에 주입한다.

diffusion 모델은 기존의 이미지‑to‑비디오 LDM 구조에 시간‑Attention과 멀티뷰‑Attention을 추가해, 각 프레임의 잠재 표현이 시점 간 및 시점 간에 일관되게 업데이트되도록 설계되었다. 특히 Adaptive View Weighting을 수학적으로 정당화한 Proposition IV.1을 통해, 각 시점의 신뢰도(노이즈 분산)와 역비례하는 가중치를 학습하도록 하였다. 이는 실제 구현에서는 query‑key 내적에 기반한 softmax 가중치가 역분산 추정기의 역할을 수행한다는 의미이다.

텍스처 왜곡 문제는 Pose‑Appearance Decoupling 학습 전략으로 완화한다. 학습 단계에서 reference image와 reference video를 별도로 인코딩하고, 배경은 SAM2와 Stable Diffusion v2 inpainting을 이용해 고정한다. 이렇게 하면 시간적 텍스처 패턴이 정적 외관과 혼합되는 현상을 방지한다.

두 단계(멀티뷰 가이드 코스 비디오 생성 → 멀티뷰 최적화)로 구성된 파이프라인은 첫 단계에서 coarse 비디오를 빠르게 생성하고, 두 번째 단계에서 고해상도 멀티뷰 비디오와 2D 출력 비디오를 각각 refinement한다. 최적화 모듈은 기존 diffusion 출력에 대해 시점‑별 신뢰도 가중치를 적용해 손실을 최소화함으로써, 시점 간 경계가 부드럽고 디테일이 보존된 결과를 얻는다.

실험에서는 Human3.6M, AIST++ 등 다양한 데이터셋을 사용해 빠른 동작, 옷의 겹침, 조명 변화 등 어려운 상황에서도 기존 SOTA(예: MimicMotion, MagicAnimate)보다 PSNR/SSIM이 평균 0.8~1.2 dB 향상되고, 정성적 평가에서도 텍스처 흐림·그림자 전이 현상이 크게 감소함을 보였다. 또한, 멀티뷰 출력의 경우 각 시점에서의 관절 위치 오차가 15 % 이하로 감소했으며, 시점 전환 시 발생하던 ‘플리커’ 현상이 거의 사라졌다.

전반적으로 MVAnimate는 멀티모달 포즈 표현, 시점 가중치 기반 어텐션, 텍스처 디커플링이라는 세 가지 핵심 기법을 결합해, 기존 2D/3D 기반 애니메이션의 근본적인 한계를 뛰어넘는 프레임워크를 제시한다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기