저조도 비디오 향상을 위한 시공간 분해와 양방향 대응 학습

초록

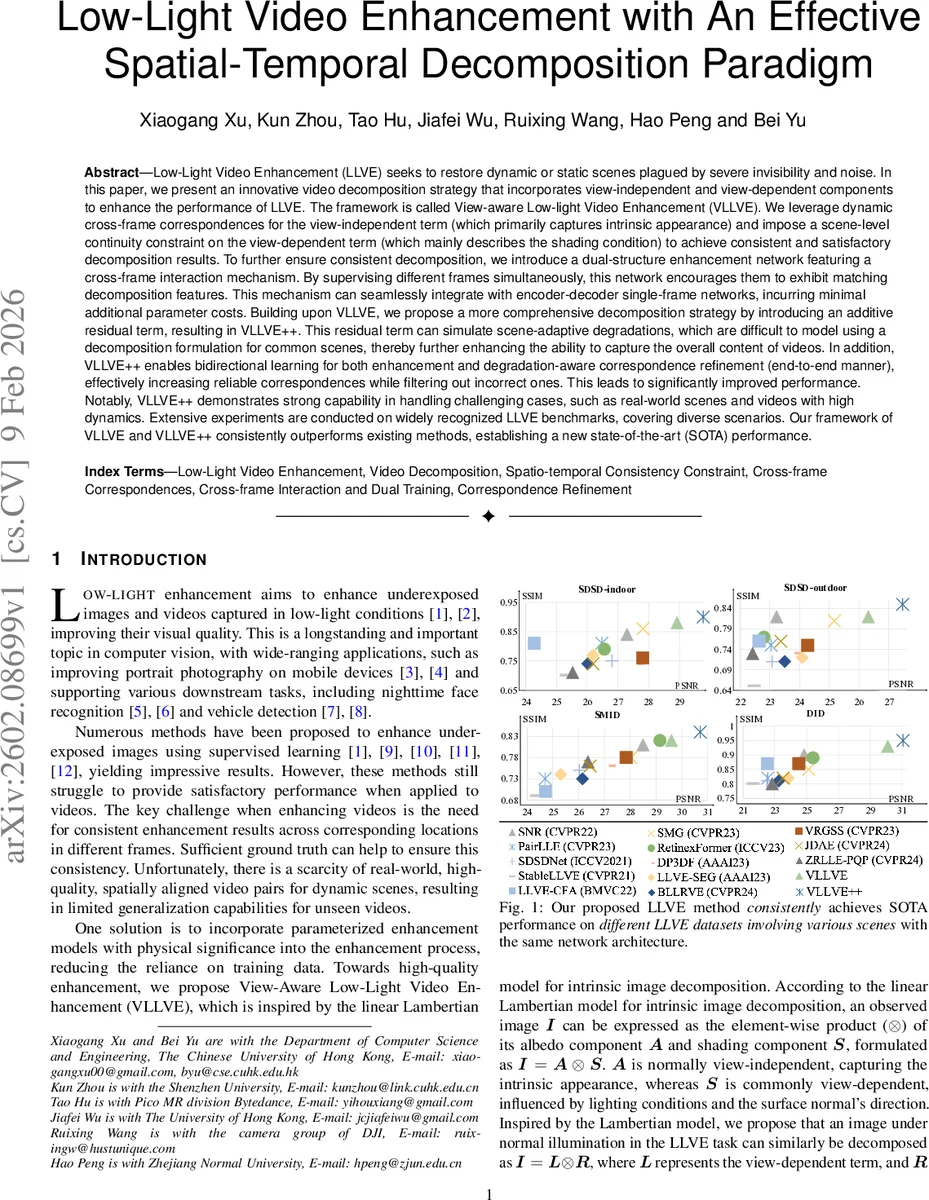

본 논문은 저조도 비디오를 향상시키기 위해 영상의 고유 색(뷰‑독립)과 조명(뷰‑종속)을 분리하는 새로운 분해 프레임워크 VLLVE를 제안한다. 교차 프레임 대응을 이용해 뷰‑독립 성분을 일관되게 추정하고, 뷰‑종속 성분에는 연속성 제약을 부여한다. 또한, 두 프레임 사이의 상호작용을 담당하는 Cross‑Frame Interaction Module(CFIM)을 기존 인코더‑디코더 구조에 최소 비용으로 삽입한다. VLLVE에 잔차 항 B를 추가해 보다 복잡한 조명·노이즈 현상을 모델링한 VLLVE++를 설계하고, 향상 네트워크와 대응 정제 네트워크를 동시에 학습시키는 양방향 학습 방식을 도입한다. 다양한 공개 저조도 비디오 데이터셋에서 기존 최첨단 방법들을 크게 앞서는 성능을 기록한다.

상세 분석

본 연구는 저조도 비디오 향상(LLVE) 분야에서 물리‑기반 이미지 분해와 시공간 일관성 제약을 결합한 혁신적인 접근법을 제시한다. 기존 저조도 이미지 강화 기법은 주로 정적 이미지에 초점을 맞추어 프레임별로 독립적인 처리만을 수행했으며, 그 결과 비디오에서는 플리커링(flickering) 현상이 빈번히 발생한다. 저자들은 라멘버트(Lambertian) 모델을 차용해 관측 영상 I를 “뷰‑종속 조명 L”과 “뷰‑독립 반사율 R”의 요소별 곱으로 표현한다(I = L ⊗ R). 이때 L은 조명 강도와 같은 시점‑의존적 특성을, R은 물체 고유 색·텍스처와 같은 시점‑독립적 특성을 담당한다.

핵심 아이디어는 다중 프레임 간의 대응(correspondence)을 활용해 R의 시공간 일관성을 강제하고, L에 대해서는 연속성(continuity) 제약을 부여함으로써 두 성분을 동시에 학습한다는 점이다. 구체적으로, 저자는 사전 학습된 광학 흐름/특징 매칭 네트워크 F를 이용해 각 프레임 쌍 사이의 M개의 대응점 cₘ과 불확실도 uₘ을 추출한다. 이후 R에 대한 손실 O(R₁,R₂)=∑ₘ uₘ‖R₁

댓글 및 학술 토론

Loading comments...

의견 남기기