표 이해 메커니즘: 셀 위치 추론의 단계별 해부

초록

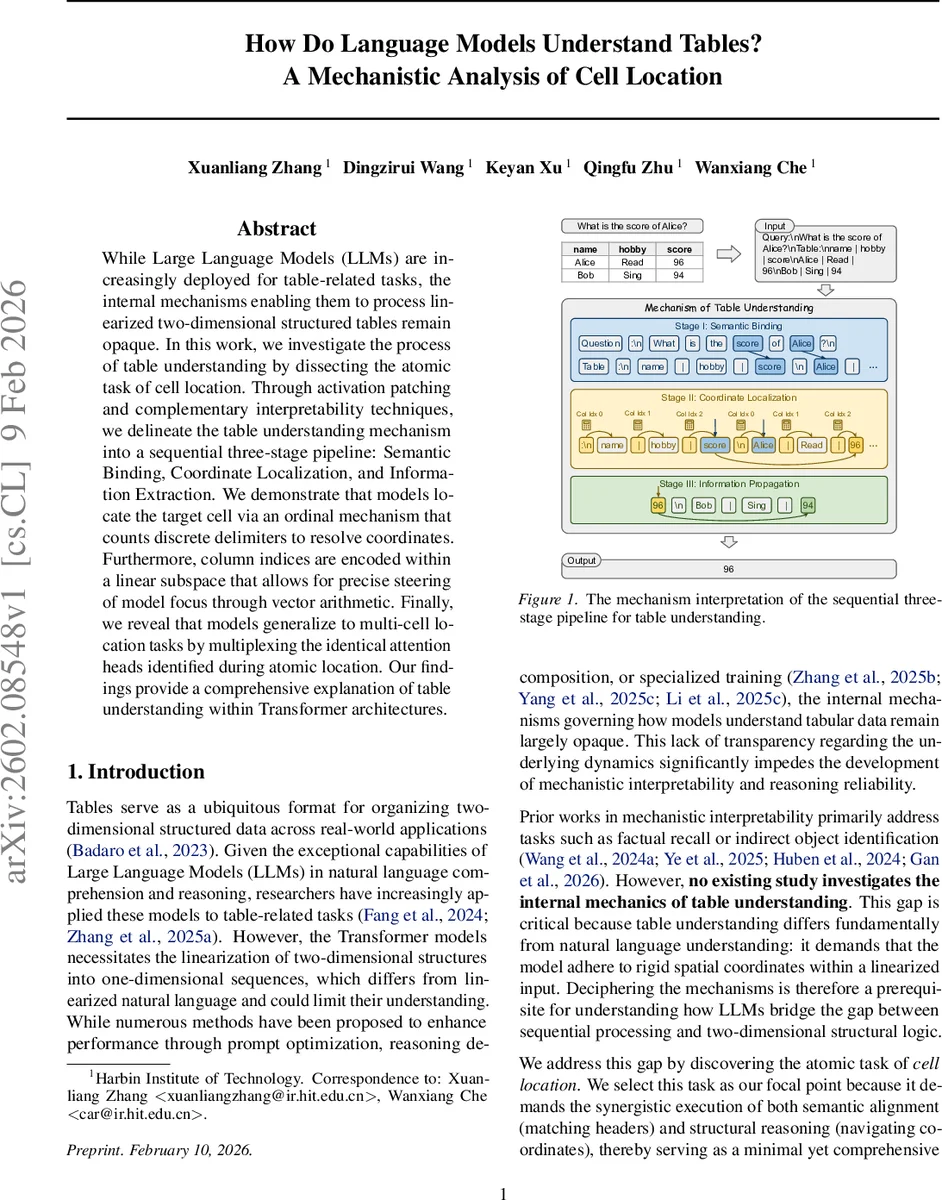

본 논문은 대형 언어 모델이 선형화된 표 데이터를 어떻게 이해하는지를 셀 위치 추론이라는 원자적 과업을 통해 규명한다. 활성화 패칭, 선형 탐사, 어텐션 억제 등 해석 기법을 결합해 모델이 ‘의미 결합 → 좌표 로컬라이제이션 → 정보 추출’이라는 3단계 파이프라인으로 동작함을 밝혀냈으며, 열 인덱스가 선형 서브스페이스에 암묵적으로 인코딩된다는 점을 확인한다.

상세 분석

이 연구는 Qwen‑3‑4B와 Llama‑3 시리즈 등 최신 디코더‑전용 트랜스포머를 대상으로, 표를 마크다운 파이프(‘|’)와 개행으로 직렬화한 입력에 대해 “행 헤더와 열 헤더를 지정한 셀 값을 반환하라”는 질문을 던지는 셀 위치 과업을 설계하였다. 모델이 단순히 사전 지식을 꺼내는 것이 아니라 입력 컨텍스트에 기반해 구조적 좌표를 계산한다는 점을 보장하기 위해, 셀 값은 무작위 엔티티 풀에서 추출한 난수로 채워졌다.

활성화 패칭 실험에서는 두 가지 변형을 만든다. 첫 번째는 질문에 포함된 열 헤더를 다른 열로 교체해 목표 셀을 옮기는 ‘컬럼 패칭’, 두 번째는 행 헤더를 교체하는 ‘행 패칭’이다. 각 레이어·헤드별로 깨끗한 실행과 변형 실행 사이의 로짓 차이를 측정해 Effect Score를 계산했으며, 1에 가까운 점수는 해당 컴포넌트가 과업 수행에 필수적임을 의미한다.

결과는 레이어 1‑16에서 질문 토큰과 표 헤더 간의 코사인 유사도가 급격히 상승하면서 의미 결합(Semantic Binding)이 이루어짐을 보여준다. 특히 행 헤더와 열 헤더를 각각 매핑하는 전용 어텐션 헤드가 존재하며, 이 헤드들을 0으로 억제하면 정확도가 94 %에서 5 % 수준으로 급락한다. 이는 초기 레이어에서 의미 매핑이 모델의 성공에 결정적이라는 증거다.

중간 레이어 17‑23에서는 효과 점수가 헤더에서 목표 셀 토큰 영역으로 이동한다. 여기서 모델은 ‘좌표 로컬라이제이션(Coordinate Localization)’ 단계로 전환해, 파이프 구분자를 카운트하는 순서 메커니즘을 사용해 행·열 인덱스를 내부적으로 계산한다. 선형 탐사 결과, 해당 레이어의 잔차 스트림은 행·열 인덱스를 높은 R²(>0.85)로 예측할 수 있음을 보여준다. 또한 RoPE(회전 위치 임베딩)를 활용해 열 인덱스가 선형 서브스페이스에 매핑된다는 사실을 확인했다. 열 인덱스 벡터에 일정 스케일의 이동 벡터를 더하면 모델이 주목하는 열이 정확히 이동하고, 서로 다른 오프셋 벡터는 가법적으로 결합돼 복합적인 열 이동을 구현한다. 이는 모델이 좌표 정보를 벡터 연산으로 조작 가능한 형태로 압축한다는 강력한 증거다.

후반 레이어 24 이후에서는 목표 셀 토큰에 대한 정보가 이미 완전히 정착돼, 어느 토큰을 교란해도 로짓 차이가 거의 변하지 않는다. 이는 ‘정보 추출(Information Extraction)’ 단계가 완료됐음을 의미한다.

다중 셀 위치 과업(예: “Alice와 Bob의 점수를 모두 알려줘”)에 대해서도 동일한 어텐션 헤드 집합이 병렬로 재사용된다. 즉, 모델은 원자적 셀 위치 메커니즘을 복제·다중화하여 복합 질의를 처리한다. 이는 별도의 복잡한 구조 추론 모듈을 학습시키지 않아도, 기존 메커니즘을 스케일링할 수 있음을 시사한다.

전체적으로 이 논문은 LLM이 2차원 표 구조를 1차원 시퀀스로 변환한 뒤에도, 내부적으로는 명시적인 좌표 체계를 구축하고, 이를 선형 연산으로 조작한다는 메커니즘을 최초로 제시한다. 이러한 발견은 표 기반 질의응답, 데이터베이스 인터페이스, 그리고 구조화된 프롬프트 설계 등에 실용적인 해석 가능성을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기