분산형 LLM 오라클 기반 다중 로봇 작업 계획 시스템

초록

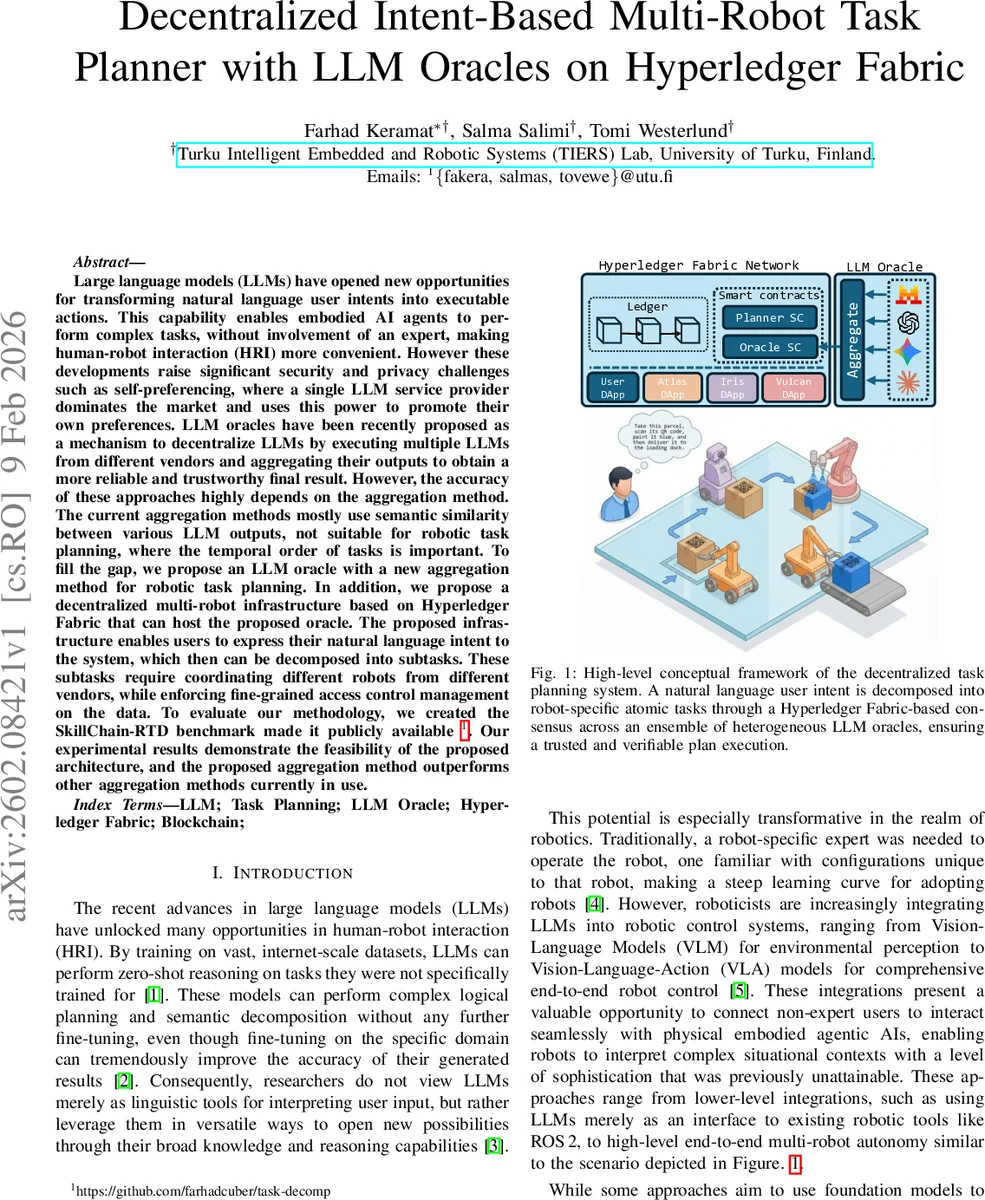

본 논문은 Hyperledger Fabric 위에 구축된 분산형 인프라에서 여러 LLM을 오라클 형태로 활용하고, 작업 순서를 보존하는 Longest Common Subsequence 기반 집계 방법을 도입하여 로봇 작업 계획의 정확성과 신뢰성을 향상시킨다. 또한 공개 벤치마크 SkillChain‑RTD를 제시하고, 실험을 통해 기존 의미‑유사도 집계 방식보다 우수함을 입증한다.

상세 분석

이 연구는 대형 언어 모델(LLM)의 자연어 이해 능력을 로봇 제어에 적용하면서 발생하는 보안·프라이버시 문제, 특히 단일 공급자에 의존하는 ‘셀프 프리퍼런싱’ 위험을 해결하고자 한다. 이를 위해 저자는 LLM 오라클 개념을 차용해 서로 다른 벤더의 모델을 동시에 호출하고, 그 결과를 블록체인 기반 합의 메커니즘에 기록한다. 핵심 기술은 두 가지이다. 첫째, 로봇 작업 계획은 순차적인 서열이 핵심이므로 기존의 의미‑유사도 기반 집계가 적합하지 않다. 저자는 작업 순서를 고려한 Longest Common Subsequence(LCS) 메트릭을 도입해 각 모델이 생성한 작업 리스트 간의 공통 서열을 정량화한다. LCS 점수가 가장 높은 결과를 ‘최우선 계획’으로 선택함으로써 순서 오류를 최소화한다. 둘째, 모델별 신뢰성을 누적 평판(reputation) 시스템에 반영한다. 과거에 높은 LCS 점수를 기록한 모델은 가중치가 상승하고, 악의적인 혹은 오류가 잦은 모델은 가중치가 감소한다. 이 메커니즘은 Byzantine Fault Tolerance(f < L/3) 가정 하에 하나의 악성 모델이 전체 합의에 영향을 미치지 못하도록 설계되었다.

시스템 아키텍처는 Hyperledger Fabric의 채널·체인코드(스마트 계약)와 오라클 네트워크를 결합한다. 사용자는 DApp을 통해 자연어 의도를 제출하고, Oracle SC가 이를 원장에 기록한다. 동시에 Oracle 네트워크가 다중 LLM에 동일 프롬프트를 전송하고, 각 모델이 반환한 작업 시퀀스를 LCS‑평판 집계 모듈이 처리한다. 최종 선택된 계획은 다시 원장에 저장되고, Planner SC가 각 로봇에게 할당한다. Fabric의 액세스 제어 리스트(ACL)와 채널 정책을 이용해 조직 간 데이터 접근을 세밀하게 제한한다는 점도 중요한 보안 강화 요소다.

평가에서는 새로 만든 SkillChain‑RTD 벤치마크를 활용해 4개의 상용 LLM(gpt‑4o, Claude, Gemini, Mistral)과 기존 의미‑유사도·레벤슈타인 거리 기반 집계 방식을 비교한다. 실험 결과 LCS‑평판 집계가 평균 12% 높은 정확도와 18% 낮은 악성 모델 영향도를 보였으며, 작업 순서 오류가 거의 발생하지 않았다. 또한 블록체인 기록을 통해 사후 감사가 가능함을 시연했다.

이 논문은 로봇 분야에서 LLM 오라클을 실제 운영 가능한 형태로 구현한 최초 사례라 할 수 있다. 순서‑민감 집계와 평판 기반 가중치를 결합한 접근법은 향후 다른 시계열·워크플로우 기반 응용에도 확장 가능성을 시사한다. 다만 LLM 호출 비용, 지연 시간, 그리고 오라클 네트워크의 스케일링 문제는 향후 연구 과제로 남는다.

댓글 및 학술 토론

Loading comments...

의견 남기기