스케치와 텍스트가 결합된 티베트 천카 이미지 검색 데이터셋 CIRThan 소개

초록

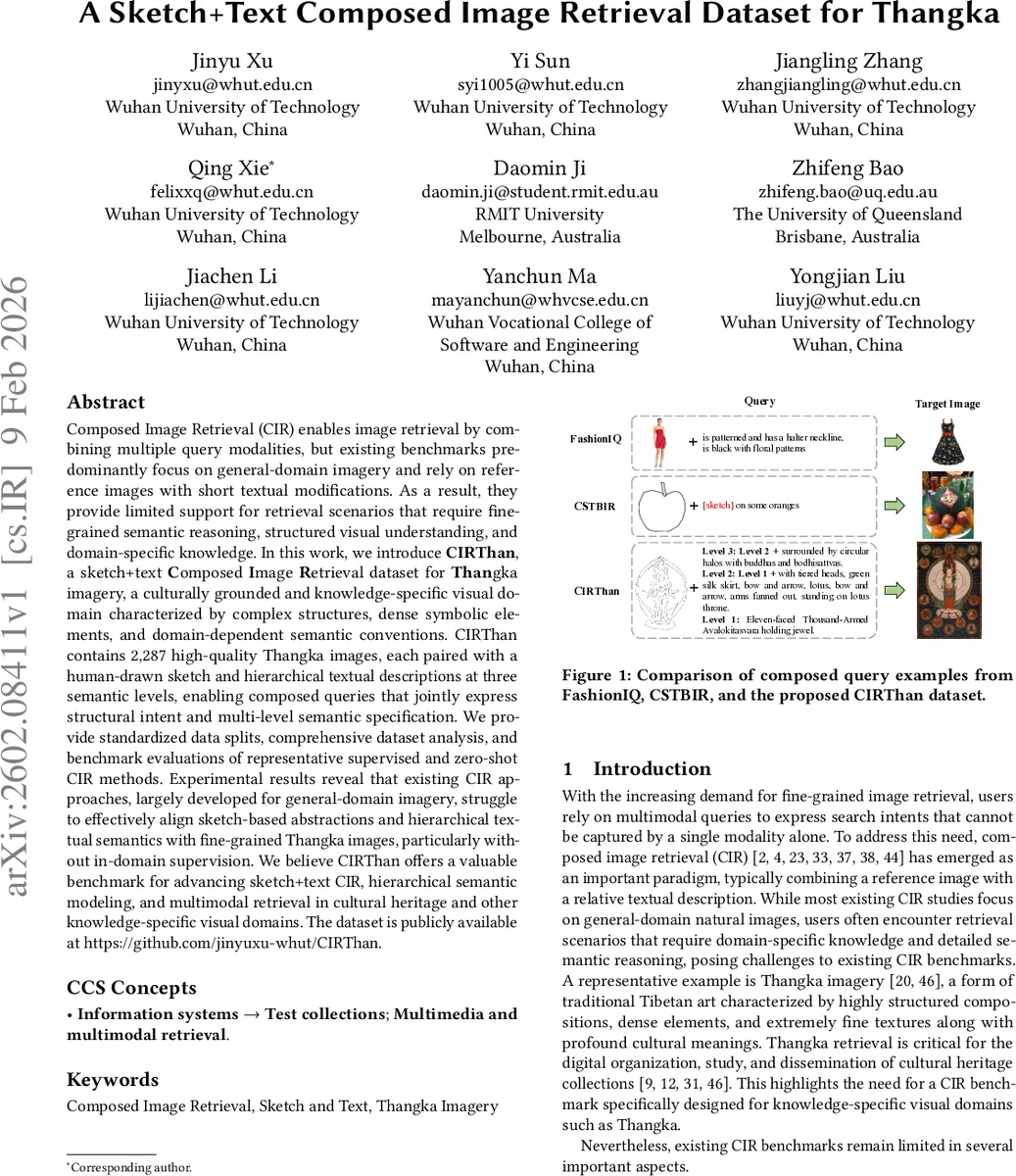

본 논문은 전통 티베트 화풍인 천카(Thangka) 이미지를 대상으로, 인간이 직접 그린 정교한 스케치와 계층적 텍스트 설명을 결합한 새로운 컴포즈드 이미지 검색(CIR) 벤치마크인 CIRThan을 제안한다. 2,287장의 고해상도 천카 이미지와 각각에 대응하는 스케치, 3단계 텍스트(레벨 1~3)를 제공하며, 데이터 구축 파이프라인, 통계 분석, 그리고 기존 감독·제로샷 CIR 모델들의 성능 평가 결과를 제시한다. 실험을 통해 일반 도메인 CIR 모델이 도메인 특화된 세밀한 구조와 의미를 포착하는 데 한계가 있음을 확인하고, 계층적 텍스트와 정교한 스케치가 검색 정확도 향상에 기여함을 보인다.

상세 분석

CIRThan 데이터셋은 기존 CIR 벤치마크가 갖는 두 가지 근본적인 한계를 극복하도록 설계되었다. 첫째, 일반 이미지 컬렉션에서 사용되는 ‘레퍼런스 이미지’는 목표 이미지와 시각적·의미적으로 매우 근접해야 한다는 전제가 있다. 천카와 같이 복합적인 구도와 상징적 요소가 얽힌 문화유산 이미지에서는 적절한 레퍼런스를 찾기가 현실적으로 어렵다. 이를 보완하기 위해 저자들은 인간이 직접 그린 자유형 스케치를 레퍼런스로 채택했으며, 스케치는 형태·구조·주요 윤곽을 강조하면서 불필요한 디테일을 배제한다. 이는 사용자가 시각적 의도를 직관적으로 표현할 수 있게 함과 동시에, 모델이 형태 기반 특징을 학습하도록 유도한다.

둘째, 기존 텍스트 설명은 짧고 속성 중심이며, 도메인 특화 지식이 반영되지 않는다. CIRThan은 텍스트를 세 단계로 계층화하여, 레벨 3은 34단어 평균 길이의 상세 서술, 레벨 2는 부수적 장식과 배경을 제외한 핵심 관계 중심 서술(23단어 평균), 레벨 1은 주요 주제와 가장 두드러진 속성만을 담은 간결 서술(13단어 평균)로 구성한다. 이러한 계층적 설계는 사용자의 전문성 차이를 반영하고, 모델이 다양한 수준의 의미 정보를 활용하도록 만든다.

데이터 구축 과정에서는 라벨 스튜디오를 이용한 인간 주석, Qwen‑3 기반 LLM 보조 텍스트 축소, 그리고 천카 전문 학자들의 검증을 순차적으로 적용해 품질을 확보했다. 통계적으로 이미지 해상도는 평균 1700×1200픽셀이며, 스케치와 텍스트 길이 분포가 균형을 이루어 모델 학습 시 편향을 최소화한다.

성능 평가에서는 대표적인 감독식 CIR 모델(예: CLIP‑based Fusion, TIRG)과 최신 제로샷/멀티모달 LLM 기반 모델을 비교했다. 감독식 모델은 최고 R@1 52.03%를 기록했지만, 제로샷 모델은 8% 이하에 머물렀다. 특히 텍스트 레벨이 높아질수록 모든 모델에서 성능이 상승했으며, 이는 계층적 텍스트가 의미 정합성을 강화한다는 증거다. 또한, 스케치와 텍스트를 동시에 활용하는 경우, 텍스트만 사용했을 때보다 평균 7~10%p의 R@1 향상이 관찰되었다.

이 결과는 두 가지 시사점을 제공한다. 첫째, 도메인 특화 이미지에서는 스케치와 상세 텍스트가 상호 보완적으로 작용해 검색 정확도를 크게 끌어올린다. 둘째, 현재의 대형 멀티모달 모델은 문화·종교적 상징과 같은 전문 지식을 충분히 내재하고 있지 않으며, 이를 보완하기 위한 도메인 적응(pre‑training)이나 파인튜닝이 필요함을 보여준다. 향후 연구는 (1) 스케치와 텍스트 사이의 교차‑어텐션 메커니즘 고도화, (2) 천카와 같은 문화유산 도메인에 특화된 어휘·관계 사전 구축, (3) 제로샷 상황에서도 도메인 지식을 효과적으로 추론할 수 있는 프롬프트 설계 등에 초점을 맞출 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기