언어‑가이드 트랜스포머 토크나이저로 인간 동작을 효율적으로 생성하기

초록

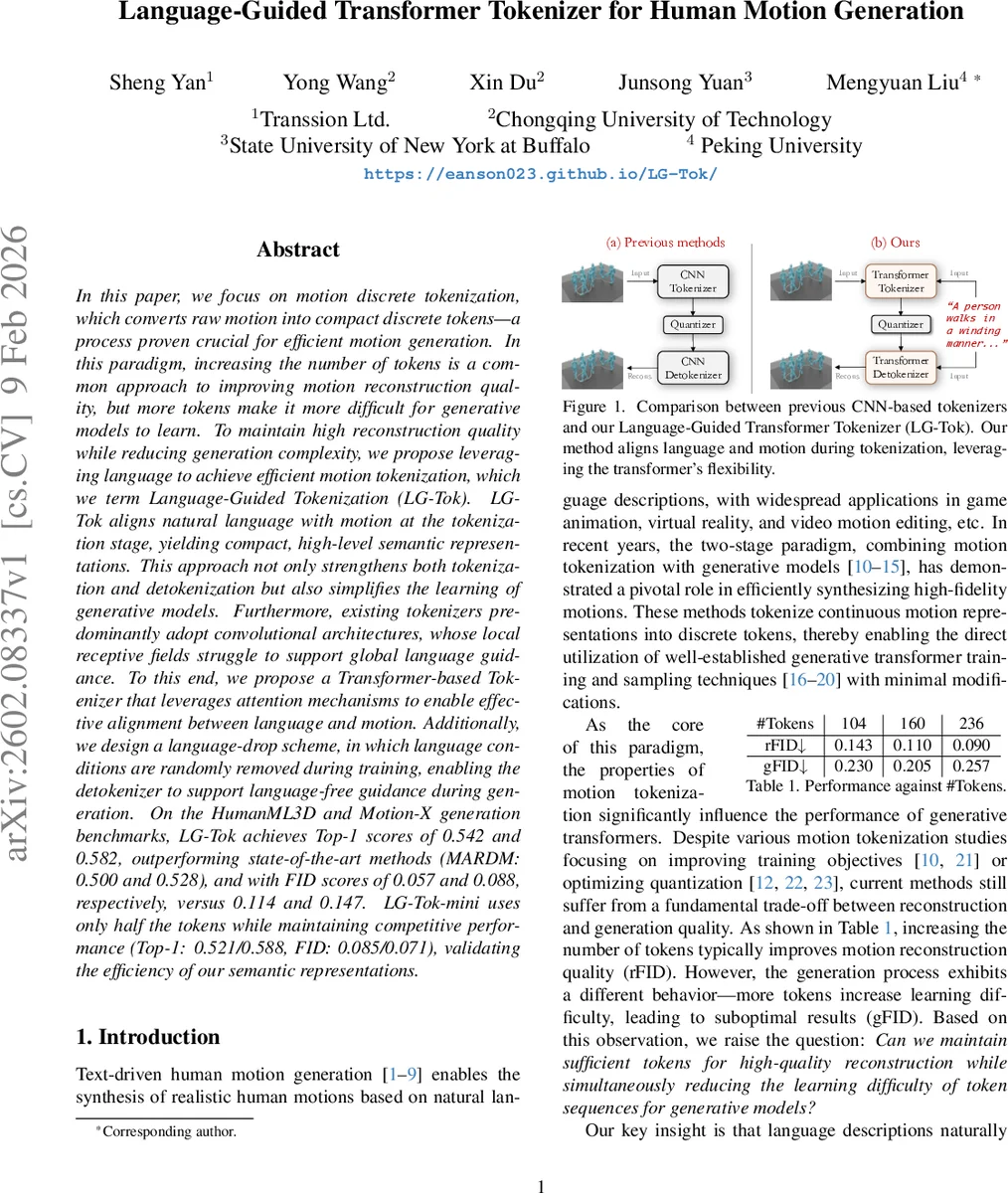

본 논문은 자연어 설명을 토크나이징 단계에 결합한 Language‑Guided Tokenization(LG‑Tok)을 제안한다. 기존 CNN 기반 토크나이저의 지역적 한계를 극복하기 위해 트랜스포머 기반 토크나이저와 cross‑attention 구조를 도입하고, 학습 중 언어 정보를 임의로 제거하는 language‑drop 기법을 적용해 언어‑조건과 언어‑프리 두 가지 생성 방식을 모두 지원한다. HumanML3D와 Motion‑X 벤치마크에서 토큰 수를 절반으로 줄인 LG‑Tok‑mini조차도 Top‑1 0.52/0.59, FID 0.07/0.08 수준의 경쟁력을 보이며, 기존 최첨단 모델(MARDM) 대비 재구성 품질과 생성 품질 모두 크게 향상된다.

상세 분석

LG‑Tok은 “토큰화 단계에서 언어와 동작을 정렬한다”는 핵심 아이디어를 바탕으로, 두 단계(토크나이저‑디토크나이저) 모두에 트랜스포머와 cross‑attention을 적용한다. 기존 연구들은 주로 VQ‑VAE 기반의 CNN 인코더/디코더를 사용해 지역적 receptive field에 의존했으며, 이는 전역적인 언어‑동작 정렬에 한계가 있었다. LG‑Tok은 먼저 고정된 LLaMA 텍스트 인코더로부터 얻은 텍스트 임베딩을 motion 시퀀스와 함께 concatenate하고, 이를 learnable latent token들과 함께 트랜스포머 인코더에 입력한다. self‑attention을 통해 토큰들은 전역 컨텍스트와 텍스트 의미를 동시에 학습하게 되며, 이후 vector quantization을 거쳐 discrete codebook으로 매핑된다. 이때 latent token 자체가 “semantic query” 역할을 수행해, 텍스트 정보가 토큰화 과정에 직접 주입된다.

디토크나이저는 mask token(learnable)와 dequantized embedding을 cross‑attention으로 연결한다. 여기서 mask token은 이미지‑검출의 object query와 유사하게 동작하며, 텍스트 임베딩이 존재하면 텍스트‑조건부 복원을, language‑drop에 의해 텍스트가 제거되면 텍스트‑프리 복원을 수행한다. 이 설계는 학습 시 텍스트 의존성을 완화하면서도, 추론 단계에서 텍스트가 제공될 경우 고품질의 의미‑일치 동작을 생성할 수 있게 한다.

실험에서는 HumanML3D와 Motion‑X 두 데이터셋에 MoSa(Scale‑by‑Scale Autoregressive)와 MoMask를 각각 generative backbone으로 사용했다. 토큰 수를 104, 160, 236으로 늘리면 재구성 오류(rFID)는 감소하지만, 생성 오류(gFID)는 오히려 증가한다는 기존 트레이드‑오프를 확인했다. LG‑Tok은 토큰 수를 104~160 수준으로 유지하면서도 rFID를 0.057, gFID를 0.088 수준으로 크게 낮추었다. 특히 LG‑Tok‑mini는 토큰 수를 절반(≈80)으로 줄였음에도 Top‑1 0.521/0.588, FID 0.085/0.071을 기록, 토큰당 의미 함량이 크게 향상됐음을 입증한다.

또한, language‑drop 실험에서 0~30% 비율로 텍스트를 무작위 제거했을 때, 디토크나이저의 텍스트‑프리 복원 성능이 크게 저하되지 않으며, 이는 모델이 텍스트 없이도 충분히 동작을 재구성할 수 있음을 보여준다. 이는 실제 서비스에서 텍스트 입력이 없을 경우에도 안정적인 동작 생성이 가능함을 의미한다.

한계점으로는 현재 LLaMA를 frozen 상태로 사용해 텍스트 인코더를 고정했으며, 텍스트와 동작 사이의 정교한 정렬을 위해 추가적인 multimodal pre‑training이 필요할 수 있다. 또한, 토큰 수를 크게 줄였을 때(예: 40 tokens 이하) 성능이 급격히 떨어지는 현상이 관찰돼, 초경량 모델에 대한 추가 연구가 요구된다.

전반적으로 LG‑Tok은 “언어‑가이드 토큰화”라는 새로운 패러다임을 제시함으로써, 토큰 수와 생성 난이도 사이의 트레이드‑오프를 완화하고, 텍스트와 동작을 동시에 고려한 전역적인 표현 학습을 가능하게 한다. 이는 향후 인간 동작 생성, 애니메이션 자동화, VR/AR 인터랙션 등 다양한 응용 분야에 중요한 기반 기술이 될 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기