오디오‑비주얼 학습을 위한 교차모달 상호 강화 프레임워크

초록

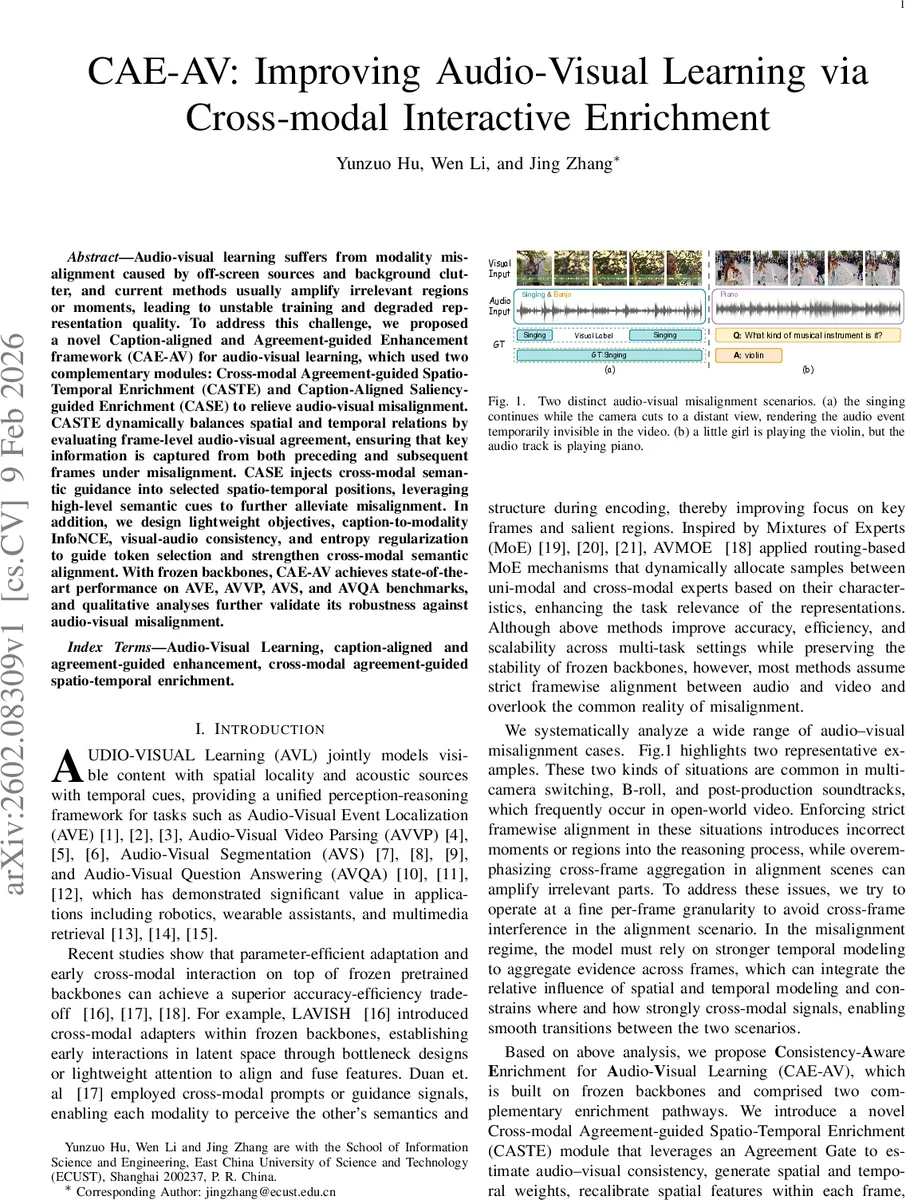

본 논문은 오디오와 비주얼 간의 시간·공간 불일치를 완화하기 위해 두 가지 경량 모듈인 CASTE와 CASE를 도입한 CAE‑AV 프레임워크를 제안한다. CASTE는 프레임별 오디오‑비주얼 일치도를 기반으로 공간·시간 강조 비율을 동적으로 조절하고, CASE는 대규모 언어‑비전 모델이 생성한 캡션을 활용해 의미적 가이드를 삽입한다. 냉동된 백본 위에 경량 손실(캡션‑InfoNCE, 시각‑청각 일관성, 엔트로피 정규화)을 추가해 학습을 안정화하고, AVE, AVVP, AVS, AVQA 등 네 가지 벤치마크에서 최첨단 성능을 달성한다.

상세 분석

CAE‑AV는 기존의 파라미터 효율적인 오디오‑비주얼 적응 방식(LAVISH, AVMoE 등)이 전제하는 프레임‑단위 정렬 가정을 깨고, 실제 영상에서 흔히 발생하는 오프‑스크린 사운드·배경 잡음 등으로 인한 모달리티 불일치를 직접 다룬다. 핵심은 두 단계의 상호 보완적 강화 모듈에 있다. 첫 번째 모듈인 CASTE는 (1) 프레임별 평균 토큰을 통해 시각·청각 프로토타입을 만든 뒤, 공유 의미 공간으로 투영해 코사인 유사도 g를 계산한다. (2) ˜v, ˜a, ˜v‑˜a, ˜v⊙˜a 로 구성된 4‑차원 피처 ξ를 MLP에 통과시켜 공간·시간 가중치 λ를 얻고, 여기서 g와 −g를 바이어스로 더해 softmax로 정규화한다. 이렇게 얻은 w_sp와 w_tm은 각각 공간 재조정과 시간 컨볼루션에 가중치를 부여해, 일치도가 높은 프레임은 공간 정보를, 낮은 프레임은 시간 흐름을 강조한다. 공간 강화는 MobileViT‑스타일의 깊이‑분리 어텐션을 사용해 토큰‑레벨 입력 I와 키 K를 가중합해 전역 컨텍스트 C를 만든 뒤, V에 곱해 노이즈를 억제한다. 시간 강화는 깊이‑분리 1D Conv(k=3)와 포인트와이즈 1D Conv를 결합해 짧은 시계열 패턴을 부드럽게 통합한다. 두 강화 결과는 w_sp·v_sp + w_tm·v_tm 형태로 결합되고, 토큰 에너지 기반 Top‑K 마스크 M을 적용해 가장 중요한 토큰에만 가중치를 부여한다. 두 번째 모듈인 CASE는 사전 학습된 CLIP과 대형 멀티모달 LLM이 생성한 캡션을 인코딩해 텍스트 토큰을 시각·청각 토큰에 어텐션 방식으로 정렬한다. 캡션은 의미적 앵커 역할을 하여, 특히 오디오와 비주얼이 시간적으로 어긋난 상황에서 의미적 일관성을 복원한다. 학습 목표는 (1) 캡션‑모달 InfoNCE 손실로 텍스트와 각 모달 간의 대조 학습을 수행하고, (2) 시각‑청각 일관성 손실로 강화된 토큰 간의 코사인 유사도를 최대화하며, (3) 엔트로피 정규화로 선택 마스크가 과도하게 편향되지 않도록 한다. 전체 파이프라인은 Swin‑Transformer와 HTS‑AT 백본을 냉동 상태로 유지하면서, 각 레이어 앞에 CASTE, 뒤에 CASE를 삽입해 경량 어댑터 형태로 동작한다. 실험 결과, AVE(오디오‑비주얼 이벤트 로컬라이제이션), AVVP(비디오 파싱), AVS(세그멘테이션), AVQA(질문응답) 모두 기존 최첨단 모델을 능가했으며, 특히 오프‑스크린 사운드나 배경 잡음이 많은 시나리오에서 강인성을 보였다.

댓글 및 학술 토론

Loading comments...

의견 남기기