약한 모델이 강한 모델을 더 강하게 만드는 방법

초록

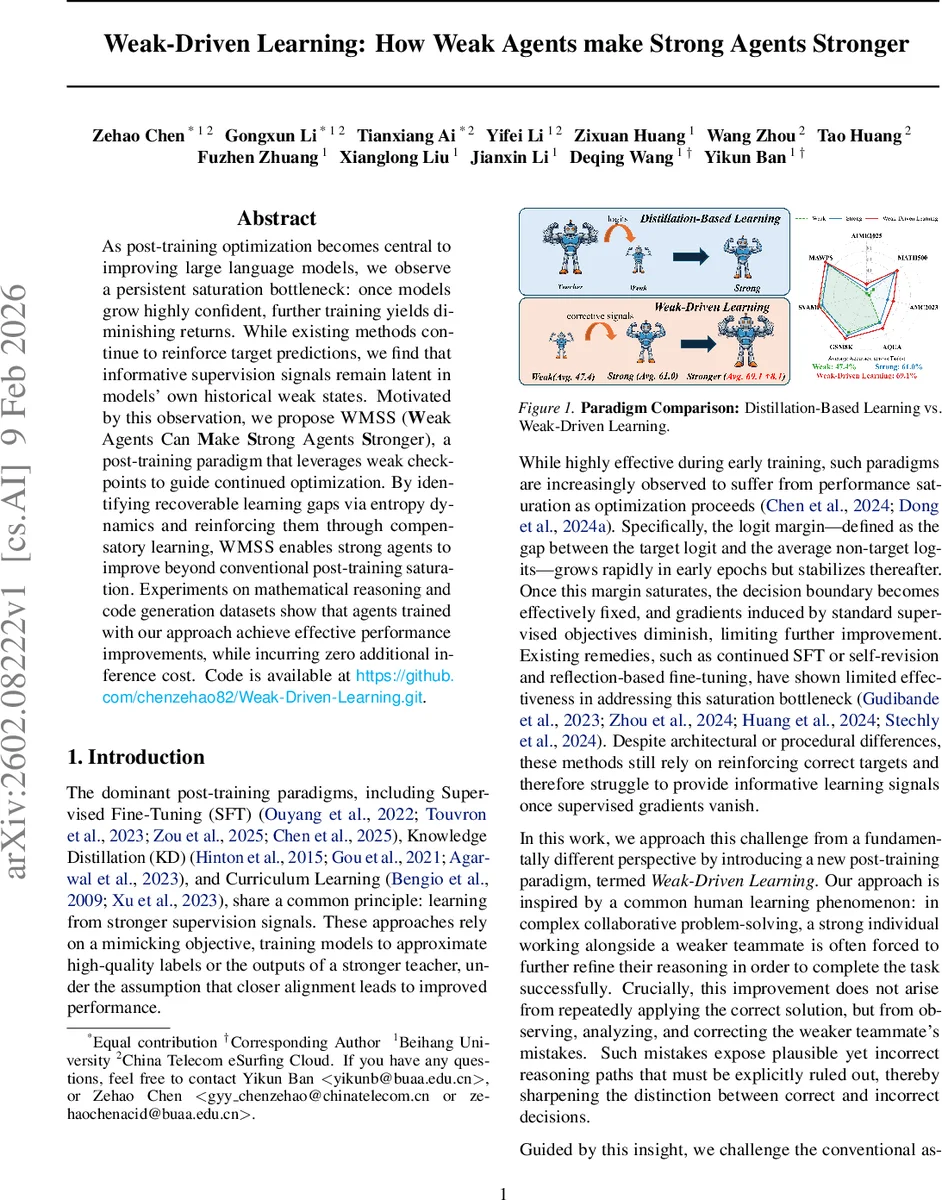

본 논문은 대형 언어 모델의 사후 학습에서 발생하는 성능 포화 문제를 해결하기 위해, 과거 체크포인트와 같은 약한 에이전트를 활용하는 새로운 학습 패러다임인 Weak‑Driven Learning을 제안한다. 약한 모델의 로그잇을 강한 모델과 선형 혼합하여 학습 신호를 재구성함으로써, 기존 SFT나 지식 증류에서 사라지는 비목표 토큰에 대한 그래디언트를 회복하고, 추가 추론 비용 없이 성능을 향상시킨다.

상세 분석

Weak‑Driven Learning은 기존 사후 학습 방법이 “강한 교사 → 약한 학생”의 일방향 모방에 의존하는 점을 근본적으로 뒤집는다. 저자는 모델이 학습 초기에 높은 불확실성을 보이다가 점차 확신을 갖게 되면 로그잇 마진이 포화되고, 비목표 토큰에 대한 그래디언트가 거의 0에 수렴한다는 현상을 관찰한다. 이를 해결하기 위해 과거 체크포인트(약한 모델)의 로그잇을 현재 강한 모델의 로그잇과 λ 비율로 혼합한다. 약한 모델은 여전히 높은 엔트로피를 유지하므로, 잘못된 토큰에 일정 확률 질량을 할당한다. 혼합된 로그잇에 대해 교차 엔트로피 손실을 최소화하면, 비목표 토큰에 대한 그래디언트가 Pweak(k) 만큼 재활성화되어 학습이 지속된다. 또한, 엔트로피 변화 ΔH를 이용한 커리큘럼 샘플링은 약한 모델이 어려워했던 샘플과 강한 모델이 회귀한 샘플을 우선적으로 재학습하게 함으로써, 학습 효율을 극대화한다. 이론적으로는 혼합 로그잇의 그래디언트 gmix = Pmix – ey 로 표현되며, λ이 0에 가까울수록 약한 모델의 영향이 커져 그래디언트가 크게 증폭된다. 실험에서는 수학 추론과 코드 생성 벤치마크에서 기존 SFT 대비 1~2%p의 절대 성능 향상을 기록했으며, 추론 시 추가 연산이 전혀 발생하지 않는다. 따라서 약한 체크포인트를 재활용하는 비용 효율적인 접근법으로, 대규모 모델의 포화 현상을 타파할 실용적인 해결책을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기