컨텍스트 인식 로그잇 대비를 통한 숨은 상태 교정, CoRect으로 지식 충돌 해소

초록

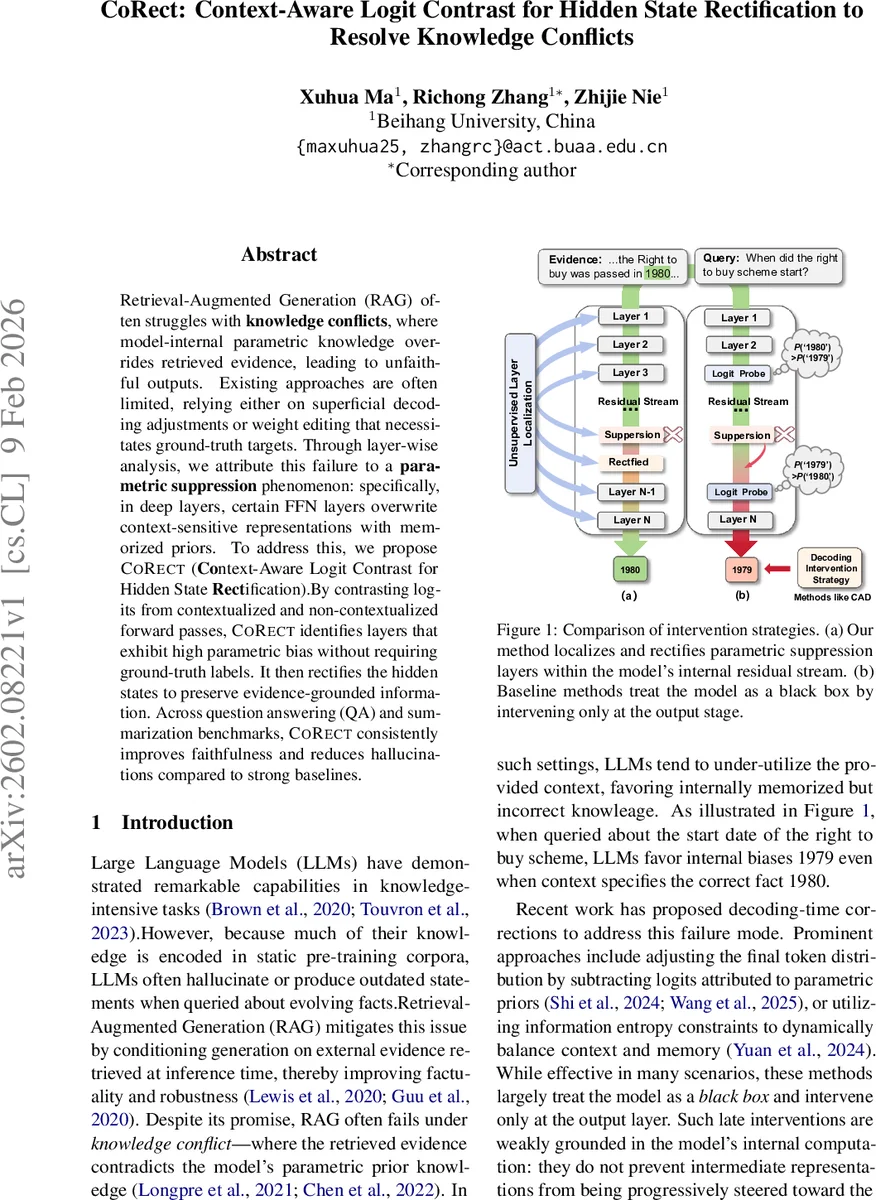

CoRect은 RAG 모델에서 외부 증거와 내부 파라메트릭 지식이 충돌할 때, 깊은 레이어의 FFN이 증거를 억제하는 현상을 탐지하고, 로그잇 대비를 이용해 문제 레이어를 자동으로 찾아 숨은 상태를 교정함으로써 사실성 및 환각 감소를 달성한다.

상세 분석

본 논문은 Retrieval‑Augmented Generation(RAG) 시스템이 “지식 충돌” 상황에서 내부 파라메트릭 지식이 외부 검색 증거를 압도해 비신뢰성 출력을 생성한다는 문제를 메커니즘 수준에서 규명한다. 저자들은 Logit Lens 기법을 활용해 각 Transformer 레이어의 잔차 스트림을 vocabularly 공간으로 투사하고, 레이어별 로그잇 변화를 추적한다. 이 과정에서 중간 레이어에서는 정답 토큰이 높은 확률을 보이다가, 뒤쪽 레이어, 특히 깊은 Feed‑Forward Network(FFN)에서 급격히 순위가 떨어지는 “Parametric Suppression” 현상을 발견한다. 이는 FFN이 키‑밸류 형태의 메모리 역할을 수행하며, 사전 학습된 사실을 강제로 재삽입해 컨텍스트 정보를 억제한다는 가설을 뒷받침한다. 기존의 가중치 편집(ROME, MEMIT 등)은 목표 토큰을 사전에 알아야만 가능한데, 이는 오픈‑도메인 RAG 시나리오에 부적합하다. CoRect은 두 단계의 무지도식 접근법을 제안한다. 첫 번째 단계에서는 동일 입력에 대해 “전체 컨텍스트”와 “null 컨텍스트”(증거 없이 순수 프롬프트) 두 번을 전방향으로 실행해 레이어별 로그잇 차이를 계산한다. 이 차이는 컨텍스트가 특정 토큰에 미치는 정보 이득을 정량화하며, 마지막 k 레이어에 평균을 취해 전체 정보 점수 S_total(v)를 산출한다. 상위 M개의 후보 토큰을 선정한 뒤, 모델의 어텐션 맵을 이용해 해당 토큰이 실제 입력 증거와 얼마나 매칭되는지를 검증한다. 이렇게 얻어진 신뢰 토큰 ˜t는 목표 토큰을 추정하는 역할을 한다. 두 번째 단계에서는 해당 레이어에서 FFN 출력 u_l을 수정한다. 구체적으로, 로그잇 대비를 통해 얻은 억제 성분을 역전시켜 u_l에 작은 교정 벡터 δ_l을 더한다. δ_l은 w_{˜t}와 반대 방향으로 투영된 형태이며, 이는 기존 편집이 목표 토큰에 정렬된 것과 달리 “비억제”를 목표로 한다. 결과적으로, 파라메트릭 억제가 차단돼 증거‑기반 표현이 잔차 스트림에 그대로 전달된다. 실험에서는 Natural Questions, TriviaQA 등 QA 벤치마크와 CNN/DailyMail 요약 데이터에서 CoRect이 기존 CAD, AdaCAD, ITI 등과 비교해 사실성 점수(F1, EM)와 hallucination 감소율에서 일관된 개선을 보였다. 특히, 70% 이상의 레이어를 정확히 로컬라이즈하고, 편집 없는 상태에서도 56% 이상의 오류 케이스에서 정답 토큰이 중간 레이어에 존재함을 확인함으로써 방법론의 타당성을 입증한다. 전체적으로 CoRect은 “출력‑레벨” 교정이 아닌 “내부‑레벨” 교정이라는 새로운 패러다임을 제시하며, 라벨‑프리 상황에서도 효과적인 지식 충돌 완화 메커니즘을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기