멀티모달 LLM을 위한 훈련‑프리 체인‑오브‑캡션: 지시표현 이해 성능 30% 향상

초록

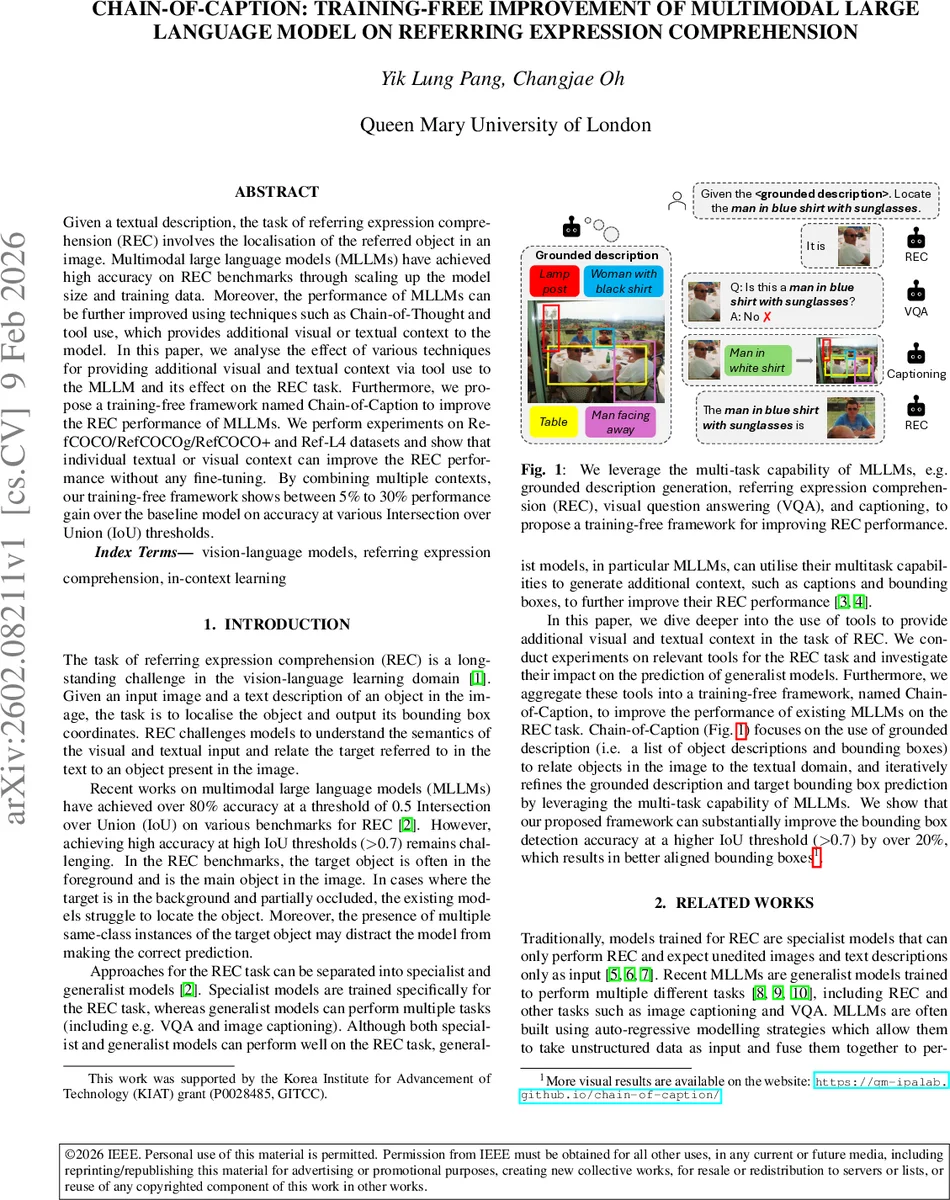

본 논문은 멀티모달 대형 언어 모델(MLLM)이 지시표현 이해(REC) 작업에서 추가적인 텍스트·시각 컨텍스트를 활용하도록 설계된 훈련‑프리 프레임워크 “Chain‑of‑Caption”을 제안한다. grounded description(객체 설명+바운딩 박스)과 이미지 크롭·VQA 검증을 순차적으로 적용해 예측을 반복 수정함으로써 RefCOCO·RefCOCO+·RefCOCOg·Ref‑L4 데이터셋에서 IoU 0.5‑0.9 구간에서 5%‑30%의 정확도 향상을 달성한다.

상세 분석

이 연구는 REC(Referring Expression Comprehension)라는 시각‑언어 융합 과제에 초점을 맞춘다. 기존 MLLM은 대규모 사전학습과 파인튜닝을 통해 0.5 IoU 기준에서는 80% 이상의 정확도를 기록했지만, 0.7·0.9와 같은 높은 IoU에서는 여전히 성능이 저조했다. 논문은 이러한 한계를 “컨텍스트 제공”이라는 두 축으로 접근한다. 첫 번째는 텍스트 컨텍스트인 grounded description이다. 모델에게 이미지 내 객체를 일정 수만큼 탐지하도록 프롬프트하고, 각 객체에 대한 설명과 정규화된 바운딩 박스를 반환하게 한다. 이는 모델이 텍스트와 시각 정보를 직접 매핑하도록 돕는다. 두 번째는 시각 컨텍스트이다. 초기 REC 예측을 바탕으로 해당 영역을 1.5배 확대해 크롭하고, 혹은 grounded description에서 얻은 바운딩 박스를 이미지에 그려서 시각적 힌트를 제공한다.

Chain‑of‑Caption은 위 두 컨텍스트를 순환적으로 결합한다. ① grounded description을 생성하고, ② 이를 포함한 프롬프트로 초기 바운딩 박스를 예측한다. ③ 예측 영역을 VQA 모듈에 입력해 “해당 영역이 설명과 일치하는가?”를 yes/no로 묻는다. ④ 불일치 시, 해당 영역을 캡션하고 그 캡션을 grounded description에 추가한다. ⑤ 업데이트된 컨텍스트로 다시 REC를 수행한다. 이 과정을 최대 시도 횟수까지 반복하거나 yes가 나오면 종료한다.

실험 결과는 두 가지 관점에서 의미 있다. 첫째, 개별 컨텍스트의 효과를 정량화했다. grounded description만 사용해도 IoU 0.7·0.9에서 20%‑30% 포인트 상승했으며, 크롭은 0.9 IoU에서 특히 큰 이득을 보였다. 둘째, 체인 방식으로 결합했을 때는 모든 데이터셋에서 5%‑30%의 추가 향상이 관찰되었다. 특히 NVILA‑8B 모델은 Chain‑of‑Caption 적용 후 Qwen2.5‑7B와 경쟁 수준의 성능을 달성했다. 모델 크기를 늘린 NVILA‑15B에서도 동일한 트렌드가 유지돼, 프레임워크가 모델 규모에 독립적임을 시사한다.

훈련‑프리 접근법의 장점은 추가 파인튜닝 비용이 전혀 들지 않으며, 기존 MLLM의 멀티태스크 능력을 그대로 활용한다는 점이다. 그러나 몇 가지 한계도 존재한다. 첫째, 캡션·바운딩 박스 생성 품질에 크게 의존한다; 오류가 누적되면 반복 과정이 오히려 성능을 저하시킬 수 있다. 둘째, 반복적인 크롭·VQA·캡션 단계는 추론 시간을 늘려 실시간 응용에는 부적합할 수 있다. 셋째, 현재는 REC에 특화된 프롬프트 설계와 최대 시도 횟수 같은 하이퍼파라미터가 경험적으로 설정돼, 다른 도메인이나 데이터셋에 바로 적용하기엔 추가 조정이 필요하다.

향후 연구 방향으로는 (1) 자동화된 프롬프트 최적화, (2) 더 정교한 시각 툴(예: 세그멘테이션 마스크)과의 연계, (3) 체인‑오브‑캡션을 VQA·이미지 캡셔닝·객체 검출 등 다중 작업에 동시에 적용해 멀티태스크 성능을 공동으로 향상시키는 방안이 제시될 수 있다. 또한, 훈련‑프리 컨텍스트 제공 방식이 다른 멀티모달 과제(예: 이미지 기반 질문 응답, 시각적 스토리텔링)에도 일반화될 가능성이 높다.

댓글 및 학술 토론

Loading comments...

의견 남기기