ZipFlow: GPU 데이터 전송을 위한 압축 최적화 컴파일러 프레임워크

초록

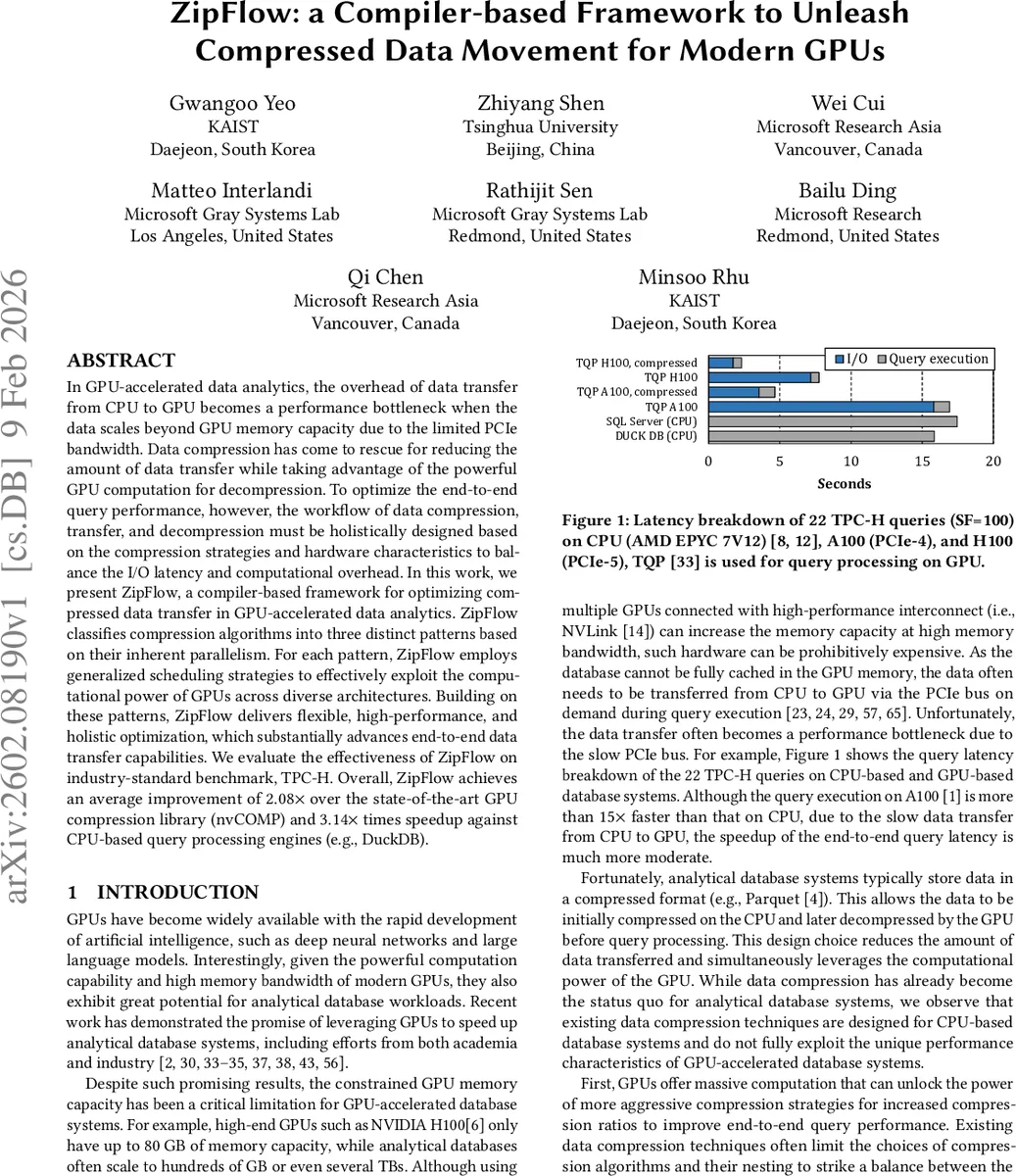

ZipFlow는 압축·전송·복원 과정을 통합적으로 최적화하는 컴파일러 기반 프레임워크이다. 압축 알고리즘을 “완전 병렬”, “그룹 병렬”, “비병렬” 세 가지 패턴으로 분류하고, 각 패턴에 맞는 스케줄링·커널 융합 기법을 적용해 PCIe 전송과 GPU 복원을 겹쳐 수행한다. TPC‑H 벤치마크에서 기존 GPU 압축 라이브러리(nvCOMP) 대비 평균 2.08배, CPU 기반 엔진(DuckDB) 대비 3.14배 빠른 엔드‑투‑엔드 성능을 달성한다.

상세 분석

본 논문은 현대 GPU‑가속 데이터 분석 워크로드에서 가장 큰 병목인 CPU‑GPU 간 PCIe 전송을 압축을 통해 완화하고, 압축·전송·복원 전체 파이프라인을 하나의 컴파일러 프레임워크로 통합한다는 점에서 혁신적이다. 핵심 아이디어는 압축·복원 알고리즘을 세 가지 기본 병렬 패턴으로 추상화하는 것이다.

-

완전 병렬(Fully‑Parallel) 패턴은 입력 원소와 출력 원소 사이에 종속성이 없으며, 사전 조회, 비트‑패킹, Float2Int 등 1:1 매핑이 가능한 연산에 적합하다. 이 패턴은 GPU의 SIMT 구조를 그대로 활용해 각 스레드가 독립적으로 작업하도록 설계된다.

-

그룹 병렬(Group‑Parallel) 패턴은 데이터가 가변 길이 그룹으로 나뉘어 각 그룹 내에서만 종속성이 존재하는 경우에 사용된다. 예를 들어 RLE이나 LZ77‑계열에서 연속된 시퀀스 길이를 먼저 계산하고, 그 결과를 기반으로 실제 복원을 수행한다. 그룹 경계 탐색과 길이 누적을 효율적으로 구현하기 위해 블록‑레벨 프리패치와 워프‑레벨 협업을 결합한다.

-

비병렬(Non‑Parallel) 패턴은 순차적 의존성이 강한 연산, 즉 압축 트리 탐색이나 히스토그램 기반 엔트로피 코딩(ANS, Huffman)에서 주로 나타난다. 여기서는 GPU의 대규모 병렬성을 활용하기보다는 파이프라인 단계별로 커널을 분할하고, CPU‑GPU 간 데이터 이동을 최소화하는 전략을 채택한다.

각 패턴에 대해 논문은 디바이스 지오메트리 스케줄링을 정의한다. 스레드 블록 크기, 워프 수, 공유 메모리 사용량 등을 자동으로 탐색해 최적의 실행 구성을 도출한다. 특히, **커널 융합(Fusion)**과 파이프라인 스케줄링을 통해 압축된 청크 전송과 복원 커널을 겹쳐 실행함으로써 PCIe 전송 지연을 거의 숨긴다.

프레임워크는 네 계층으로 구성된다.

- Pattern Layer는 위 세 패턴을 구현한 기본 GPU 연산자를 제공한다.

- Algorithm Layer는 이러한 연산자를 조합해 RLE, 딕셔너리 인코딩, 비트‑패킹, ANS 등 개별 압축 알고리즘을 만든다.

- Nesting Layer는 데이터 컬럼별 특성에 맞춰 알고리즘을 중첩(Nested Compression)시키며, 자동 탐색을 통해 최적의 압축 체인을 생성한다.

- Pipelining Layer는 여러 데이터 청크에 대해 I/O와 복원 작업을 동시에 스케줄링해 전체 지연을 최소화한다.

실험에서는 TPC‑H SF=100 워크로드 22개 쿼리를 대상으로 A100(Pcie‑4)와 H100(Pcie‑5) GPU에서 평가했다. ZipFlow는 동일 알고리즘을 nvCOMP에 적용했을 때보다 평균 2.08배 빠른 엔드‑투‑엔드 지연을 보였으며, 압축 비율이 1.85배 향상돼 I/O 대기 시간을 크게 감소시켰다. 또한, 복원 단계에서 3.26배의 속도 향상을 달성했다. 다양한 데이터 분포와 GPU 아키텍처(NVIDIA, AMD)에서도 일관된 성능 이점을 확인했다.

한계점으로는 현재 압축 알고리즘이 주로 정수·컬럼형 데이터에 초점을 맞추고 있어, 이미지·비정형 데이터에 대한 적용 가능성이 미흡하다. 또한, PCIe‑Gen5 환경에서도 전송 대역폭이 여전히 제한 요소이므로, NVLink·Infinity Fabric 등 고속 인터커넥트와의 연계 최적화가 필요하다. 향후 연구에서는 자동 압축‑복원 파이프라인 탐색을 머신러닝 기반 메타모델로 확장하고, 멀티‑GPU 클러스터 환경에서의 스케일링을 검증할 계획이다.

댓글 및 학술 토론

Loading comments...

의견 남기기