DINO 기반 통합 브릿지로 실감 나는 자율주행 시뮬‑실제 영상 변환

초록

본 논문은 시뮬레이션 영상과 실제 도로 영상을 연결하기 위해 Vision Foundation Model인 DINOv3의 특징을 활용한다. PCA 기반의 주요 성분 제거와 랜덤 채널 테일 드롭으로 텍스처 베이킹을 억제하고, 고해상도 입력을 위한 Spatial Alignment Module과 Causal Temporal Aggregator를 도입해 구조적 일관성과 사진실감성을 동시에 달성한다. 제안된 DwD 프레임워크는 기존 멀티‑컨트롤 방식보다 메모리·학습 효율이 높으며, 다양한 날씨·환경에서 최첨단 성능을 보인다.

상세 분석

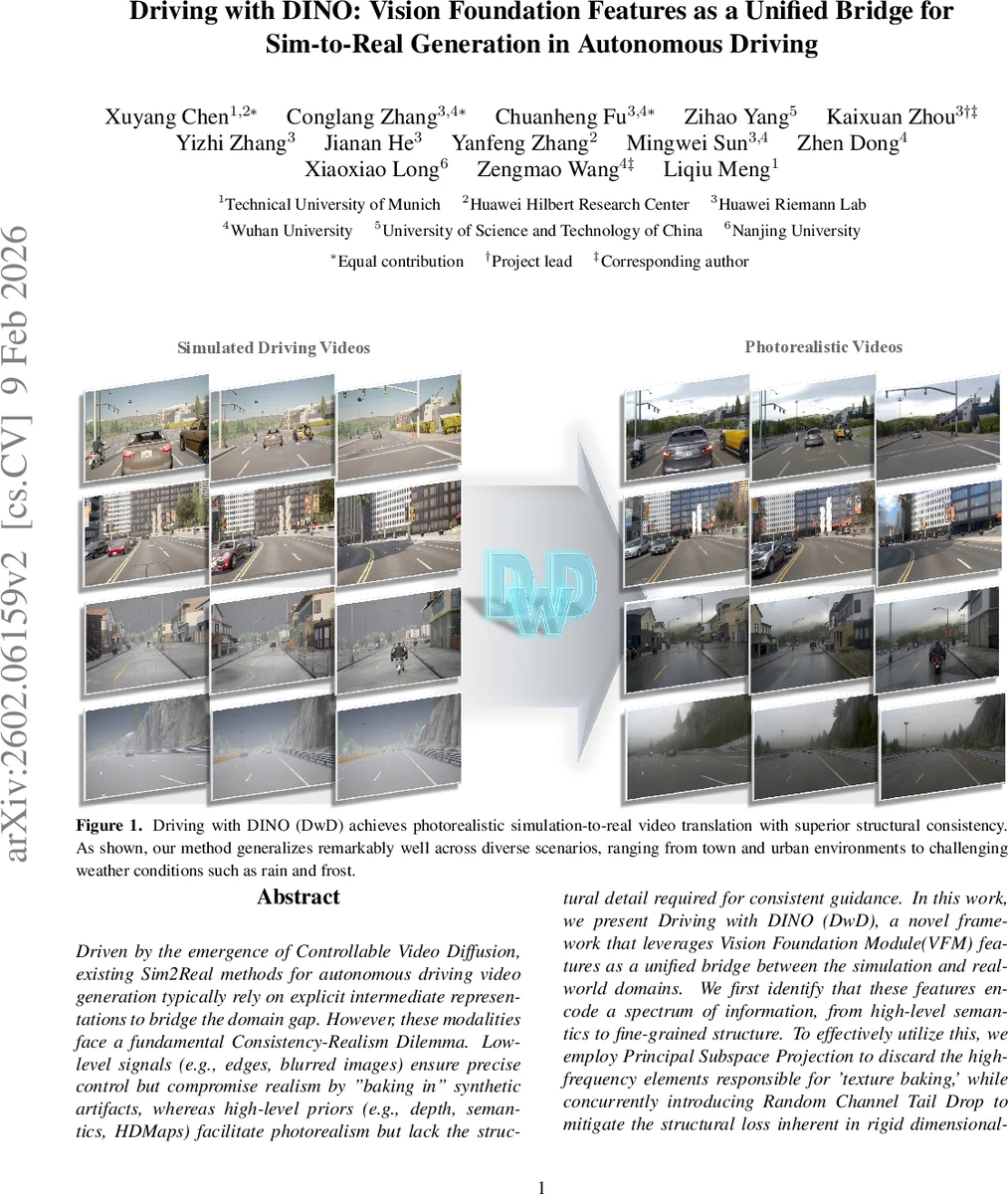

Driving with DINO(DwD)는 자율주행 시뮬레이션에서 생성된 저품질 영상과 실제 도로 영상 사이의 도메인 격차를 해소하기 위해 Vision Foundation Model(VFM)인 DINOv3의 특징을 “통합 브릿지”로 활용한다는 점에서 혁신적이다. 기존 Sim2Real 방법은 엣지, 블러, 깊이, HDMap 등 서로 다른 중간 표현을 별도로 사용해 구조적 일관성(Consistency)과 사진실감성(Realism) 사이의 트레이드오프, 즉 Consistency‑Realism Dilemma에 빠졌다. DwD는 DINOv3가 저수준 텍스처부터 고수준 의미까지 연속적인 스펙트럼을 하나의 잠재공간에 내재하고 있음을 발견하고, 이를 단일 컨트롤 신호로 전환한다.

핵심 기술은 세 가지이다. 첫째, Principal Subspace Projection을 통해 고주파 텍스처 성분을 억제한다. PCA를 적용해 고차원 DINO 특징을 k 차원 하위공간으로 투영함으로써 외관에 특화된 저변동 성분을 제거하고, 구조적 정보를 보존한다. 둘째, Random Channel Tail Drop은 고정된 차원 축소가 초래할 수 있는 구조 손실을 완화한다. 학습 시마다 활성 채널 수 k를 무작위로 샘플링해 모델이 다양한 수준의 세부 정보를 학습하도록 강제함으로써, 텍스처 누수와 구조 손실 사이의 균형을 동적으로 맞춘다. 셋째, Spatial Alignment Module과 Causal Temporal Aggregator이다. DINOv3는 일반적으로 1/16 해상도로 다운샘플링된 피처를 출력하므로, 입력 영상을 고해상도로 스케일 업한 뒤 DINOv3에 입력해 고해상도 피처를 얻는다. 이때 발생하는 차원 불일치를 해결하기 위해 스트라이드 컨볼루션 기반의 학습 가능한 정렬 모듈을 삽입해 Diffusion 백본(DiT)과 매끄럽게 연결한다. 시간 축에서는 프레임별 독립 처리로 인한 중복성을 감소시키고, 인과적( causal ) 컨볼루션을 이용해 과거 프레임 정보를 누적·전파함으로써 모션 블러와 플리커 현상을 최소화한다.

DwD는 이러한 전처리·조건화 모듈을 기존의 Controllable Video Diffusion 아키텍처(Cosmos‑Predict2.5)와 결합한다. ControlNet 스타일의 컨트롤 브랜치를 유지하면서도, DINOv3 피처를 단일 조건으로 주입함으로써 멀티‑컨트롤 네트워크에서 발생하던 메모리 폭증·그라디언트 충돌 문제를 회피한다. 실험 결과, CARLA 기반 시뮬레이션 영상에 대해 다양한 도시·교외·악천후 시나리오에서 기존 최첨단 방법들을 크게 앞서는 PSNR, SSIM, LPIPS 및 인간 평가 점수를 기록했다. 특히, 도로 라인·표지판·차량 경계와 같은 미세 구조가 정확히 보존되면서도, 빗물·안개·야간 조명 등 복잡한 환경에서도 사실적인 질감을 생성한다는 점이 주목할 만하다.

이 논문은 VFM을 Sim2Real의 “통합 중간 표현”으로 활용한다는 새로운 패러다임을 제시한다. 텍스처 베이킹을 억제하면서도 고해상도 구조 정보를 유지하는 방법론은 향후 다른 도메인(예: 로봇 매니퓰레이션, 의료 영상)에서도 확장 가능성이 크다. 또한, PCA‑ 기반 차원 축소와 랜덤 채널 드롭이라는 비교적 간단한 기법이 복잡한 멀티‑모달 컨트롤 시스템을 대체할 수 있음을 실증적으로 보여준다.

댓글 및 학술 토론

Loading comments...

의견 남기기