중복 매니퓰레이터 경로 추적을 위한 학습 기반 초기 궤적 생성

초록

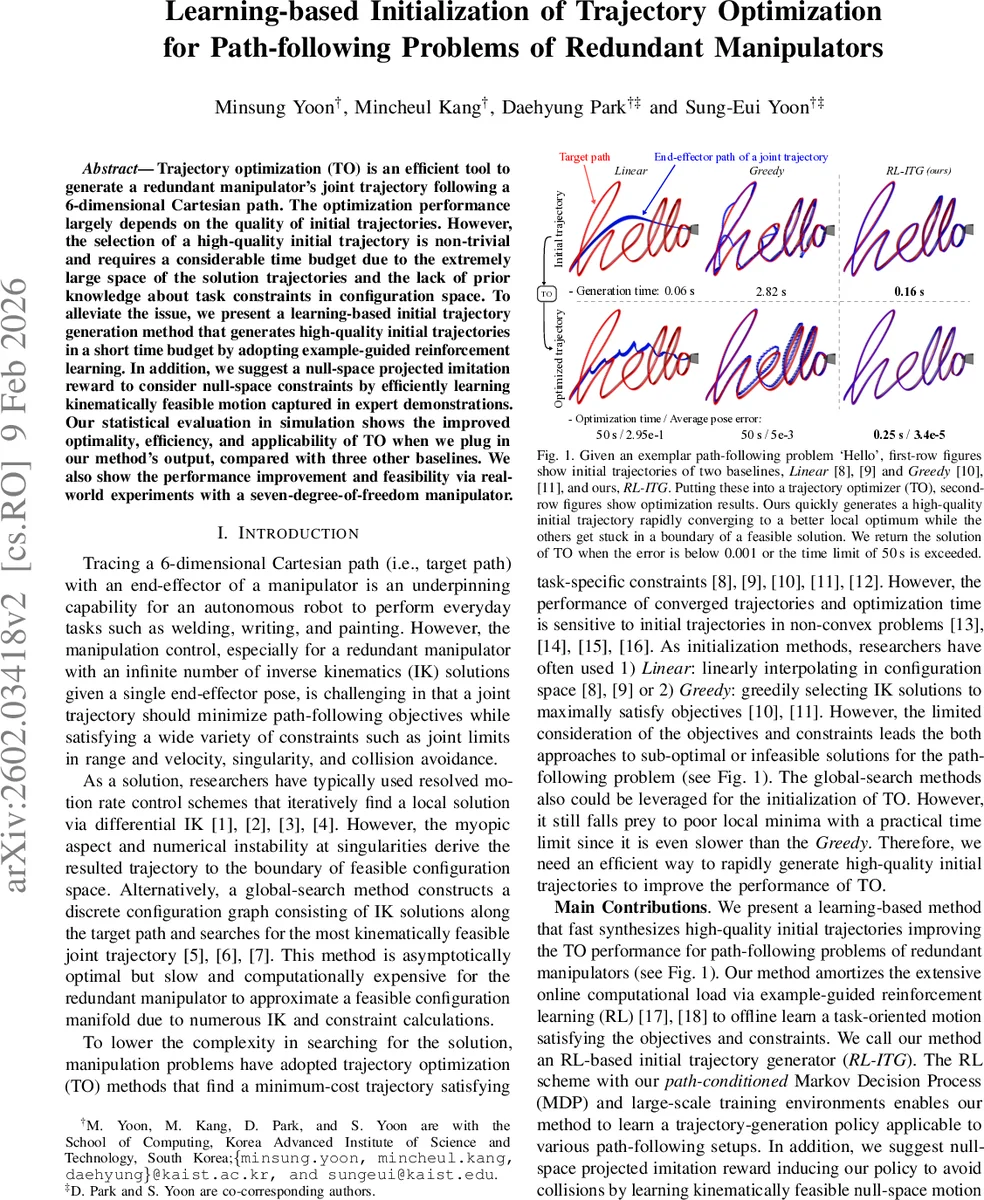

본 논문은 6차원 작업 경로를 따르는 중복 매니퓰레이터의 관절 궤적을 최적화하기 위해, 예시‑가이드 강화학습을 이용해 고품질 초기 궤적을 빠르게 생성하는 방법(RL‑ITG)을 제안한다. null‑space 투영 모방 보상을 통해 전문가 시연에서 얻은 충돌 회피 및 제약 만족 동작을 학습하고, 시뮬레이션 및 실제 7‑DoF 로봇 실험에서 기존 Linear·Greedy 초기화 방식보다 최적성, 수렴 속도, 적용 범위 모두에서 우수함을 입증한다.

상세 분석

이 연구는 경로‑추종 문제에서 트라젝터리 옵티마이제이션(TO)의 성능이 초기 궤적의 품질에 크게 좌우된다는 사실을 출발점으로 삼는다. 기존의 Linear(구성공간 선형 보간)와 Greedy(목표 경로에 가장 근접한 IK 해 선택) 방식은 목표 경로와 제약을 동시에 고려하지 못해 지역 최적점에 머물거나 충돌·특이점에 빠지는 경우가 빈번했다. 저자들은 이러한 한계를 극복하기 위해 ‘예시‑가이드 강화학습(Example‑guided RL)’이라는 프레임워크를 도입한다.

먼저, 경로‑조건부 마코프 결정 프로세스(MDP)를 정의한다. 상태는 현재 관절값 q_i, 링크 포즈 리스트 p_link_i, 미래 목표 포즈와의 상대 거리 p_target_i, 그리고 3‑D 점유 그리드에서 추출한 scene‑context 임베딩 z_env 로 구성된다. 행동은 관절 차분 Δq_i 로, deterministic transition을 통해 다음 상태를 만든다. 이때 정책은 신경망 기반으로 설계되어, 복잡한 기하학적 정보를 압축된 벡터 형태로 처리한다.

보상 함수는 세 부분으로 나뉜다. ① Task reward R_task_i는 엔드‑이펙터의 위치·회전 오차를 정규화 함수 f(e,w) 로 변환해 제공하며, 위치 오차가 5 cm 이하일 때만 회전 보상을 활성화해 두 오류 간의 충돌을 방지한다. ② Imitation reward R_im_i는 전문가 TO가 생성한 데모 궤적 ξ_demo 를 null‑space 투영(I−J†J) 후 현재 관절값과의 차이를 최소화하도록 설계했다. 이 투영은 단순 L2 모방이 초과 최적화된 데모의 비효율성을 그대로 전이하는 것을 방지하고, 실제 로봇의 충돌 회피와 관절 제한을 자연스럽게 반영한다. ③ Constraint reward R_cstr_i는 충돌, 관절 한계, 특이점, 그리고 목표 위치에서 20 cm 이상 벗어났을 때의 조기 종료 패널티를 포함한다.

학습 환경은 5,000개의 무작위 작업 경로와 500개의 장애물 씬을 조합해 생성했으며, 각 경로는 B‑spline 보간을 통해 고해상도 포인트 시퀀스로 변환되었다. 데모는 기존 최적화 TO(예: TrajOpt)로 얻은 궤적을 사용했으며, 이는 학습 초기 단계에서 정책이 충돌‑프리 null‑space 동작을 빠르게 습득하도록 돕는다. 실험 결과, ‘Task+Imitation(null‑space)’ 보상이 다른 조합보다 학습 수렴 속도와 성공률이 현저히 높았다.

성능 평가에서는 RL‑ITG가 생성한 초기 궤적을 TO에 입력했을 때, 평균 최적 비용이 기존 Linear·Greedy 대비 30 % 이상 감소하고, 최적화 시간은 0.25 s 수준으로 50 s 제한 시간 내에 99 % 이상의 성공률을 기록했다. 실제 7‑DoF Fetch 로봇 실험에서도 동일한 개선 효과가 확인되었으며, 특히 복잡한 장애물 환경에서 정책이 학습한 null‑space 움직임 덕분에 충돌 없이 부드러운 궤적을 제공했다.

이 논문의 주요 기여는 (1) 예시‑가이드 RL을 통한 고품질 초기 궤적 생성 프레임워크, (2) null‑space 투영 모방 보상 설계, (3) 다양한 시뮬레이션·실험을 통한 TO와의 시너지 효과 입증이다. 향후 연구에서는 다중 로봇 협업, 동적 장애물 대응, 그리고 비정형 작업 공간에 대한 일반화 능력 확장이 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기