Fast KVzip: 초고속 KV 캐시 압축을 위한 게이트 기반 탈락 기법

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

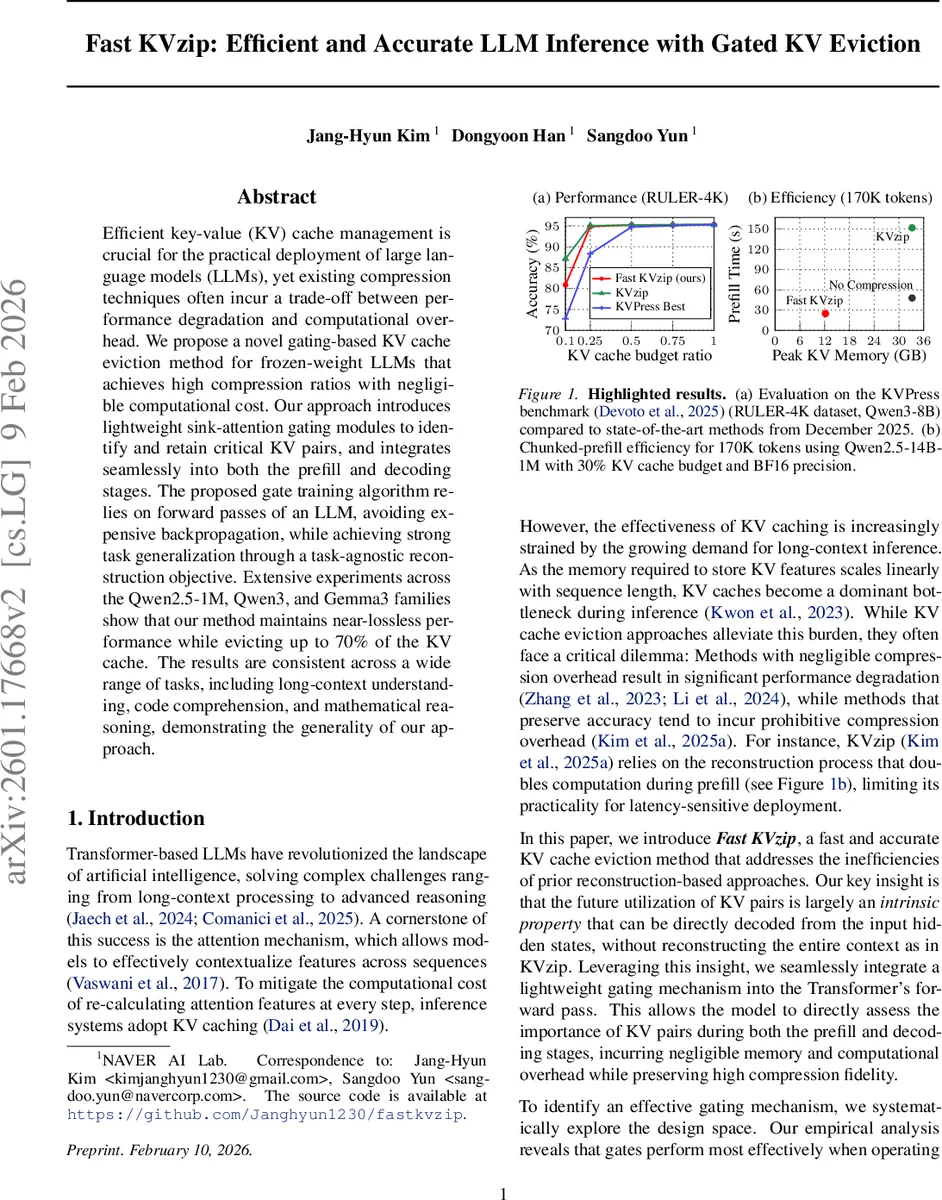

본 논문은 대형 언어 모델(LLM)의 추론 시 KV 캐시 메모리를 효율적으로 줄이기 위해, 사전 학습된 가중치를 고정한 채 경량 게이트 모듈을 삽입해 KV 쌍의 중요도를 예측하고, 중요도가 낮은 KV를 실시간으로 삭제한다. 게이트는 순전파만으로 학습되며, 재구성 기반 목표를 사용해 70%까지 캐시를 축소하면서도 정확도 손실을 거의 보이지 않는다. 다양한 모델(Qwen2.5, Qwen3, Gemma3)과 장기 컨텍스트·코드·수학 작업에 대해 광범위한 실험을 수행하였다.

상세 분석

Fast KVzip은 기존 KV 압축 기법이 겪는 “성능 저하 vs. 연산 비용” 딜레마를 해소하고자 설계되었다. 핵심 아이디어는 미래 토큰이 현재 KV를 얼마나 활용할지를 직접적인 히든 상태에서 추론할 수 있다는 점이다. 이를 위해 각 트랜스포머 레이어에 경량 ‘sink‑attention’ 형태의 게이트 모듈을 삽입한다. 게이트는 입력 히든 벡터를 받아

댓글 및 학술 토론

Loading comments...

의견 남기기