몰마그래프: 동적 과제 지향 장면 그래프와 비전‑언어 모델의 융합

초록

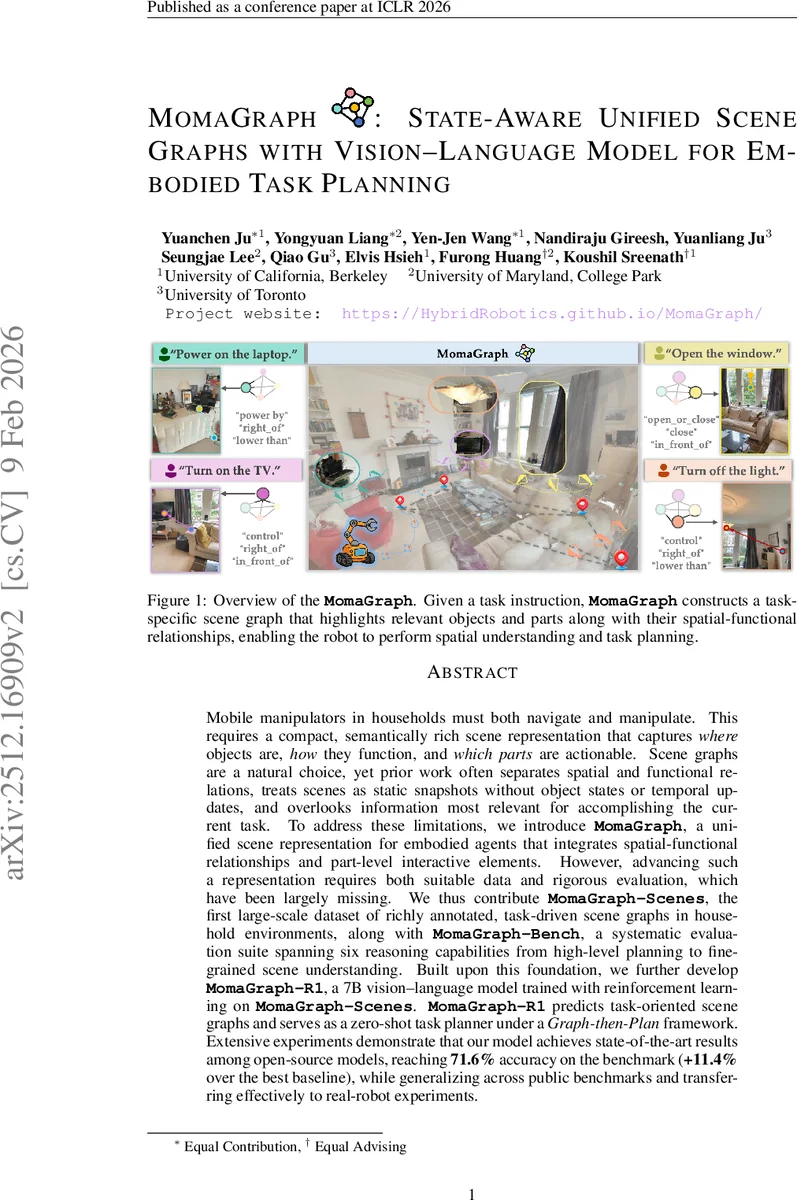

몰마그래프는 공간·기능 관계와 파트‑레벨 상호작용을 하나의 그래프로 통합한 장면 표현을 제안한다. 이를 위해 대규모 MomaGraph‑Scenes 데이터셋과 6가지 추론 능력을 평가하는 MomaGraph‑Bench 을 구축하고, 강화학습 기반 7B 비전‑언어 모델 MomaGraph‑R1 을 학습한다. 그래프‑후‑플랜(Graph‑then‑Plan) 파이프라인을 통해 제로샷 과제 계획을 수행하며, 공개 모델 대비 11.4%p 향상된 71.6% 정확도를 달성하고 실제 로봇 실험에서도 강인한 일반화를 보인다.

상세 분석

본 논문은 가정용 모바일 매니퓰레이터가 “이동+조작”을 동시에 수행하기 위해 필요한 장면 표현의 한계를 정확히 짚어낸다. 기존 연구는 공간 관계만을 다루는 Spatial‑Graph 혹은 기능 관계만을 다루는 Functional‑Graph에 머물러, 물체의 위치와 작동 가능성을 동시에 파악하지 못한다는 문제점을 제시한다. 또한 정적 스냅샷을 전제로 하여 물체 상태 변화나 시간적 업데이트를 반영하지 못하고, 과제와 무관한 모든 객체를 동일하게 취급해 불필요한 연산 비용을 초래한다. 이러한 문제를 해결하기 위해 몰마그래프는 (1) E_s 와 E_f 라는 두 종류의 방향성 엣지를 하나의 그래프에 병합하고, (2) 파트‑레벨 노드(N_part)를 도입해 손잡이, 버튼 등 직접 상호작용 가능한 세부 부위를 명시한다. 그래프는 입력 이미지 집합 {I_i}와 자연어 명령 T 에 조건화되어, 과제에 직접 관련된 객체와 관계만을 포함하는 최소·충분한 표현 G_T = (N_T, E_T^s, E_T^f) 를 생성한다.

데이터 측면에서는 MomaGraph‑Scenes 라는 10k 이상의 실내 장면에 대해 멀티‑뷰 이미지, 행동 로그, 파트 레이블, 그리고 과제 지향 그래프 어노테이션을 제공한다. 이는 기존 3DSceneGraph 데이터셋이 제공하지 못한 “상태 변화”와 “과제 연관성”을 동시에 담고 있다. 평가용 MomaGraph‑Bench 은 (1) 고수준 과제 계획, (2) 경로 탐색, (3) 물체‑파트 인식, (4) 상태 추론, (5) 관계 일관성, (6) 그래프 형식 검증 등 6가지 추론 능력을 정량화한다.

모델 구현에서는 Qwen‑2.5‑VL‑7B‑Instruct 기반의 MomaGraph‑R1 을 강화학습(DAPO)으로 미세조정한다. 핵심은 그래프‑정합 보상 R(G_pred, G_gt) 으로, (a) 액션 타입 일치, (b) 공간·기능 엣지의 라벨 유사도, (c) 노드 집합의 IoU, (d) JSON 형식·출력 길이 제약을 가중치 w_a, w_f, w_l 으로 조절한다. 이 보상 설계는 “과제‑지향성”, “공간‑기능 통합”, “구조적 완전성”을 동시에 최적화하도록 만든다. 실험 결과, 동일 모델을 Spatial‑only 혹은 Functional‑only 그래프로 학습했을 때보다 Unified 그래프가 평균 +6.7%p (전체 71.6% vs 64.9%) 향상되었으며, LLaVA‑One 기반 변형에서도 동일한 추세가 관찰된다. 또한, GPT‑5와 같은 대형 폐쇄형 VLM을 직접 입력 이미지에 적용했을 때는 전제조건 누락·잘못된 액션 선택이 빈번했지만, Graph‑then‑Plan 파이프라인을 사용한 경우 정답률이 30%p 이상 상승한다.

실제 로봇 실험에서는 “창문 열기”, “깨끗한 물 끓이기” 등 4가지 복합 과제를 수행했으며, MomaGraph‑R1은 평균 85% 성공률을 기록, 기존 베이스라인(≈70%)보다 현저히 높은 안정성을 보였다. 이는 모델이 시각적 노이즈에 강인하고, 과제에 맞는 파트‑레벨 상호작용을 정확히 추출함을 의미한다.

결론적으로, 본 연구는 (1) 통합된 공간‑기능·파트 그래프가 임베디드 로봇의 인지·계획에 필수적임을 실증, (2) 대규모 과제‑지향 데이터와 체계적 벤치마크가 없던 공백을 메우고, (3) 강화학습 기반 VLM이 구조화된 그래프를 효율적으로 학습할 수 있음을 보여준다. 향후 연구는 그래프 자동 업데이트(시간적 흐름), 멀티‑에이전트 협업, 그리고 더 큰 규모의 멀티모달 사전학습과의 결합을 통해 실제 가정 환경에서의 완전 자율성을 목표로 할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기