다국어 대형 언어 모델의 내부 표현 메커니즘 탐구

초록

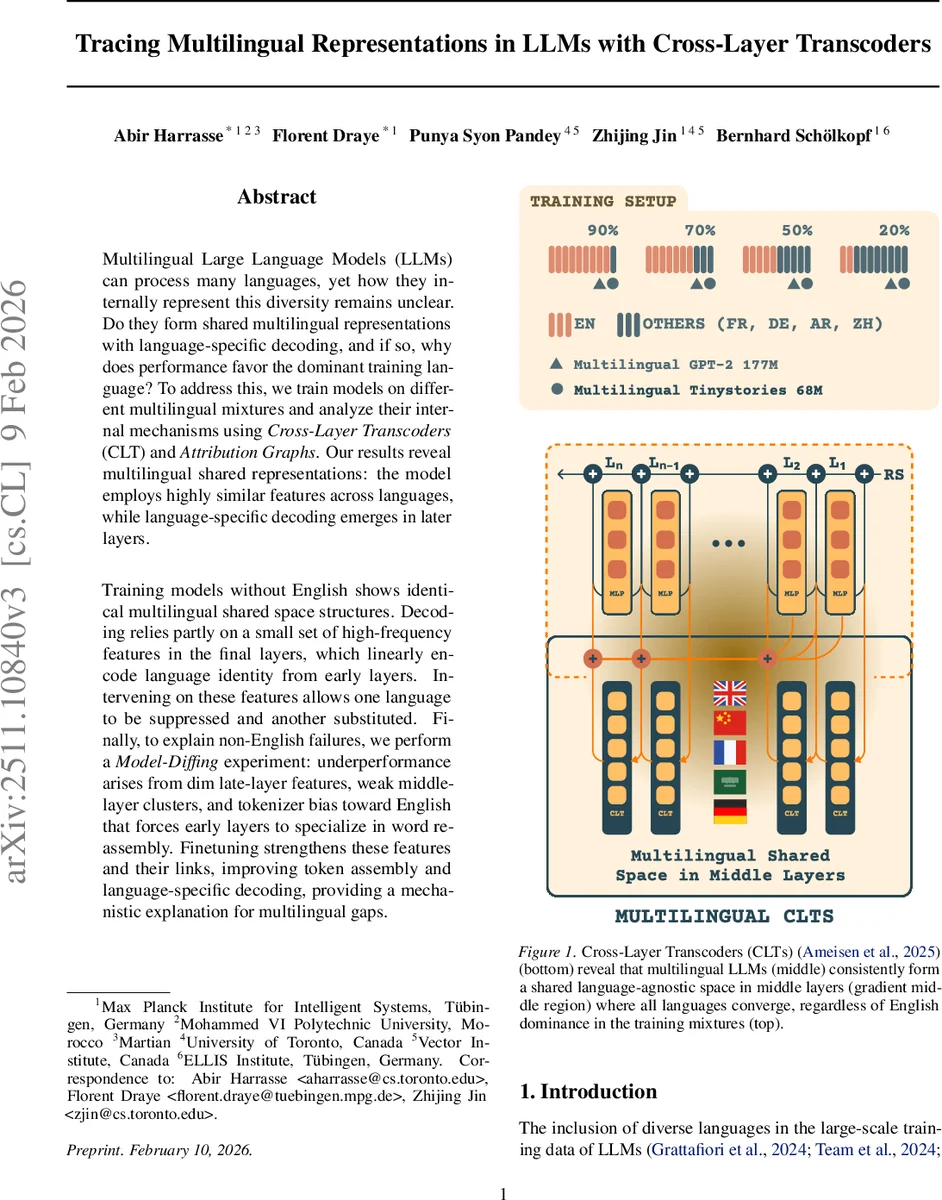

본 논문은 다국어 LLM이 언어별 특성을 어떻게 공유하고 구분하는지 분석한다. 저자들은 다양한 언어 비율로 사전학습한 GPT‑2·TinyStories 계열 모델에 Cross‑Layer Transcoders(CLT)를 적용해 층별 특징 흐름을 추적하고, 언어‑공통 표현이 중간 층에 형성되며 최종 층에서 소수의 고빈도 특징이 언어 정체성을 디코딩한다는 사실을 밝혀냈다. 영어가 지배적인 데이터셋이 아니어도 동일한 구조가 나타나며, 비영어 성능 저하는 후기‑층 특징 약화와 토크나이저 편향에 기인한다는 결론을 제시한다.

상세 분석

이 연구는 다국어 대형 언어 모델(LLM)의 내부 메커니즘을 규명하기 위해 두 가지 핵심 도구—Cross‑Layer Transcoders(CLT)와 Attribution Graphs—를 도입했다. CLT는 각 층의 MLP 입력을 저차원 특징(z)으로 인코딩하고, 다른 층의 MLP 출력을 디코딩함으로써 층간 특징 전이를 정량화한다. 저자들은 이를 통해 “언어 피벗(pivot) 메커니즘”을 발견했는데, 이는 모든 언어가 중간 층에서 동일한 다언어 공유 공간에 매핑되고, 이후 층에서 언어‑특정 디코딩이 이루어진다는 의미다.

실험 설계는 크게 두 축으로 나뉜다. 첫째, 영어 비중을 90%에서 20%까지 변화시키는 불균형 데이터와, 영어를 완전히 배제한 균형 데이터(프랑스·독일·아랍·중국어 각각 25%)를 사용해 모델을 학습시켰다. 둘째, 177M 파라미터 GPT‑2와 68M 파라미터 TinyStories 두 규모 모델, 그리고 LLaMA‑3.2‑1B를 비교했다. 모든 설정에서 중간 층(5~6층)의 다언어 엔트로피가 최고점에 도달하고, 초기·최종 층에서는 엔트로피가 낮아지는 U‑shape 패턴을 보였다. 이는 초기 층이 언어‑특정 형태소·어휘 정보를, 중간 층이 언어‑공통 의미·구문 구조를, 최종 층이 언어‑특정 출력 토큰을 재구성한다는 가설을 뒷받침한다.

특히, 저자들은 “고빈도 언어 특징(high‑frequency language features)”을 식별했다. 이 특징들은 최종 MLP 층에서 소수(≈0.5%)만이 전체 로그잇에 80% 이상의 영향을 미치며, 선형 회귀 분석을 통해 초기 층의 토큰 임베딩과 강하게 연결돼 있음을 확인했다. 이러한 특징을 직접 조작(intervention)하면 목표 언어를 억제하거나 다른 언어로 교체할 수 있었으며, 이는 언어 정체성 디코딩이 제한된 수의 핵심 뉴런에 의존한다는 강력한 증거다.

비영어 성능 저하 원인 분석에서는 Model‑Diffing 실험을 수행했다. 영어‑우세 모델과 비영어‑우세 모델 간의 차이를 층별 특징 강도와 클러스터링 밀도로 정량화했으며, 비영어 모델은 후기‑층 특징이 희미하고 중간‑층 클러스터가 약하며, 토크나이저가 영어 어휘에 편향돼 있어 초기 층이 “단어 재조립(word reassembly)”에 과도하게 집중한다는 점을 발견했다. 파인튜닝을 통해 이러한 약한 특징을 강화하고, 특징 간 연결을 재구성하면 비영어 토큰 재구성 정확도가 크게 상승한다.

전반적으로 이 논문은 다국어 LLM이 언어‑공통 표현과 언어‑특정 디코딩을 명확히 구분하는 계층적 구조를 가지고 있음을 실증하고, 토크나이저 설계와 후기‑층 특징 강화가 비영어 성능 격차를 해소하는 실용적 방안을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기