컬러3D: 개인화된 색채 변환기로 구현하는 제어 가능한 3D 색채화

초록

**

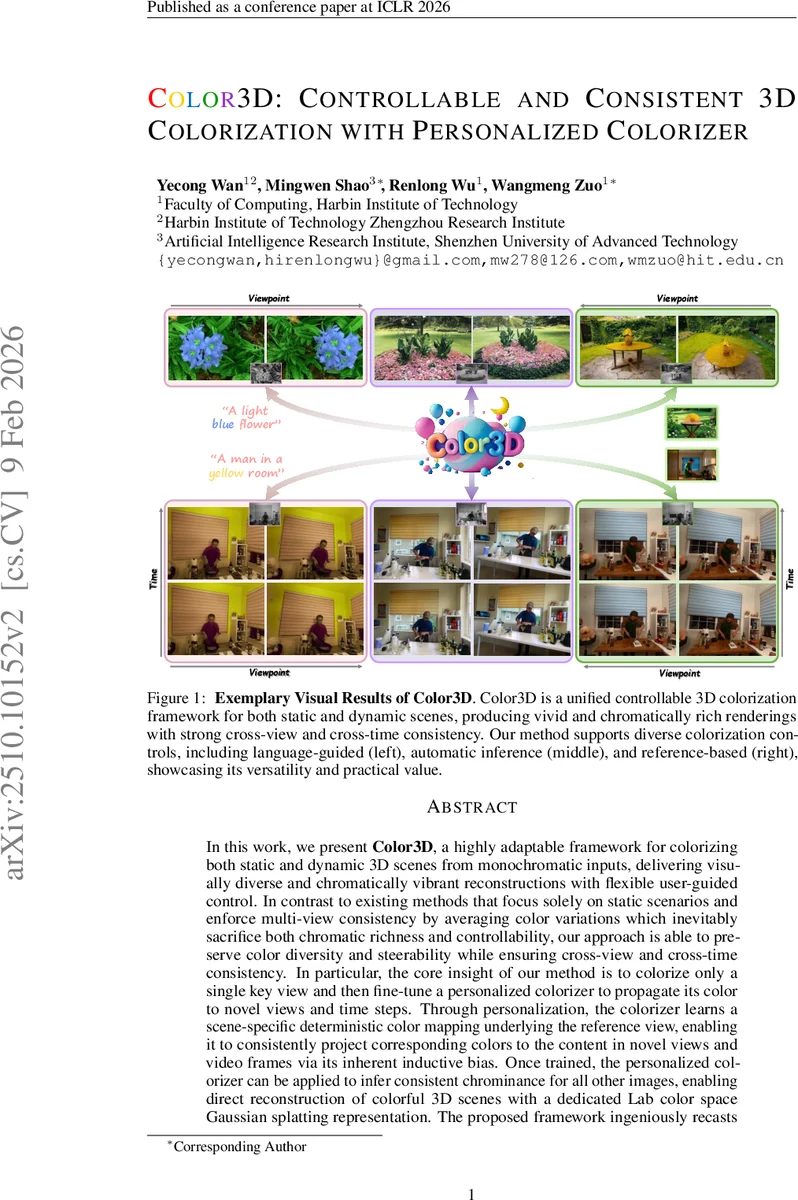

컬러3D는 단일 키 뷰를 색채화하고, 해당 뷰를 기반으로 씬 전용 개인화 색채 변환기를 학습시켜 정적·동적 3D 장면 전체에 일관된 색을 전파한다. Lab 색공간 기반 Gaussian Splatting을 이용해 색과 밝기를 별도로 최적화함으로써 풍부한 색감과 높은 사용자 제어성을 동시에 제공한다.

**

상세 분석

**

본 논문은 3D 색채화 문제를 “단일 이미지 색채화 → 씬 전용 색채 변환기 학습 → 다중 뷰/프레임 전파”라는 세 단계 파이프라인으로 재구성한다. 핵심 아이디어는 전체 씬을 한 번에 학습시키는 대신, 가장 정보량이 풍부한 키 뷰를 선택하고, 최신 2D 색채화 모델(언어‑가이드, 레퍼런스‑가이드, 자동‑가이드 등)으로 색을 입힌 뒤, 해당 결과를 정밀하게 복제할 수 있는 개인화 색채 변환기를 미세조정한다는 점이다.

-

키 뷰 선택 – CLIP 특징을 이용해 모든 입력 그레이스케일 이미지/프레임을 정규화하고, 코사인 유사도 기반 확률 분포를 만든 뒤 엔트로피를 계산한다. 엔트로피가 가장 높은 뷰는 다른 뷰와의 관계가 고르게 분포되어 있어, 씬 전반에 걸친 색 정보가 가장 풍부하다고 판단하고 키 뷰로 채택한다.

-

단일 뷰 색채화와 증강 – 선택된 키 뷰에 오프‑더‑쉘프 2D 색채화 모델을 적용한다. 이후 저자들은 생성 기반 증강(Stable Diffusion을 이용한 아웃페인팅, 이미지‑투‑비디오 디퓨전, Stable Virtual Camera를 통한 가상 궤도 뷰)과 전통적 변형(회전, 플립, 그리드 셔플, 탄성 변환)을 결합해 다수의 색 일관성을 유지한 합성 샘플을 만든다. 이 과정은 개인화 색채 변환기의 일반화 능력을 크게 향상시킨다.

-

개인화 색채 변환기 학습 – 색채 변환기의 백본은 사전 학습된 DDColor 인코더이며, 어댑터와 CNN 디코더가 가변 파라미터로 동작한다. 키 뷰와 증강 샘플을 이용해 L1‑CLIP 손실과 엔트로피 기반 색 일관성 손실을 동시에 최소화한다. 결과적으로 변환기는 “하나의 입력 이미지 → 하나의 결정적 색 매핑”을 학습하게 되며, 이는 새로운 뷰나 시간 프레임에서도 동일한 물체에 동일한 색을 일관되게 부여한다.

-

Lab Gaussian Splatting 재구성 – 색채 변환기의 출력은 Lab 색공간으로 변환된다. 저자들은 3D Gaussian Splatting(정적) 및 4D Gaussian Splatting(동적) 구조에 L, a, b 채널을 별도로 최적화하는 두 단계 워밍업 전략을 도입한다. 먼저 밝기(L)만을 학습해 기하학적 정합성을 확보하고, 이후 전체 Lab 채널을 동시에 업데이트해 색채 풍부함을 복원한다.

-

일관성·다채로움·제어성 – 기존 연구가 다중 뷰 평균화 혹은 디스틸레이션을 통해 색 일관성을 강제하면서 색채 다양성을 희생한 반면, 컬러3D는 단일 뷰 기반 개인화 매핑을 통해 색채 다양성을 보존한다. 또한 언어 프롬프트, 레퍼런스 이미지, 자동 색채화 등 다양한 사용자 인터페이스를 그대로 적용할 수 있어 실시간 색조정이 가능하다.

-

실험 및 한계 – 정적(DTU, Tanks & Temples)와 동적(DynamicScenes, In‑the‑wild 영상) 데이터셋에서 PSNR, SSIM, LPIPS, 색상 일관성 지표 모두 기존 ColorNeRF, ChromaDistill 등과 비교해 우수함을 보였다. 특히 색상 변동이 큰 장면에서 색상 포화도가 높게 유지되는 것이 눈에 띈다. 다만, 개인화 색채 변환기 학습에 추가적인 증강 단계가 필요하므로 전체 파이프라인 실행 시간이 기존 2D‑to‑3D 방식보다 약간 늘어나는 점과, 생성 기반 증강이 실제 씬과 크게 다를 경우 색 매핑이 과도하게 일반화될 위험이 있다는 제한점이 제시된다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기