VIMD: 시각‑관성 융합으로 구현하는 픽셀‑단위 스케일 정밀화 단일 카메라 깊이 추정

초록

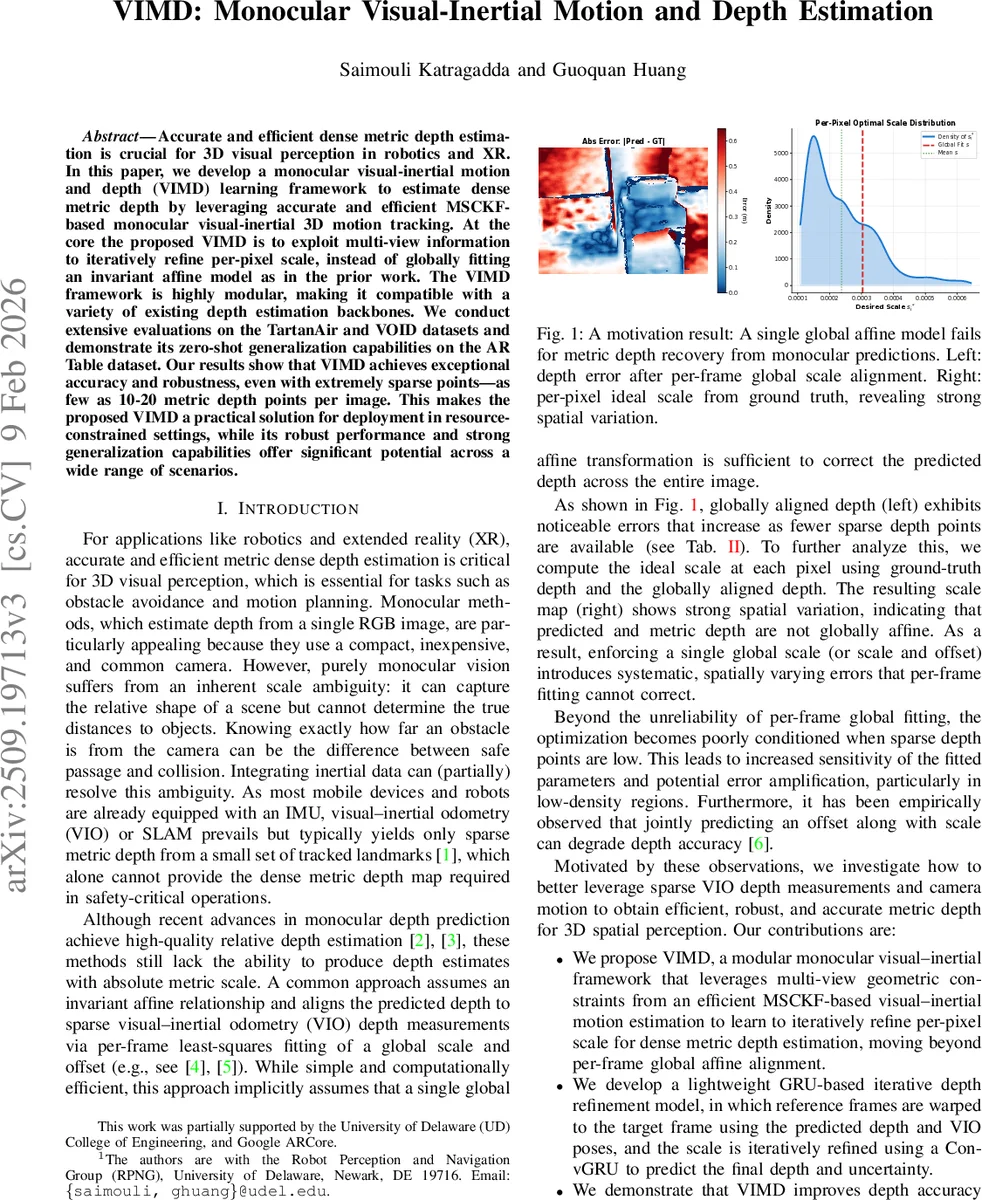

VIMD는 MSCKF 기반의 단일 카메라·IMU 모션 트래킹을 활용해, 전역 스케일·오프셋 정합이 아닌 다중 뷰 정보를 이용해 픽셀별 스케일을 반복적으로 정제하는 모듈식 학습 프레임워크이다. 경량 ConvGRU와 스케일‑맵 스캐폴드를 결합해 10~20개의 희소 메트릭 깊이 포인트만으로도 높은 정확도와 강인성을 달성한다.

상세 분석

본 논문은 기존의 “전역 어핀 정합” 방식이 실제 장면에서 스케일이 공간적으로 크게 변한다는 점을 실험적으로 확인하고, 이를 극복하기 위한 두 가지 핵심 아이디어를 제시한다. 첫째, MSCKF‑ 기반 VIO로부터 얻은 희소 3D 포인트와 카메라 포즈를 이용해 각 픽셀에 대한 로컬 스케일 값을 계산하고, 이를 2‑D 선형 보간으로 전역 스케일‑맵(S)으로 확장한다. 이 스케일‑맵은 네트워크 입력에 추가적인 사전 정보로 제공되어, 초기 전역 정합(GA) 단계에서 남는 지역적 오차를 크게 감소시킨다. 둘째, ConvGRU 기반의 반복 정제 모듈을 설계하여, 목표 프레임과 두 개의 레퍼런스 프레임 사이의 광학 흐름을 현재 깊이 가설에 따라 워핑하고, 워핑된 특징 간 코사인 유사도로 비용 맵(c)을 만든다. 비용과 현재 깊이 가설을 각각 별도 컨볼루션 스트림으로 투영한 뒤, 컨텍스트 특징과 결합해 GRU에 입력함으로써 스케일 보정(Δs)과 불확실성(log σ²)을 순차적으로 업데이트한다. 이 과정을 3번 반복함으로써 다중 뷰 기하 제약을 충분히 활용하고, 희소 포인트가 부족한 영역에서도 깊이 추정이 안정적으로 수렴한다.

학습 손실은 다중 스케일 역깊이와 불확실성 가중 라플라스 로그우도(Laplace NLL)를 결합한 형태이며, 깊이 범위(0.1 m8 m)를 클램프해 극단값에 대한 민감도를 낮춘다. 실험에서는 TartanAir와 VOID 데이터셋에서 기존 VI‑Depth, VOICED, KBNet 등과 비교해 RMSE·MAE·iRMSE·iMAE 모두 1030% 정도 개선했으며, 특히 10~20개의 희소 포인트만 사용할 때도 성능 저하가 미미했다. 또한 AR Table 데이터셋에 대한 제로‑샷 테스트에서 실시간(≈30 fps) 추론과 함께 높은 일반화 능력을 보였다.

이러한 설계는 (1) 전역 어핀 모델이 갖는 스케일 편향을 근본적으로 해소하고, (2) VIO에서 제공하는 정확한 카메라 포즈와 희소 깊이 정보를 효율적으로 활용하며, (3) 기존의 라티스 코드 기반 방법이 요구하는 온라인 최적화와 저차원 제한을 피한다는 점에서 의미가 크다. 다만 현재는 IMU‑카메라 동기화가 전제이며, 고속 움직임이나 강한 동적 씬에서는 VIO 추정 오류가 정제 단계에 전파될 위험이 있다. 향후 비동기 캘리브레이션 및 동적 객체 마스킹을 결합하면 더욱 견고한 시스템이 될 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기