딥러닝 불확실성도 법칙을 따른다: 데이터가 아무리 많아도 베이지안은 필요하다

초록

이 연구는 딥러닝 모델의 예측 불확실성이 데이터셋 크기와 모델 크기에 따라 예측 가능한 스케일링 법칙을 따른다는 것을 처음으로 경험적으로 증명했습니다. 비전 및 언어 작업에서 다양한 베이지안 추론 및 앙상블 방법을 통해 측정한 불확실성이 모두 멱법칙(power-law)을 따르며, 이는 “데이터가 충분히 많으면 베이지안 접근법이 필요 없다"는 회의론에 대한 강력한 반증이 됩니다.

상세 분석

본 논문은 딥러닝의 성능(테스트 손실)에 대한 스케일링 법칙에 영감을 받아, 예측 불확실성에 대한 유사한 법칙이 존재하는지 체계적으로 탐구합니다. 기술적 분석의 핵심은 다음과 같습니다.

첫째, 연구팀은 식별 가능한 매개변수 모델에서의 전통적인 베이지안 이론(인식 불확실성이 O(1/N)으로 수렴)이 과매개변수화된 딥러닝 모델에서는 적용되지 않음을 지적합니다. 이는 모델의 특이성(singularity), 비식별성(non-identifiability), 비가우시안 사후분포 등 복잡한 구조 때문입니다.

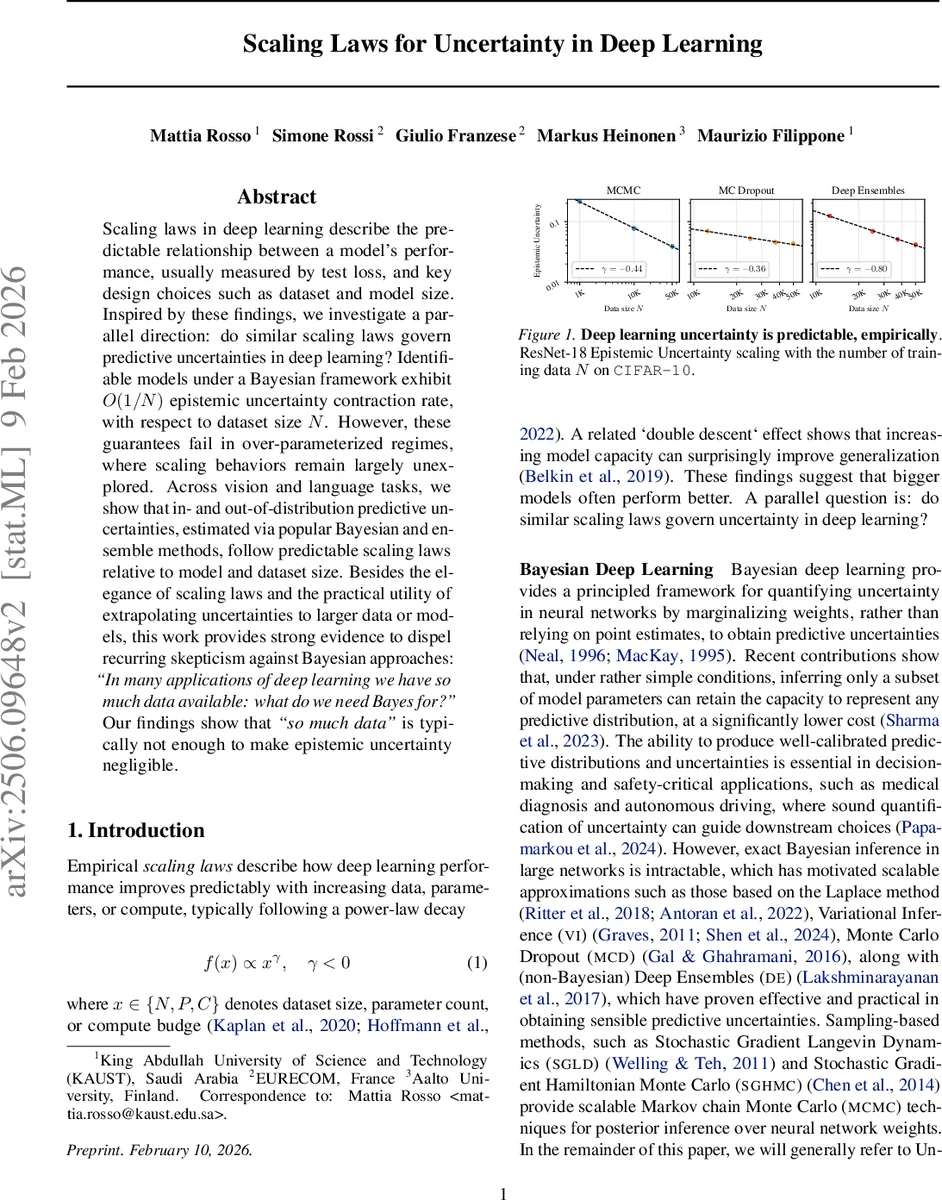

둘째, Monte Carlo Dropout, Deep Ensembles, Markov Chain Monte Carlo, Variational Inference 등 다양한 불확실성 정량화(UQ) 방법을 ResNet, Vision Transformer 등의 아키텍처에 적용해 CIFAR, ImageNet 등에서 실험합니다. 놀랍게도 모든 설정에서 총 불확실성(TU), 우연 불확실성(AU), 인식 불확실성(EU)이 데이터 크기(N)와 모델 크기(P)에 대해 멱법칙(𝑁^𝛾, 𝑃^𝛾)을 따르는 것을 발견했습니다. 예를 들어, CIFAR-10에서 ResNet-18의 MCMC 기반 EU는 𝑁^(−0.44)로 스케일링되었습니다.

셋째, 이 현상에 대한 이론적 통찰을 제공하기 위해 Singular Learning Theory(SLT)와의 연결고리를 모색합니다. SLT는 신경망을 특이 통계 다양체로 모델링하며, 일반화 오차가 Real Log Canonical Threshold(RLCT)에 의해 결정되는 𝑂(1/𝑛) 속도로 감소함을 보입니다. 논문은 선형 모델에서 일반화 오차와 총 불확실성(TU) 사이의 형식적 연결을 유도하여, 과매개변수 모델에서 관찰된 스케일링 행동을 설명할 가능성을 제시합니다.

마지막으로, 이 발견의 중요한 함의는 실용적 외삽 가능성과 철학적 반증에 있습니다. 불확실성 스케일링 법칙을 통해 더 큰 데이터나 모델에서의 불확실성을 예측할 수 있으며, 이는 안전-중요 응용 분야에 유용합니다. 동시에, “데이터가 많으면 인식 불확실성이 무시할 수 있을 것이다"라는 딥러닝 커뮤니티 내 흔한 회의론을 데이터가 아무리 많아도 불확실성이 완전히 사라지지 않는 법칙을 보여줌으로써 반박합니다.

댓글 및 학술 토론

Loading comments...

의견 남기기