병렬 레이어 정규화가 구현하는 보편 근사 능력

초록

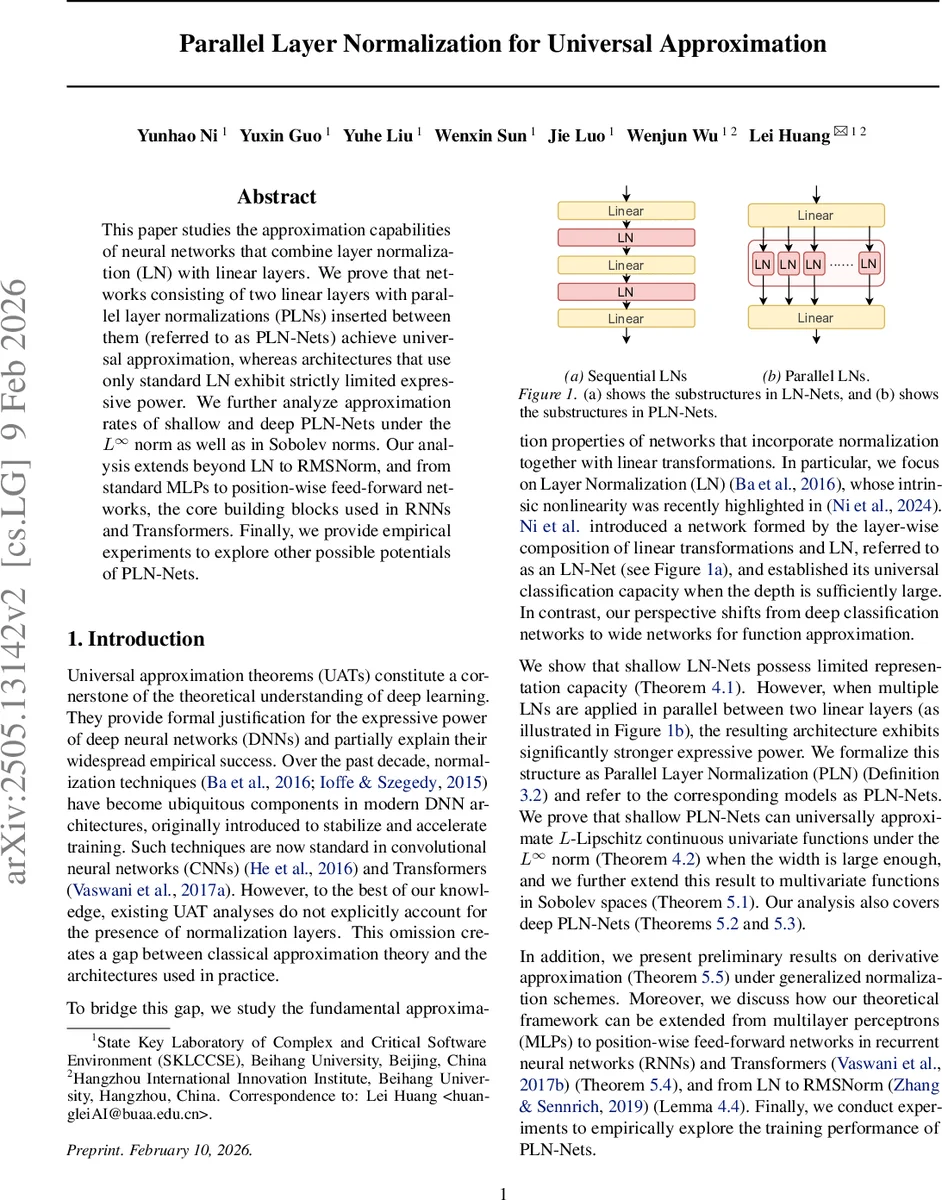

본 논문은 두 개의 선형 층 사이에 병렬 레이어 정규화(PLN)를 삽입한 구조(PLN‑Net)가 L‑Lipschitz 연속 함수와 Sobolev 공간의 다변량 함수들을 임의의 정확도로 근사할 수 있음을 증명한다. 반면, 단일 레이어 정규화(LN)만을 사용한 얕은 네트워크는 표현력이 제한적이며 보편 근사성을 갖지 못한다. 또한 RMSNorm으로의 확장, 깊은 네트워크와 위치‑와이즈 피드포워드 모듈에 대한 적용, 그리고 실험적 검증을 제공한다.

상세 분석

이 논문은 현대 딥러닝에서 필수 요소가 된 정규화 기법을 기존의 보편 근사 이론(Universal Approximation Theorem, UAT)과 연결시키려는 시도이다. 저자들은 먼저 전통적인 레이어 정규화(LN)만을 사용한 얕은 네트워크(“LN‑Net”)가 갖는 구조적 제약을 분석한다. LN은 입력 벡터의 평균을 0, 분산을 1로 강제하는데, 이 과정에서 각 차원의 자유도가 크게 감소한다. 결과적으로 LN‑Net은 단일 폭(width = 1)의 활성화 함수(예: sign, ϕ(x)=x/√(x²+1))를 정확히 구현할 수는 있지만, 연속적인 곡선(예: cos πx)과 같이 두 개 이상의 고정점을 가진 함수는 근사 오차가 최소 1 이상이 된다(정리 4.1). 이는 LN 자체가 비선형성을 제공하지만, 그 비선형성이 충분히 풍부하지 않아 표현력이 제한됨을 의미한다.

이 한계를 극복하기 위해 저자들은 “병렬 레이어 정규화”(Parallel Layer Normalization, PLN)를 제안한다. PLN은 입력 벡터를 동일한 크기의 m개 그룹으로 분할하고, 각 그룹에 독립적으로 LN을 적용한다. 수학적으로는 h=

댓글 및 학술 토론

Loading comments...

의견 남기기