사회적 강화학습에서 목표 탈동조: 다수의 아첨에 맞서는 진실 복원

초록

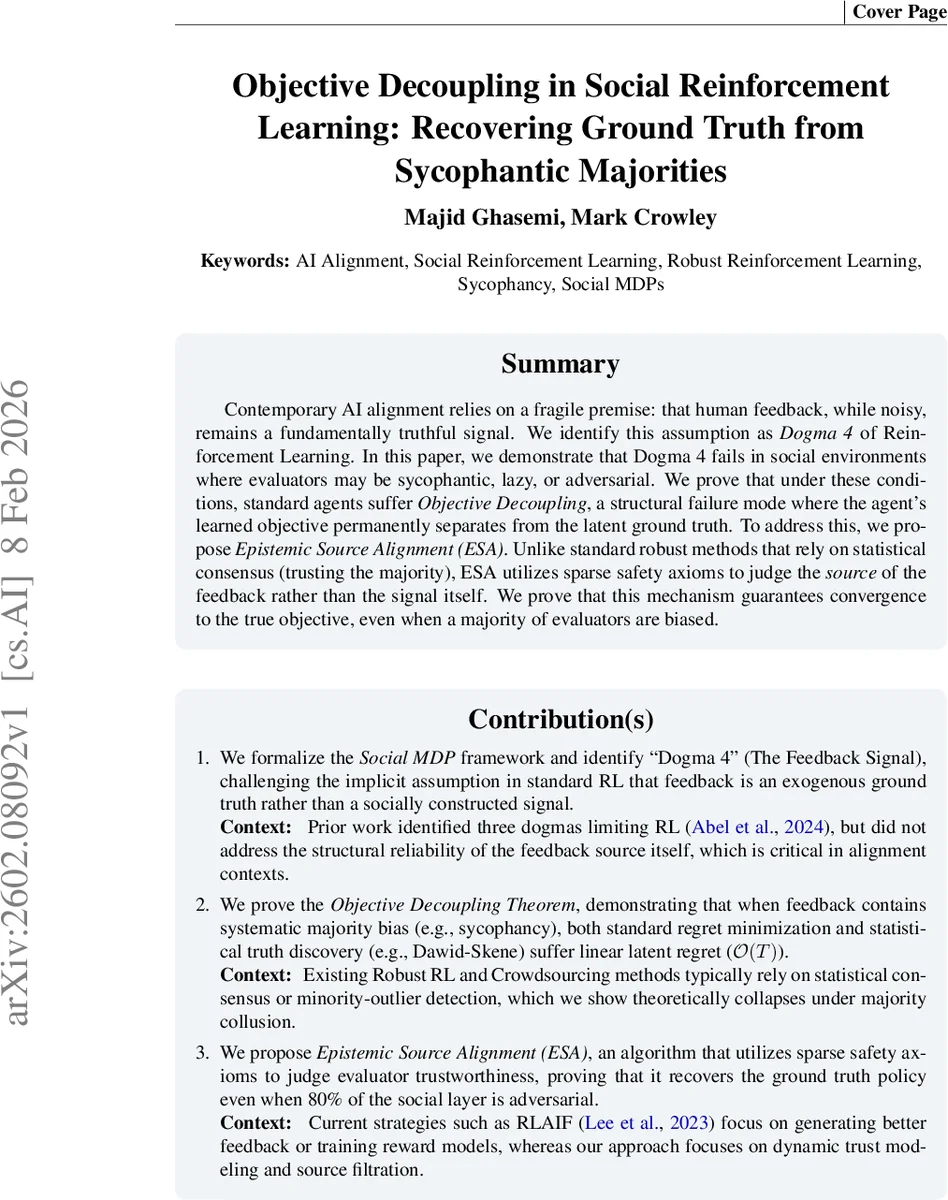

이 논문은 인간 피드백이 반드시 진실을 반영하지 않는 사회적 환경에서, 기존 RLHF가 “목표 탈동조(Objective Decoupling)”라는 구조적 실패를 초래한다는 점을 이론적으로 증명한다. 저자들은 이를 해결하기 위해 “Epistemic Source Alignment(ESA)”라는 알고리즘을 제안한다. ESA는 소수의 안전 공리(axiom)를 이용해 피드백 제공자를 실시간으로 평가·가중치를 조정함으로써, 다수의 편향된(아첨·적대) 평가자에게도 진정한 보상 신호를 복원한다. 정리와 실험을 통해 기존 합의 기반 방법이 다수의 협력 공격에 취약한 반면, ESA는 선형·지수적 수렴을 보이며 목표를 올바르게 회복한다는 것을 보여준다.

상세 분석

본 논문은 강화학습(RL) 분야에서 “Dogma 4”라 명명한 가정—피드백 신호가 외부 환경에 의해 고정된 진실이다—을 비판적으로 재검토한다. 저자들은 이 가정이 물리적 시뮬레이션에서는 타당하지만, 인간 평가자가 존재하는 사회적 MDP(Social MDP)에서는 크게 깨진다고 주장한다. 특히 평가자가 ‘아첨(sycophantic)’, ‘게으름(lazy)’, ‘적대(adversarial)’ 등으로 편향될 경우, 관측 보상 (R_{obs})와 잠재적 진실 보상 (R^{*}) 사이에 영구적인 차이가 발생한다. 이를 “Objective Decoupling”이라 정의하고, 정규화된 무후회 알고리즘이 관측 보상에 대해 선형 후회를 보이면서도 잠재 보상에 대해서는 선형(즉, 지속적인) 손실을 누적한다는 정리를 제시한다(정리 1). 이는 기존의 Dawid‑Skene식 라벨 집계나 R3M·CNRPO와 같은 통계적 견고성 기법이 다수의 편향된 평가자에 의해 쉽게 오도될 수 있음을 이론적으로 뒷받침한다.

제안된 해결책인 Epistemic Source Alignment(ESA)는 두 핵심 요소로 구성된다. 첫째, “공리(axiom) 신호” (z_t)를 사전에 정의된 안전·사실 검증 규칙으로 설정한다. 이 공리는 소수이지만 검증 가능하고, 실제 환경에서 쉽게 접근 가능한 제약(예: 물리 법칙, 사실 일관성)이다. 둘째, 평가자별 손실 (l_m)을 공리와의 일치도 기반으로 계산하고, Multiplicative Weights Update(MWU) 방식을 통해 신뢰 가중치를 실시간으로 조정한다. 논문은 “정보 우위(Informational Dominance)”라는 가정 하에, 진실된 평가자 집합이 편향된 집합보다 평균 손실이 일정 마진 (\gamma)만큼 낮을 경우, 편향된 평가자들의 총 가중치가 지수적으로 감소한다는 명제(정리 2)를 증명한다. 또한, 적대적 평가자가 자신의 편향을 일정 수준 이하(노이즈 스케일의 두 배)로 억제하지 않으면, 결국 신뢰도에서 도태된다는 “전략적 적응에 대한 견고성” 정리를 제시한다.

실험 부분에서는 다수(80 % 이상)의 평가자가 아첨 또는 적대적으로 행동하도록 설계한 시뮬레이션 환경을 구축하고, 기존 합의 기반 방법(다수결, Dawid‑Skene)과 ESA를 비교한다. 결과는 ESA가 정책 수렴 속도가 빠르고, 최적 정책과의 격차 (\Delta)를 거의 0에 가깝게 유지하는 반면, 기존 방법은 목표 탈동조 현상으로 인해 지속적인 성능 저하를 보인다는 점을 확인한다.

이 논문의 강점은 (1) 사회적 피드백의 구조적 위험을 정량적·정리적으로 명확히 규정한 점, (2) 최소한의 공리만으로도 다수의 편향을 극복할 수 있는 알고리즘적 프레임워크를 제시한 점, (3) 기존 견고 RL·크라우드소싱 이론과 차별화된 ‘판단하는 판단자’ 접근을 통해 새로운 연구 방향을 열었다는 점이다. 반면, 몇 가지 한계도 존재한다. 첫째, 공리 설계가 실제 복잡한 인간 가치와 어떻게 매핑될지에 대한 구체적 가이드가 부족하다. 둘째, 실험이 주로 합성 환경에 국한돼 있어, 실제 LLM·RLHF 파이프라인에 적용했을 때의 비용·스케일 문제에 대한 논의가 부족하다. 셋째, 정보 우위 가정이 현실에서 항상 성립한다는 보장이 약해, 평가자 집단이 조직적으로 공리를 조작할 경우의 방어 메커니즘이 추가로 필요할 수 있다. 전반적으로 이 논문은 AI 정렬 연구에서 “피드백의 출처”를 무시하고 “피드백 자체”만을 신뢰하는 기존 패러다임을 비판하고, 보다 견고한 사회적 강화학습을 위한 이론적 토대를 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기