TAAM: 그래프 연속 학습을 위한 작업 인식 적응 모듈링

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

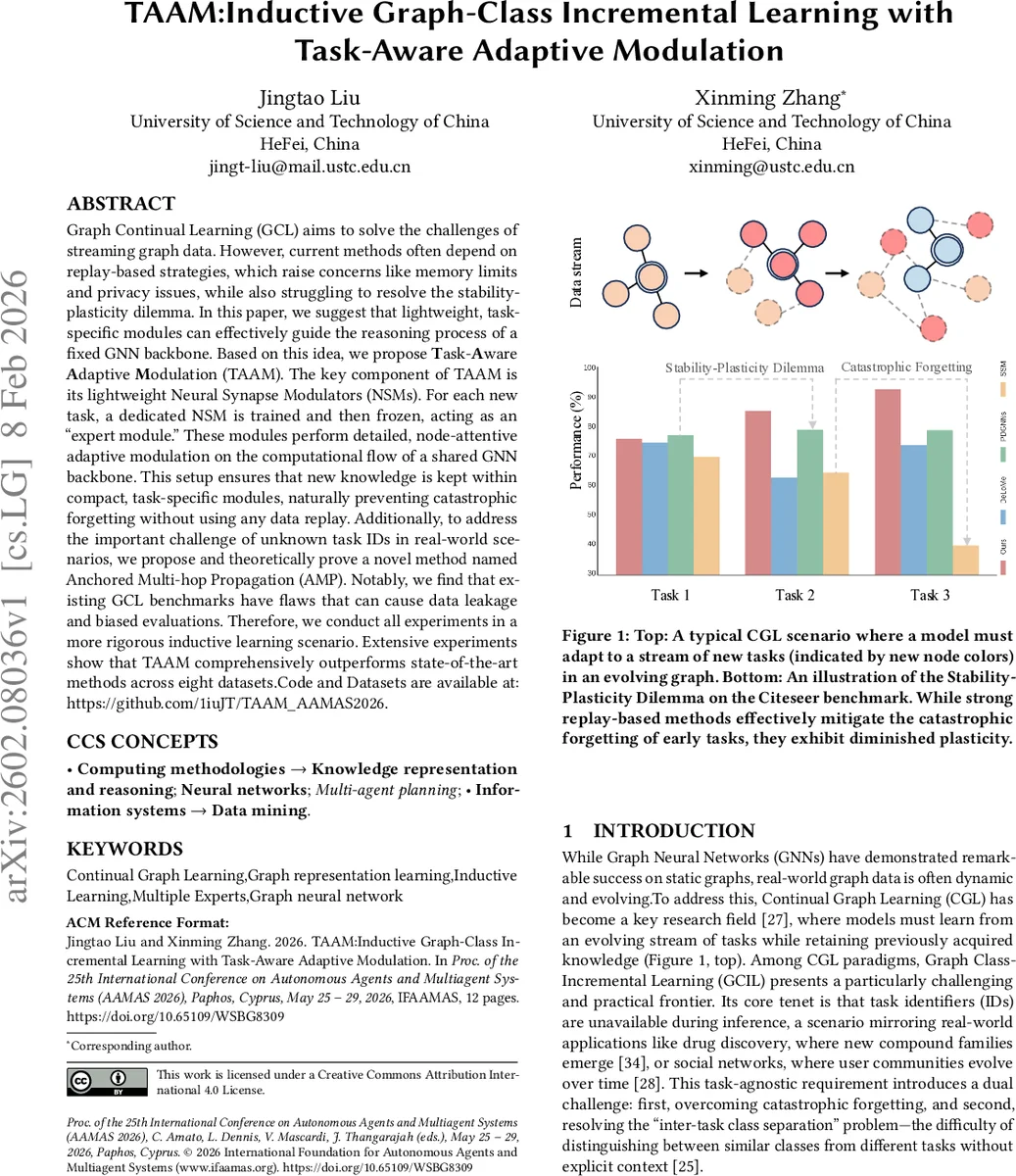

TAAM은 고정된 GNN 백본 위에 경량의 작업별 Neural Synapse Modulator(NSM)를 부착해, replay 없이도 그래프 클래스 증분 학습에서 안정성과 가소성을 동시에 확보한다. AMP라는 다중 홉 전파 기법으로 작업 프로토타입을 생성·비교해 무작위 작업 ID를 추정한다. 실험은 인덕티브 설정에서 8개 데이터셋 전부에서 기존 최첨단 방법들을 크게 앞섰다.

상세 분석

본 논문은 그래프 연속 학습(GCL) 분야에서 두 가지 근본적인 난제—catastrophic forgetting과 task‑ID 부재—를 동시에 해결하고자 한다. 기존의 replay 기반 방법은 메모리·프라이버시 문제를 안고 있으며, 파라미터 고립 방식은 사전 학습된 대규모 GNN이 전제돼야 한다는 한계가 있다. TAAM은 이러한 전제조건을 완전히 배제한다. 핵심 아이디어는 “고정된 백본 + 경량 작업 전용 모듈”이라는 구조이다.

-

Neural Synapse Modulator(NSM)

- 각 작업 τ_k마다 독립적인 NSM을 학습하고, 학습이 끝난 뒤에는 파라미터를 고정한다.

- NSM은 FiLM 방식의 Feature‑wise Linear Modulation을 사용해 노드별 γ_i, β_i를 생성한다. 이를 위해 작업 임베딩 e_k를 저차원 행렬 W_A·e_k와 W_B의 곱으로 H개의 베이스 모듈 벡터 M_k를 만든다.

- 각 노드 특징 h_i에 대해 attention head 가중치 a_i=softmax(h_iW_att)를 구하고, a_i와 M_k를 가중합해 최종 FiLM 파라미터를 얻는다. 이렇게 하면 모듈이 노드 수준에서 세밀하게 조정되면서도 파라미터 수는 O(H·F′)에 불과해 매우 경량이다.

- NSM은 백본인 Simple Graph Convolution(SGC)을 그대로 유지하면서, 출력 피처에 동적으로 변형을 가한다. 따라서 백본은 “안정성”을 담당하고, NSM은 “가소성”을 담당한다는 명확한 역할 분리가 가능하다.

-

Anchored Multi‑hop Propagation(AMP)

- 작업 ID를 직접 제공받지 못하는 상황에서, 각 작업에 대한 대표 프로토타입 p_k를 생성한다.

- APPNP와 유사한 전파 규칙 Z^{(i+1)} = (1‑α)SZ^{(i)} + αH^{(0)}를 여러 홉(ℎ_1…ℎ_m)까지 수행하고, 각 단계의 결과를 CONCAT하여 H_AMP를 만든다.

- 훈련 노드 집합 V_train^k의 평균을 취해 p_k를 정의한다. 테스트 시에도 동일한 절차로 테스트 그래프에 대한 임시 프로토타입을 만든 뒤, 코사인 유사도로 가장 가까운 p_k를 찾아 해당 NSM을 선택한다.

- 이 과정은 전혀 추가적인 메모리 저장 없이, 그래프 구조와 노드 특징을 다중 스케일로 활용해 강건한 작업 구분을 가능하게 한다. 논문에서는 이 방법에 대한 이론적 보장을 제시하고, 실험적으로도 높은 정확도를 기록한다.

-

인덕티브 설정 및 벤치마크 재구성

- 기존 GCL 벤치마크는 트랜스듀시브(학습·테스트 노드가 동일 그래프에 존재) 방식이 대부분이었으며, 이는 데이터 누수 위험을 내포한다.

- 저자들은 각 작업마다 완전히 독립된 서브그래프를 제공하는 인덕티브 시나리오를 채택했다. 즉, G_train^k와 G_test^k는 노드·엣지 모두 겹치지 않는다. 이는 실제 서비스 환경(신규 화합물, 신규 소셜 커뮤니티 등)과 일치한다.

- 8개의 공개 데이터셋(Cora, Citeseer, Pubmed 등)에서 기존 SOTA(Replay 기반, Prompt 기반, 파라미터 고립 기반)를 모두 능가했으며, 특히 메모리·연산 비용이 크게 감소한 점이 강조된다.

-

한계와 향후 과제

- NSM이 작업당 하나씩 추가되므로, 작업 수가 매우 많아질 경우 메모리(모듈 저장)와 추론 시간(프로토타입 매칭)에서 스케일 문제가 발생할 수 있다.

- 현재는 SGC와 같은 단순 GNN을 백본으로 사용했지만, 더 깊고 복잡한 백본(예: GAT, GraphSAGE)과 결합했을 때의 효과는 미탐색이다.

- AMP는 다중 홉 전파와 평균 프로토타입에 의존하므로, 클래스 간 구조적 유사성이 높은 경우 혼동이 발생할 가능성이 있다. 이를 완화하기 위한 프로토타입 정규화 혹은 메타‑학습 기반 보강이 향후 연구 방향이다.

전반적으로 TAAM은 “작업‑전용 경량 모듈 + 다중 스케일 프로토타입”이라는 새로운 설계 패러다임을 제시함으로써, replay‑free 그래프 연속 학습에서 안정성과 가소성을 동시에 달성한 점이 가장 큰 공헌이다.

댓글 및 학술 토론

Loading comments...

의견 남기기