KV 캐시 압축을 위한 잔차 기반 장거리 유사성 활용

초록

**

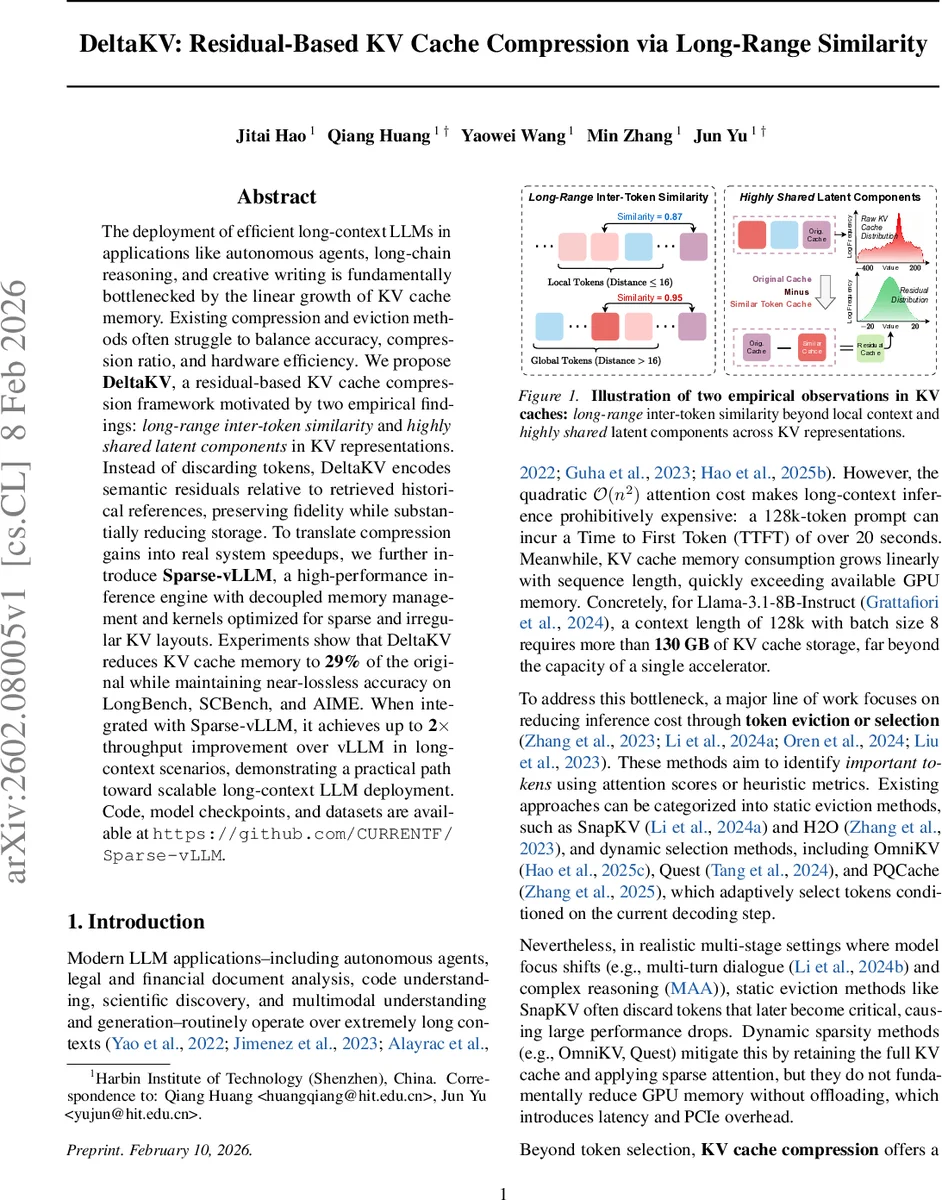

DeltaKV는 장거리 토큰 간 유사성과 KV 표현의 공유 잠재 성분을 이용해 KV 캐시를 잔차 형태로 압축한다. 스트라이드 기반 참조 토큰을 선택하고, 평균값을 빼는 방식으로 남은 잔차만을 경량 MLP 혹은 선형 변환으로 인코딩한다. 압축된 캐시는 Sparse‑vLLM 엔진에서 비정형 메모리 레이아웃을 지원하는 커스텀 커널로 빠르게 복원·읽기되며, 기존 방법 대비 메모리 사용량을 29 % 수준으로 감소시키고, 긴 컨텍스트(>100k 토큰)에서 최대 2배의 처리량 향상을 달성한다.

**

상세 분석

**

본 논문은 대규모 언어 모델(LLM)의 장거리 추론 시 KV 캐시 메모리 사용량이 선형적으로 증가한다는 근본적인 병목을 해결하고자 한다. 기존의 토큰 삭제·선택 기반 방법은 중요한 토큰을 과도하게 버리거나, 전체 KV를 유지하면서도 메모리 오프로드에 의존해 PCIe 대역폭을 소모한다는 한계가 있다. 저자들은 먼저 KV 캐시 자체를 분석하여 두 가지 핵심 현상을 발견한다. 첫째, “장거리 토큰 유사성”이다. 코사인 유사도가 0.9 이상인 토큰 쌍의 60 % 이상이 16 토큰 이상 떨어져 있어, 유사 토큰이 반드시 인접에 존재하지 않는다. 이는 로컬 기반 압축 기법이 포착하지 못하는 전역적인 중복성을 의미한다. 둘째, “공유 잠재 성분”이다. SVD 분석 결과 KV 행렬의 스펙트럼이 급격히 감소하며, 소수의 고노름 방향이 전체 토큰에 공통적으로 존재한다는 것이 확인된다. 이러한 고차원 성분을 제거하면 남는 잔차는 L2 노름이 크게 감소하고, 값 분포가 0 주변에 집중되는 저에너지 신호가 된다.

DeltaKV는 이러한 관찰을 바탕으로 설계되었다. 전체 KV를 직접 압축하는 대신, 스트라이드(s) 간격으로 선택된 참조 토큰 집합 T를 유지한다. 현재 토큰 i에 대해 T에서 L2 거리 기준 top‑k 가장 유사한 토큰 R_i를 검색하고, 그 평균 KV_R을 계산한다. 이후 KV_i와 KV_R을 각각 동일한 MLP f_c 로 투영한 뒤 차이를 취해 잔차 z_Δ를 얻는다. 압축 단계는 f_c와 f_d(디코더) 두 개의 경량 네트워크만 필요하므로 GPU에서 완전 병렬화가 가능하고, 파라미터 오버헤드도 전체 모델 파라미터의 5 % 미만에 불과하다. 디코더 f_d는 MLP 버전과 선형 버전 두 가지를 제공해 정확도와 지연시간 사이의 트레이드오프를 조절한다.

시스템 차원에서는 Sparse‑vLLM이라는 새로운 추론 엔진을 제시한다. 기존 vLLM은 페이지 단위 KV 관리와 연속 메모리 레이아웃을 전제로 최적화돼 있었지만, DeltaKV가 생성하는 비정형(희소·불규칙) KV 구조를 효율적으로 처리하지 못한다. Sparse‑vLLM은 메모리 관리와 연산 커널을 분리하고, 압축된 잔차와 참조 평균을 각각 별도 버퍼에 저장한다. 필요 시 선택된 토큰만 복원해 연산에 투입함으로써 메모리 대역폭 사용을 최소화하고, GPU 코어 활용도를 높인다.

실험에서는 Llama‑3.1‑8B‑Instruct와 Qwen2.5‑7B‑Instruct를 대상으로 LongBench, SCBench, AIME 등 장거리 추론 벤치마크에서 정확도 손실을 0.1 % 이하로 유지하면서 KV 메모리를 29 % 수준으로 축소했다. 또한 128k 토큰 컨텍스트와 배치 8 환경에서 Sparse‑vLLM과 DeltaKV를 결합했을 때, 기존 vLLM 대비 최대 2×의 처리량 향상을 기록했다. 압축·복원 연산에 소요되는 추가 연산량은 전체 추론 시간의 5 % 미만에 불과했으며, 메모리 사용량 감소에 따른 배치 크기 확대 효과도 확인되었다.

본 연구는 “전역적 유사성 + 공유 잠재 성분”이라는 두 축을 활용해 KV 캐시를 효율적으로 압축하고, 이를 실제 서비스 수준 추론 엔진에 통합함으로써 장거리 LLM 배포의 실용적 경로를 제시한다. 향후 연구에서는 압축률을 더욱 높이기 위한 다중 단계 잔차 압축, 토큰별 가변 압축 차원, 그리고 멀티모달 모델에 대한 적용 가능성을 탐색할 여지가 있다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기