VLM이 프라이버시 속성을 얼마나 정확히 인식하는가

초록

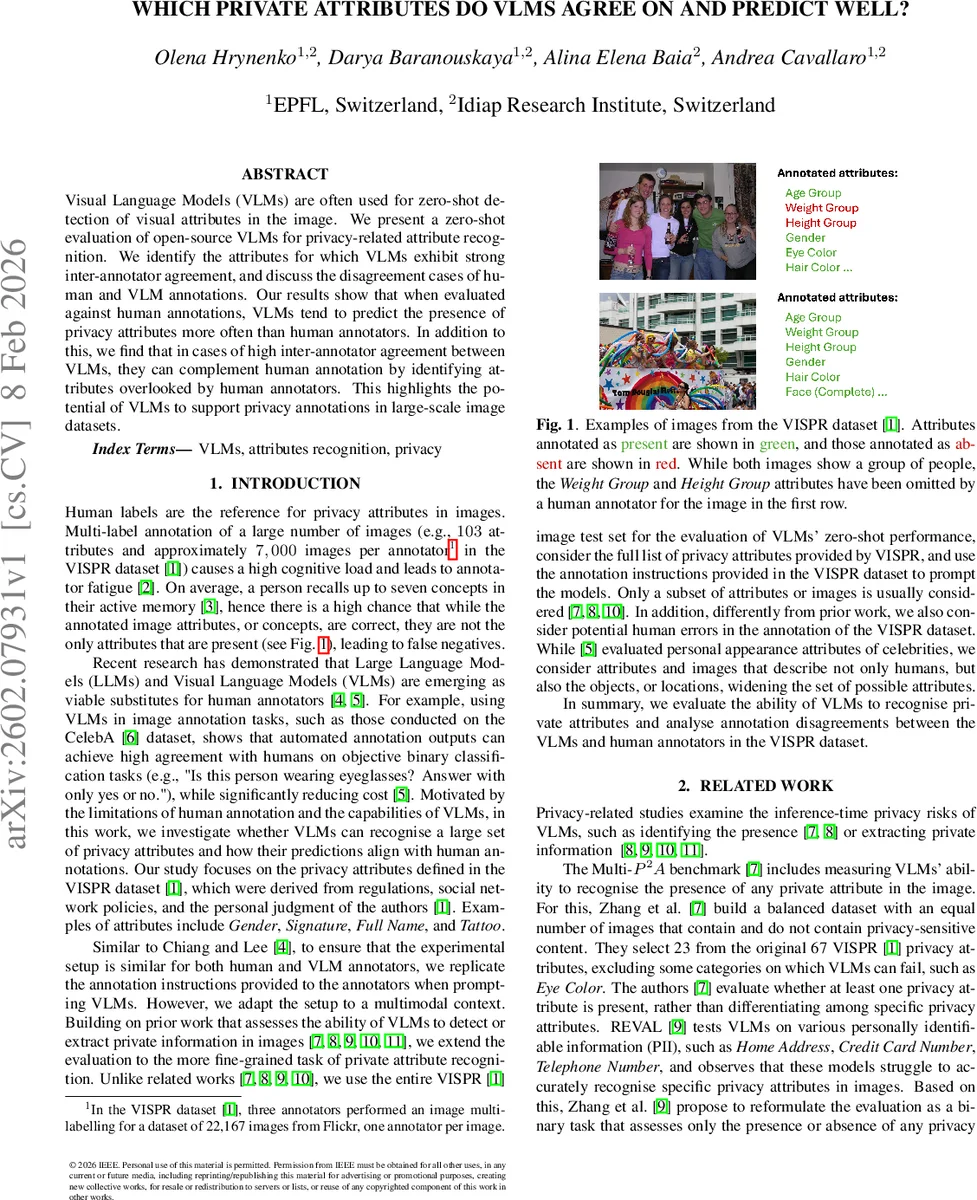

본 연구는 VISPR 데이터셋의 67개 프라이버시 속성을 대상으로 세 가지 오픈소스 비주얼‑언어 모델(Gemma‑3‑4b‑it, Qwen2.5‑VL‑7B‑Instruct, Llama‑3.2‑11B‑Vision‑Instruct)의 제로샷 성능을 평가한다. 모델 간 합의도가 높은 속성(예: Age Group, Gender, Hair Color 등)에서는 인간 annotator가 놓친 경우가 많으며, 특히 Qwen2.5‑VL‑7B‑Instruct가 가장 높은 F1‑macro 점수를 기록한다.

상세 분석

이 논문은 프라이버시 민감 속성 인식을 위한 기존 연구가 제한된 속성 집합에 머물렀던 점을 보완하고자, VISPR 데이터셋 전체 67개 속성을 대상으로 제로샷 평가를 수행한다. 실험에 사용된 세 모델은 모두 instruction‑following 형태이며, 이미지당 67개의 프롬프트를 순차적으로 입력해 “Present” 혹은 “Absent”를 답하게 한다. 모델의 자유형 응답을 closed‑set 라벨로 변환하기 위해 동일 모델을 활용한 2단계 파싱 방식을 적용했으며, NONE 라벨을 도입해 답변이 모호한 경우를 구분한다.

성능 분석에서는 balanced accuracy가 0.75 이상인 경우가 다수였지만, 특히 “Present” 클래스의 precision이 낮아 false positive가 빈번함을 확인한다. 이는 인간 annotator가 7개의 속성을 동시에 기억해야 하는 인지 부하로 인해 일부 속성을 누락했을 가능성을 시사한다. 실제로 Fleiss‑kappa가 0.580.69 사이로 높은 속성들(Age Group, Gender, Hair Color, Spectators, Face(Partial))에 대해 VLM이 “Present”라고 판단했을 때 인간이 “Absent”로 라벨링한 이미지 중 1070%가 다른 인간‑정의 속성(예: 얼굴 전체, 인종, 피부색 등)이 동시에 존재함을 발견했다. 이는 VLM이 인간이 놓친 세부 정보를 포착할 수 있음을 의미한다.

모델별 비교에서는 Qwen2.5‑VL‑7B‑Instruct가 가장 높은 F1‑macro(0.6 이상)와 balanced accuracy를 보이며, 전체 67개 속성 중 64개에서 가장 높은 점수를 기록했다. 반면 Gemma‑3‑4b‑it와 Llama‑3.2‑11B‑Vision‑Instruct는 precision 저하로 인해 F1‑macro가 0.4~0.6 수준에 머물렀다.

또한, 인간‑VLM 불일치 사례를 정량·정성적으로 분석했는데, Age Group, Gender, Hair Color와 같은 “인간 정의” 속성에서는 VLM이 “Present”라고 판단한 이미지 중 약 30%가 최소 6개의 다른 인간‑정의 속성을 포함하고 있었다. Spectators 속성에서는 관계‑정의 속성(Personal Relationships, Social Circle 등)이 56% 이상 동시 존재했으며, Face(Partial)에서는 얼굴‑정의 속성이 59% 이상 포함돼 VLM이 부분 얼굴을 정확히 감지했을 가능성을 보여준다.

결론적으로, VLM은 특히 인간이 높은 인지 부하로 인해 놓치기 쉬운 프라이버시 속성을 보완할 수 있는 잠재력을 가지고 있다. 다만, “Present” 클래스에서의 낮은 precision은 모델이 과도하게 속성을 추정하는 경향을 나타내므로, 실제 적용 시 후처리나 인간‑모델 협업 전략이 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기