메드코그: 메타인지로 의료 LLM 추론 효율 극대화

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

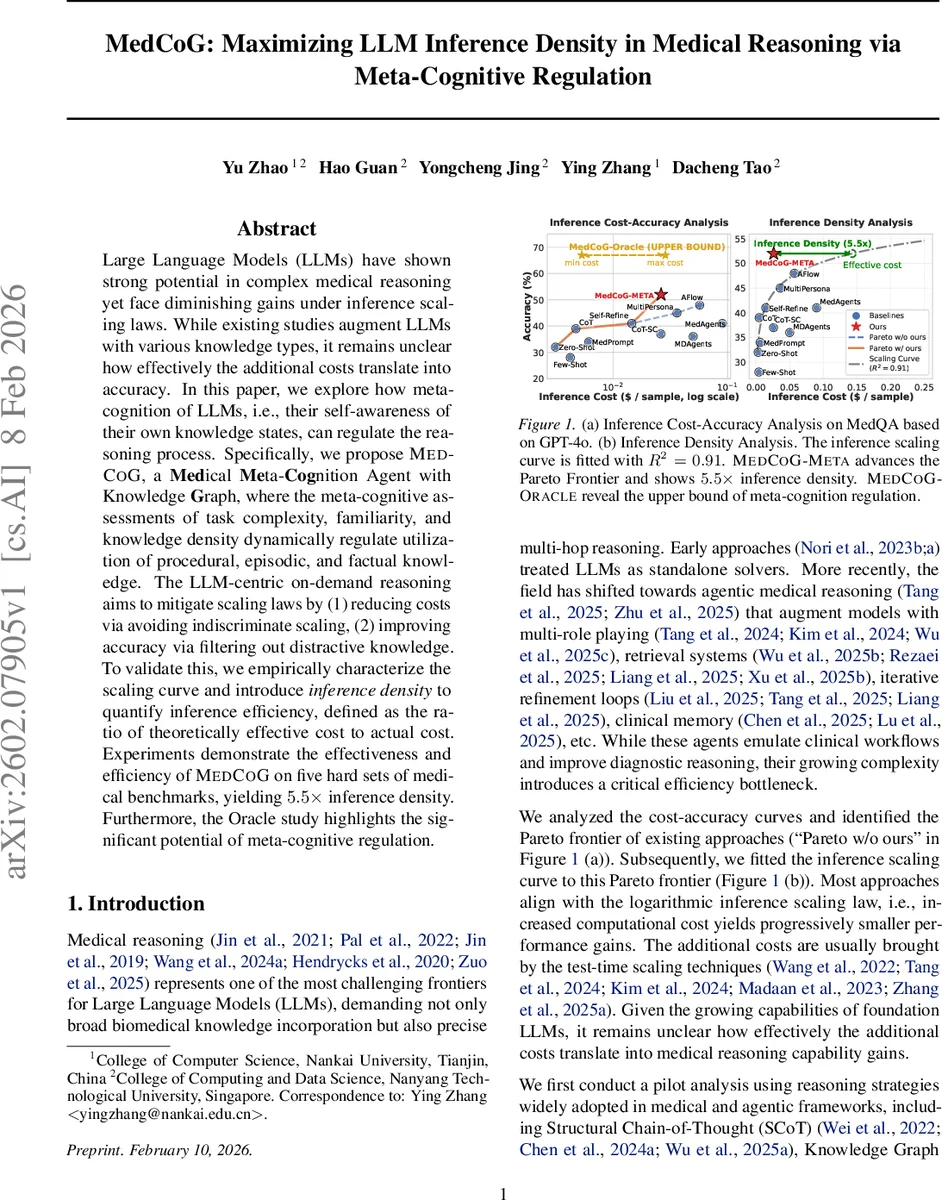

본 논문은 의료 질문에 대해 대형 언어 모델(LLM)의 메타인지 능력을 활용해, 복잡도·친숙도·지식밀도라는 세 가지 자가 평가 지표를 기반으로 절차적, 경험적, 사실적 지식을 동적으로 선택·조합한다. 이를 통해 불필요한 연산을 배제하고 정확도를 높이며, “추론 밀도(Inference Density)”라는 새로운 효율 지표에서 5.5배 향상을 달성한다.

상세 분석

메드코그(MedCoG)는 의료 분야에서 LLM이 직면하는 “추론 비용‑성능 감소”라는 스케일링 법칙을 메타인지 기반 규제로 완화하려는 시도이다. 핵심 아이디어는 LLM이 스스로 자신의 지식 상태를 평가하고, 그 결과에 따라 적절한 지식 소스를 선택하도록 하는 것이다. 구체적으로 복잡도(Complexity), 친숙도(Familiarity), 지식밀도(Knowledge Density)라는 3차원 메타인지 상태 벡터 s =

댓글 및 학술 토론

Loading comments...

의견 남기기