시각 근거 기반 체인오브생각 신뢰성 진단 벤치마크

초록

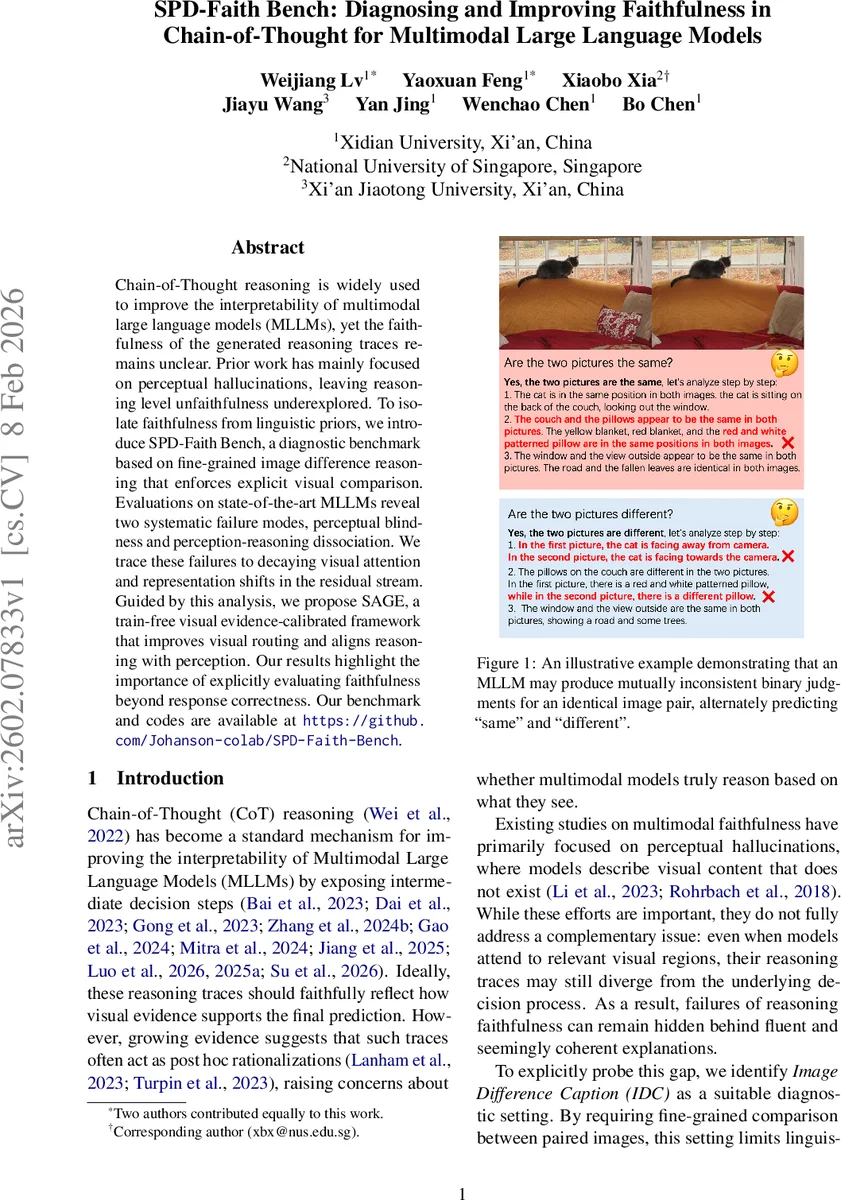

본 논문은 멀티모달 대형 언어 모델(MLLM)의 체인오브생각(CoT) 추론 과정에서 시각적 근거와의 일치성을 평가하기 위해, 미세한 이미지 차이를 이용한 SPD‑Faith Bench라는 진단 벤치마크를 제시한다. 3,000개의 이미지 쌍을 난이도별로 구성하고, 전역 인식, 세밀 인식, 추론 일관성 등 6가지 메트릭을 도입해 12개 모델을 평가한다. 실험 결과 ‘시각적 맹목’과 ‘인식‑추론 분리’라는 두 가지 실패 모드가 발견되었으며, 이는 시각 어텐션 감소와 잔차 스트림 표현 이동에 기인한다. 이를 해결하기 위해 시각 근거를 캘리브레이션하는 무학습 프레임워크 SAGE를 제안하고, 전반적인 신뢰성 향상을 입증한다.

상세 분석

SPD‑Faith Bench는 기존 이미지 차이 이해 데이터셋(CLEVR‑Change, Spot‑the‑Diff 등)과 달리, “이미지 차이 캡션(IDC)” 작업을 핵심 설계 목표로 삼아 시각적 근거와 언어적 추론을 명확히 분리한다. 데이터 구축 파이프라인은 (1) 다양한 실세계 이미지 수집 → (2) GPT‑4o가 설계한 원자적 편집(색상 변환, 객체 제거, 위치 이동) → (3) LaMa 인페인팅으로 실제 이미지 변형을 수행하고, 인간 검증을 통해 정답 라벨을 확보하는 3단계로 이루어진다. 결과적으로 단일 차이와 다중 차이(2~5개) 쌍을 각각 Easy/Medium/Hard 난이도로 구분한 3,000쌍을 제공한다.

평가 프레임워크는 전역 인식(Difference Sensitivity, Difference Quantity Recall), 세밀 인식(Type‑Level F1, Category‑Level F1), 추론 일관성(Contradiction Rate, Difference Reasoning Faithfulness)이라는 6가지 지표를 정의한다. 전역 인식은 모델이 “차이가 존재한다”는 사실을 감지하는 능력을, 세밀 인식은 차이의 구체적 유형과 객체를 정확히 식별하는지를 측정한다. 추론 일관성은 동일 이미지 쌍에 대해 “같다/다르다” 질문에 모순된 답변을 내는 비율(CR)과, 차이 설명이 실제 시각적 근거와 얼마나 일치하는지를 나타내는 DRF를 포함한다.

12개 모델(GPT‑4o, Claude‑4.5‑Haiku, Gemini‑2.5‑Pro 등) 평가 결과, 대부분의 최신 MLLM이 전역 인식에서는 80% 이상 높은 DS를 보였지만, 세밀 인식과 추론 일관성에서는 현저히 낮은 점수를 기록했다. 특히 ‘시각적 맹목(perceptual blindness)’은 모델이 차이 영역을 어텐션에서 놓치면서 발생했으며, 시각 어텐션이 추론 단계가 진행될수록 점진적으로 감소하는 현상이 관찰되었다. ‘인식‑추론 분리(perception‑reasoning dissociation)’는 모델이 차이를 정확히 감지했음에도 불구하고, CoT 단계에서 그 근거를 무시하고 언어적 패턴에 의존해 잘못된 설명을 생성하는 경우를 말한다. 이러한 현상은 잔차 스트림(residual stream)에서 시각 토큰의 표현이 점차 희석되고, 텍스트 토큰이 우세해지는 현상으로 분석되었다.

이를 해결하기 위해 제안된 SAGE(Visual Evidence‑Calibrated Framework)는 두 단계로 구성된다. 첫째, “시각 라우팅 강화” 단계에서 이미지 토큰에 대한 어텐션 가중치를 사후 보정하여 추론 단계 전까지 시각 정보가 유지되도록 한다. 둘째, “증거 캘리브레이션” 단계에서는 모델이 생성한 CoT 내에 포함된 차이 설명을 자동으로 추출하고, 해당 설명이 실제 이미지 차이와 일치하는지를 검증하는 후처리 모듈을 적용한다. SAGE는 추가 학습 없이 기존 모델에 플러그인 형태로 삽입 가능하며, 실험에서는 전반적인 DRF를 평균 12%p 상승시키고, CR을 30% 이상 감소시키는 효과를 보였다.

이 논문의 주요 기여는 (1) 시각‑언어 모델의 추론 신뢰성을 정량화할 수 있는 새로운 벤치마크와 메트릭을 제공, (2) 최신 MLLM이 겪는 두 가지 근본적인 실패 모드를 메커니즘 수준에서 규명, (3) 무학습 방식의 SAGE를 통해 시각 라우팅과 추론 일관성을 동시에 개선한 실용적 솔루션을 제시했다는 점이다. 향후 연구는 더 복잡한 시나리오(다중 객체 상호작용, 시간적 변화)와 인간‑모델 협업을 통한 신뢰성 향상 방안을 탐색할 여지를 남긴다.

댓글 및 학술 토론

Loading comments...

의견 남기기