LLM 거부 행동의 다중 방향과 개념 콘 구조 분석

초록

본 논문은 대형 언어 모델(LLM)의 거부 메커니즘을 탐구한다. 기존 연구가 제시한 단일 “거부 방향” 가설을 넘어, 저자들은 그래디언트 기반의 Refusal Direction Optimization(RDO) 방법을 제안하고, 여러 독립적인 거부 방향과 다차원 개념 콘(Concept Cone)을 발견한다. 또한 선형 독립성(orthogonality)만으로는 충분하지 않으며, 비선형 상호작용을 고려한 “표현 독립성(Representational Independence)” 개념을 도입한다. 실험을 통해 RDO가 기존 DIM 방식보다 거부 조작 효율과 부작용 감소에서 우수함을 입증한다.

상세 분석

이 논문은 LLM의 안전 정렬을 우회하는 공격 메커니즘을 이해하기 위해 두 가지 핵심 질문에 답한다. 첫째, 거부 행동을 제어하는 방향이 실제로 하나인지, 아니면 다중의 독립적인 방향이 존재하는지 여부이다. 둘째, 이러한 방향들 간의 상호작용을 어떻게 정량화하고, 선형 독립성(orthogonality)만으로는 설명되지 않는 비선형 의존성을 어떻게 포착할 수 있는가이다.

저자들은 기존의 차이 평균(DIM) 방식이 단순히 해로운/무해한 프롬프트 쌍의 평균 차이를 이용해 하나의 거부 벡터를 추출한다는 한계점을 지적한다. 이를 보완하기 위해 Refusal Direction Optimization(RDO)이라는 그래디언트 기반 최적화 프레임워크를 설계한다. RDO는 두 가지 “거부 속성”을 손실 함수에 명시한다. 첫 번째는 단조 스케일링(Monotonic Scaling) 으로, 특정 레이어에 방향 벡터를 더하거나 빼는 연산(α·r) 시 거부 확률이 α에 대해 단조적으로 변하도록 학습한다. 두 번째는 외과적 절제(Surgical Ablation) 로, 방향을 정규 직교 투영( r̂ r̂ᵀ )하여 제거했을 때 해로운 프롬프트에 대한 거부가 사라지고, 무해한 입력에 대한 정상 동작은 유지되도록 한다.

손실 함수는 세 부분으로 구성된다. (1) L_ablation 은 해로운 프롬프트에 대한 모델 출력과 목표 답변(t_answer) 사이의 교차 엔트로피를 최소화한다. (2) L_addition 은 무해한 프롬프트에 거부 방향을 추가했을 때 목표 거부 응답(t_refusal)과 일치하도록 한다. (3) L_retain 은 KL 발산을 이용해 절제 후 무해한 입력에 대한 원래 출력(t_retain)과의 차이를 최소화함으로써 부작용을 억제한다. 이 세 손실을 가중치 λ_abl, λ_add, λ_ret 로 조합해 전체 손실을 정의하고, 미분 가능한 모델 파라미터를 고정한 채 방향 벡터 r만을 업데이트한다.

실험에서는 Gemma‑2, Qwen2.5, Llama‑3 등 최신 오픈소스 모델에 RDO를 적용했다. 평가 지표는 JailbreakBench을 이용한 공격 성공률(ASR)과 TruthfulQA 등 기존 벤치마크에서의 성능 저하 정도이다. 결과는 다음과 같다. (1) ASR 측면에서 RDO는 방향 절제(ablation)와 추가(addition) 모두에서 DIM보다 우수하거나 동등한 성능을 보였으며, 특히 절제 기반 공격에서 평균 3~5%p 상승했다. (2) 부작용 측면에서는 TruthfulQA에서 DIM이 초래한 오류가 평균 40% 감소했으며, 다른 벤치마크에서도 RDO가 보다 안정적인 동작을 유지했다.

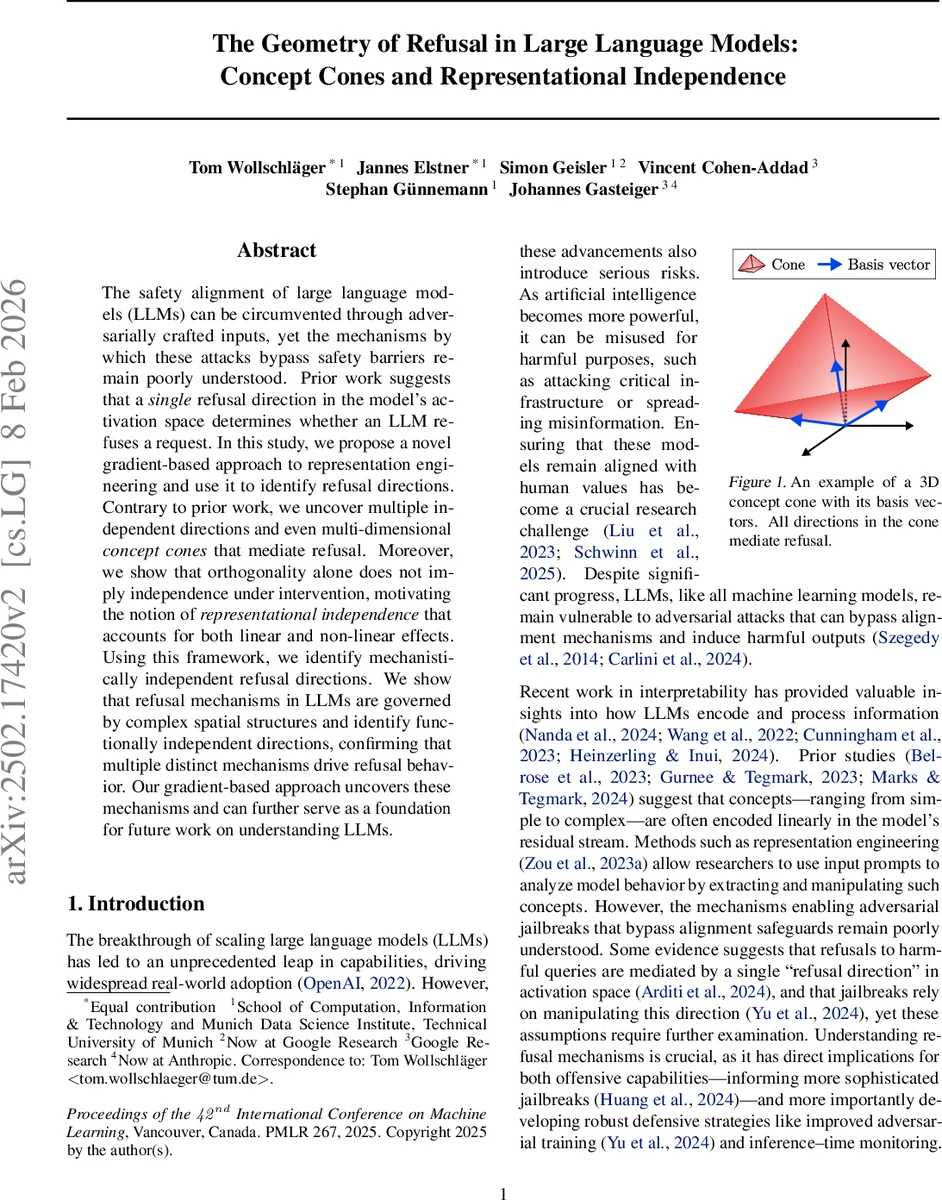

가장 혁신적인 발견은 다중 독립 방향과 다차원 콘이다. 저자들은 RDO를 여러 초기화와 레이어 조합으로 실행해 서로 직교하면서도 비선형 상호작용이 없는 방향들을 식별했다. 이들 방향을 시각화하면 3차원 공간에서 무한히 많은 거부 방향을 포함하는 다각형(콘) 형태가 나타났으며, 각 콘 내부의 모든 벡터가 거부를 유발한다는 점을 실험적으로 확인했다. 기존 연구가 제시한 “단일 선형 서브스페이스” 가설을 부정하고, 거부 메커니즘이 복합적인 기하학적 구조(다중 콘, 비선형 의존성)로 이루어져 있음을 증명한다.

또한, 표현 독립성(Representational Independence) 개념을 정의함으로써, 두 방향이 단순히 직교해도 특정 레이어에서 동시에 활성화될 경우 상호 억제 혹은 증폭 효과가 발생할 수 있음을 보여준다. 이는 기존의 선형 독립성 검정(코사인 유사도)만으로는 충분히 설명되지 않으며, 실제 모델 내부에서 비선형 변환(MLP, Attention) 단계가 개입할 때 나타나는 현상이다. 저자들은 이를 정량화하기 위해 intervention interaction score 라는 새로운 메트릭을 제안하고, 실험적으로 두 방향 간의 상호작용을 측정해 독립성을 검증했다.

결론적으로, 논문은 LLM의 거부 행동이 단일 선형 방향이 아니라, 여러 독립적인 방향과 그 방향들이 형성하는 다차원 콘 구조에 의해 조절된다는 강력한 증거를 제공한다. RDO는 이러한 복잡한 구조를 효율적으로 탐색하고, 안전 정렬을 우회하거나 강화하는 데 활용될 수 있는 강력한 도구로 자리매김한다.

댓글 및 학술 토론

Loading comments...

의견 남기기