모델 내면 탐색으로 강화학습 플래닝 효율화

초록

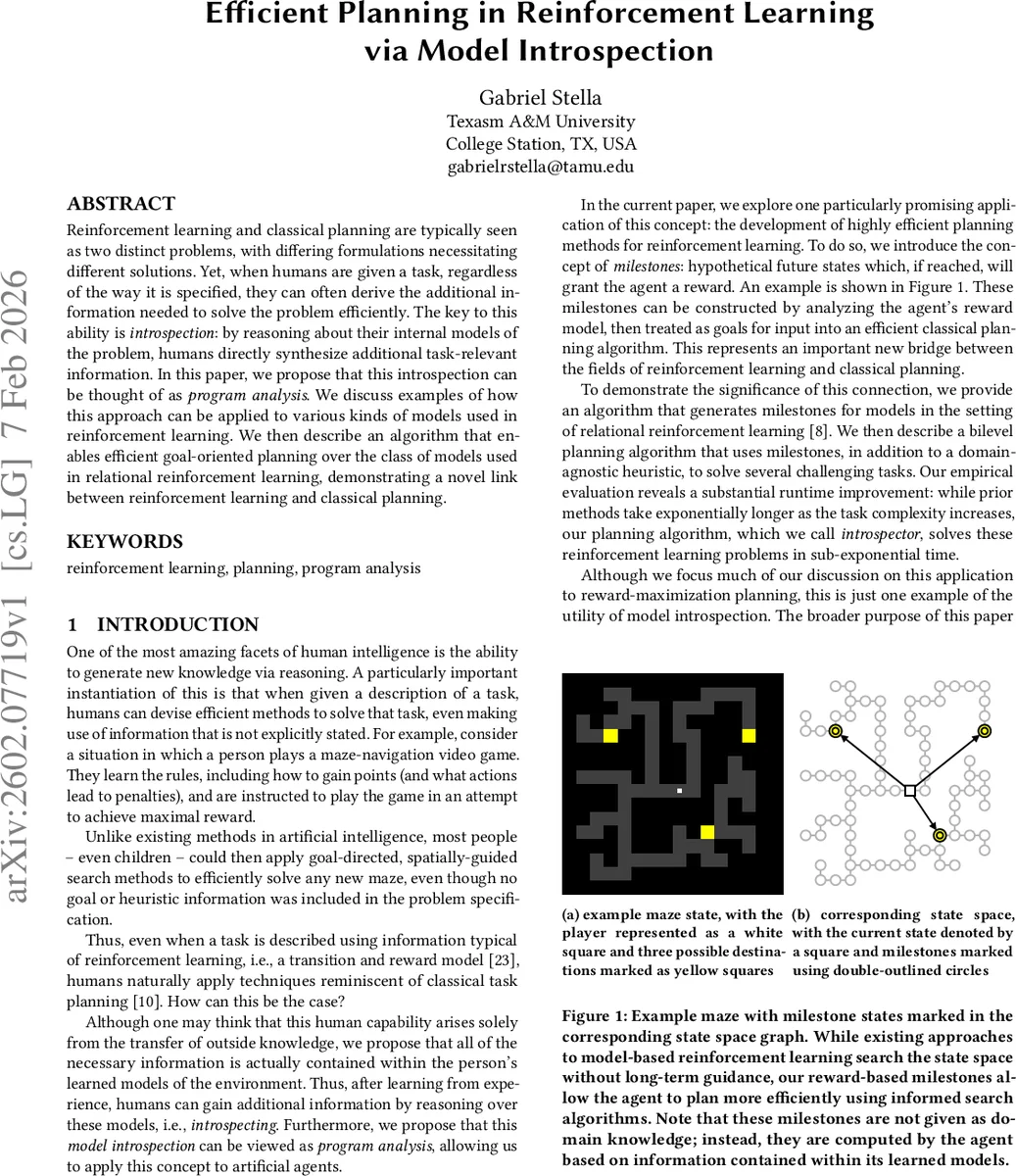

이 논문은 인간이 과제 수행 시 내부 모델을 스스로 분석해 추가 정보를 도출하는 ‘내면 탐색(introspection)’을 프로그램 분석으로 형식화한다. 강화학습에서 학습된 전이·보상 모델을 정형화된 프로그램으로 보고, 보상 최대화를 위한 가상의 중간 목표인 ‘마일스톤(milestone)’을 자동 생성한다. 생성된 마일스톤을 목표 상태로 삼아 고전 계획 알고리즘(A* 등)을 적용함으로써, 기존 모델 기반 강화학습 플래닝이 겪는 탐색 비용 폭증 문제를 완화한다. 특히 관계형 강화학습(relational RL) 모델에 특화된 마일스톤 생성 알고리즘과 이중 레벨(bilevel) 플래닝 프레임워크를 제안하고, 실험을 통해 지수적 시간 복잡도에서 준지수적(sub‑exponential) 시간으로 개선함을 입증한다.

상세 분석

본 연구는 인간이 과제에 대한 명시적 목표가 없더라도 내부 모델을 분석해 목표‑유도 정보를 추출하는 능력을 ‘프로그램 분석(program analysis)’이라는 형식적 개념으로 전환한다. 강화학습 에이전트가 학습한 전이 모델 ˆT와 보상 모델 ˆR을 일반적인 프로그래밍 언어의 함수 혹은 절차로 간주하고, 정적·동적 분석 기법을 적용해 보상 구조를 파악한다. 핵심 아이디어는 ‘마일스톤’이라는 가상의 중간 상태를 정의하는데, 이는 보상 함수 R이 최대값 r_max를 반환하는 상태‑액션 쌍( s , a , g )를 의미한다(식 1, 2). 마일스톤은 기존 목표‑조건(goal)과 유사하지만, 외부에서 주어지는 것이 아니라 모델 내부에서 자동으로 도출된다.

논문은 관계형 강화학습(RRL) 환경을 주요 실험 대상으로 삼는다. RRL에서는 상태가 객체와 관계의 집합으로 표현되며, 전이·보상 모델이 논리‑프로그램 형태로 구현된다. 이러한 구조적 특성을 활용해 마일스톤을 효율적으로 탐색하는 알고리즘을 설계했으며, 이는 전통적인 플래닝에서 사용하는 휴리스틱 생성 방식과 유사하게 모델 자체에서 목표‑지향 정보를 추출한다는 점에서 혁신적이다.

제안된 이중 레벨(bilevel) 플래닝 프레임워크는 첫 번째 레벨에서 마일스톤 집합을 생성하고, 두 번째 레벨에서는 각 마일스톤을 목표 상태로 삼아 A*와 같은 휴리스틱 기반 탐색을 수행한다. 이때 사용되는 휴리스틱은 도메인‑불변(domain‑agnostic)이며, 전이 모델 ˆT만을 이용해 상태 간 거리 추정을 수행한다. 결과적으로 플래닝 과정은 ‘보상 기반 장거리 가이드’를 갖게 되어, 희소 보상 환경에서도 탐색이 효율적으로 진행된다.

실험에서는 기존 모델 기반 플래닝(값 반복, 베이즈 탐색, MCTS 등)과 비교해, 제안 알고리즘(Introspector)이 문제 복잡도가 증가함에 따라 지수적 시간 증가를 보이지 않고, 실제로는 준지수적 시간 복잡도를 보였다. 이는 마일스톤이 제공하는 장기 목표가 탐색 공간을 크게 축소시키는 효과를 입증한다.

한계점으로는 (1) 전이·보상 모델이 완전하고 결정론적이어야 한다는 가정, (2) 마일스톤 정의가 최대 보상 r_max에 의존해 보상 구조가 단순할 때 효과가 크다는 점, (3) 관계형 모델 외의 고차원 연속 상태 공간에서는 프로그램 형태의 모델링이 어려워 적용이 제한될 수 있다는 점을 들 수 있다. 향후 연구에서는 확률적 전이, 다중 보상 목표, 연속형 마일스톤 정의 등을 확장하고, 자동화된 프로그램 분석 도구와 결합해 일반적인 딥 RL 모델에도 적용 가능한 프레임워크로 발전시킬 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기