백프로파게이션 없이 스펙트럴 바이어스 탈피: 극초고속 암시적 신경표현을 위한 엘리먼트 학습기

초록

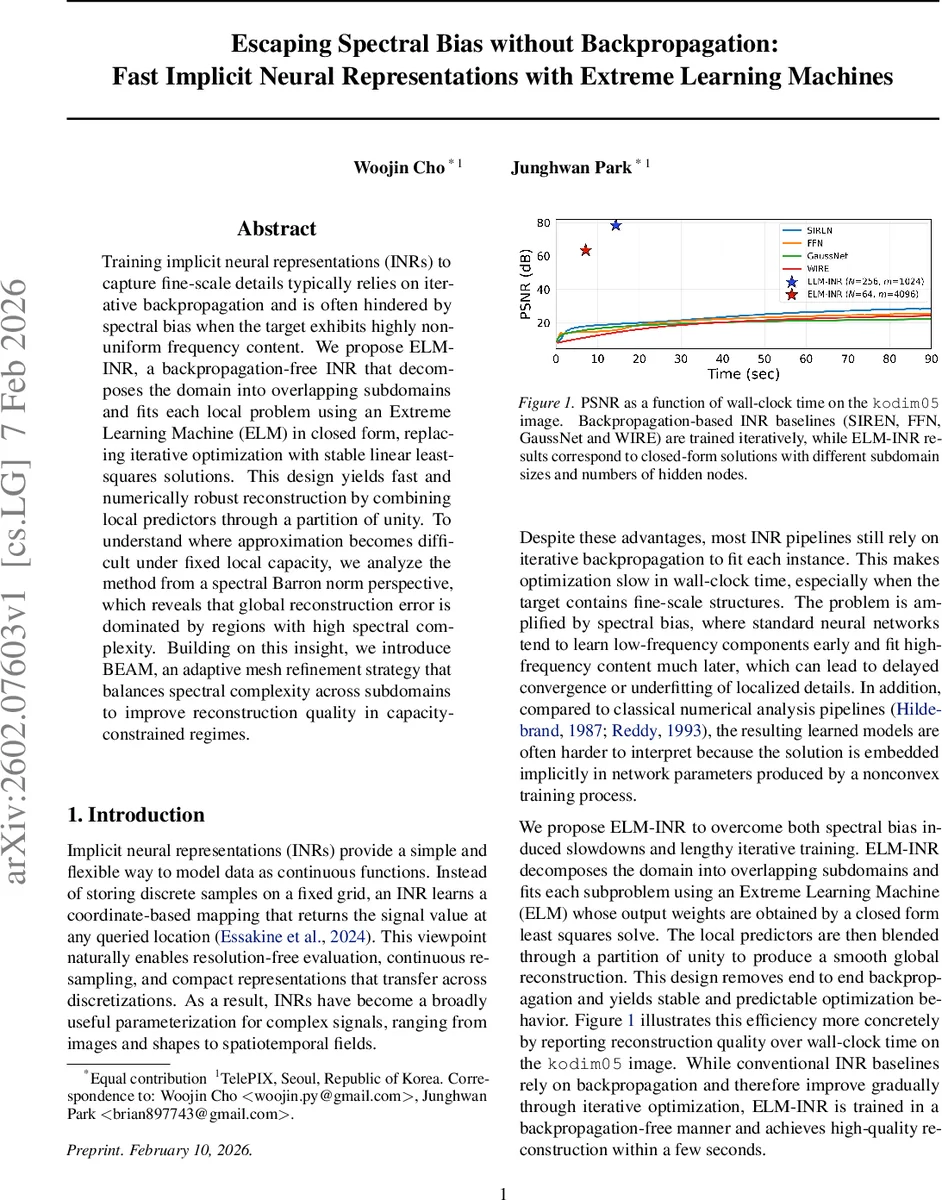

ELM‑INR은 도메인을 겹치는 서브도메인으로 분할하고, 각 서브문제를 Extreme Learning Machine(ELM)으로 닫힌 형태의 최소제곱 해를 구해 학습한다. 백프로파게이션을 전혀 사용하지 않아 빠른 수렴과 수치적 안정성을 제공한다. 또한 Barron 공간 분석을 통해 고주파 성분이 집중된 영역이 전체 오차를 좌우함을 밝혀내고, 이를 균등화하기 위한 적응형 메쉬 전략 BEAM을 제안한다.

상세 분석

본 논문은 암시적 신경표현(INR)의 대표적인 문제점인 스펙트럴 바이어스와 반복적인 역전파 학습의 고비용을 동시에 해결하고자 한다. 핵심 아이디어는 두 단계로 나뉜다. 첫 번째는 도메인 분할과 ELM 기반 로컬 근사이다. 겹치는 서브도메인 Ω_i 를 정의하고, 각 서브도메인에 대해 입력 가중치와 바이어스를 무작위로 고정한 뒤, 출력 가중치 α_i만을 최소제곱으로 구한다. 이 과정은 (H_iᵀH_i)⁻¹H_iᵀy_i 형태의 닫힌 해를 이용해 O(m³) 이하의 복잡도로 수행되며, 전통적인 SGD와 달리 지역 최소점에 빠지지 않는다. 두 번째는 Partition‑of‑Unity(PoU) 윈도우 ϕ_i를 이용해 로컬 모델을 부드럽게 블렌딩함으로써 전역 연속성을 확보한다. PoU는 ∑_i ϕ_i(x)=1을 만족하므로, 각 서브도메인의 근사 오차가 직접적으로 전역 오차에 영향을 미친다.

논문은 Barron 공간을 도입해 스펙트럴 복잡도를 정량화한다. Barron 노름 ‖f‖{BS}=∫‖ξ‖₁|F(ξ)|dξ는 고주파 에너지의 가중합으로, 이 값이 클수록 얕은 네트워크(또는 고정된 폭 m)로는 근사하기 어렵다. 정리 3.6에 따르면 L₂ 오차는 C·‖f‖{BS}/√m 으로 상한이 잡히며, 이는 서브도메인마다 동일한 폭 m을 사용했을 때 가장 큰 ‖f‖_{BS}를 가진 영역이 전체 오차를 지배한다는 의미다. 따라서 저자들은 “오차는 스펙트럴 복잡도에 의해 지배된다”는 직관을 수학적으로 증명하고, 이를 기반으로 BEAM(Barron‑Enhanced Adaptive Mesh) 알고리즘을 설계한다.

BEAM은 초기 원자 셀(s×s)로 시작해 각 셀의 근사 스펙트럴 에너지(이산 푸리에 기반 추정)를 계산한다. 에너지가 임계값 τ 이하인 셀을 인접 셀과 병합하면서 새로운 셀의 에너지가 τ를 초과하지 않도록 반복한다. 결과적으로 복잡도가 높은 영역은 작게 유지되고, 단순한 영역은 크게 합쳐져 전체적으로 ‖f‖_{BS}가 균등하게 분포한다. 이렇게 균형 잡힌 메쉬는 고정된 m에 대해 최악의 지역 오차를 최소화하므로, 용량 제한 상황에서 특히 효과적이다.

실험에서는 2D 이미지(kodim05), 다중 스펙트럼 위성 영상, Navier‑Stokes 시뮬레이션, ERA5 기후 데이터, MRI 등 다양한 도메인에 적용하였다. 동일한 하드웨어 환경에서 ELM‑INR은 기존 SIREN, FFN, GaussNet, WIRE 등 백프로파게이션 기반 INR보다 2배 이상 높은 PSNR을 달성하면서 학습 시간은 수초 수준으로 크게 단축된다. 특히 BEAM을 적용했을 때, 제한된 은닉 뉴런 수(m=256)에서도 균일한 메쉬 대비 1.5~2.0 dB의 PSNR 향상이 관찰되었다. 수치적 안정성 측면에서도 (H_iᵀH_i)⁻¹ 연산에 정규화 기법을 적용해 조건수를 낮추어, 잡음에 강인한 결과를 얻었다.

종합하면, 논문은 (1) 백프로파게이션 없이도 고품질 INR을 구현하는 새로운 프레임워크, (2) Barron 공간을 통한 스펙트럴 복잡도 분석으로 오차 병목을 이론적으로 규명, (3) 이를 실용적인 메쉬 적응 전략 BEAM으로 구체화함으로써 용량 제한 상황에서도 균형 잡힌 고해상도 재구성을 가능하게 한다는 세 가지 주요 공헌을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기