다층 비전 트랜스포머를 활용한 슬롯 어텐션 혁신 MUFASA

초록

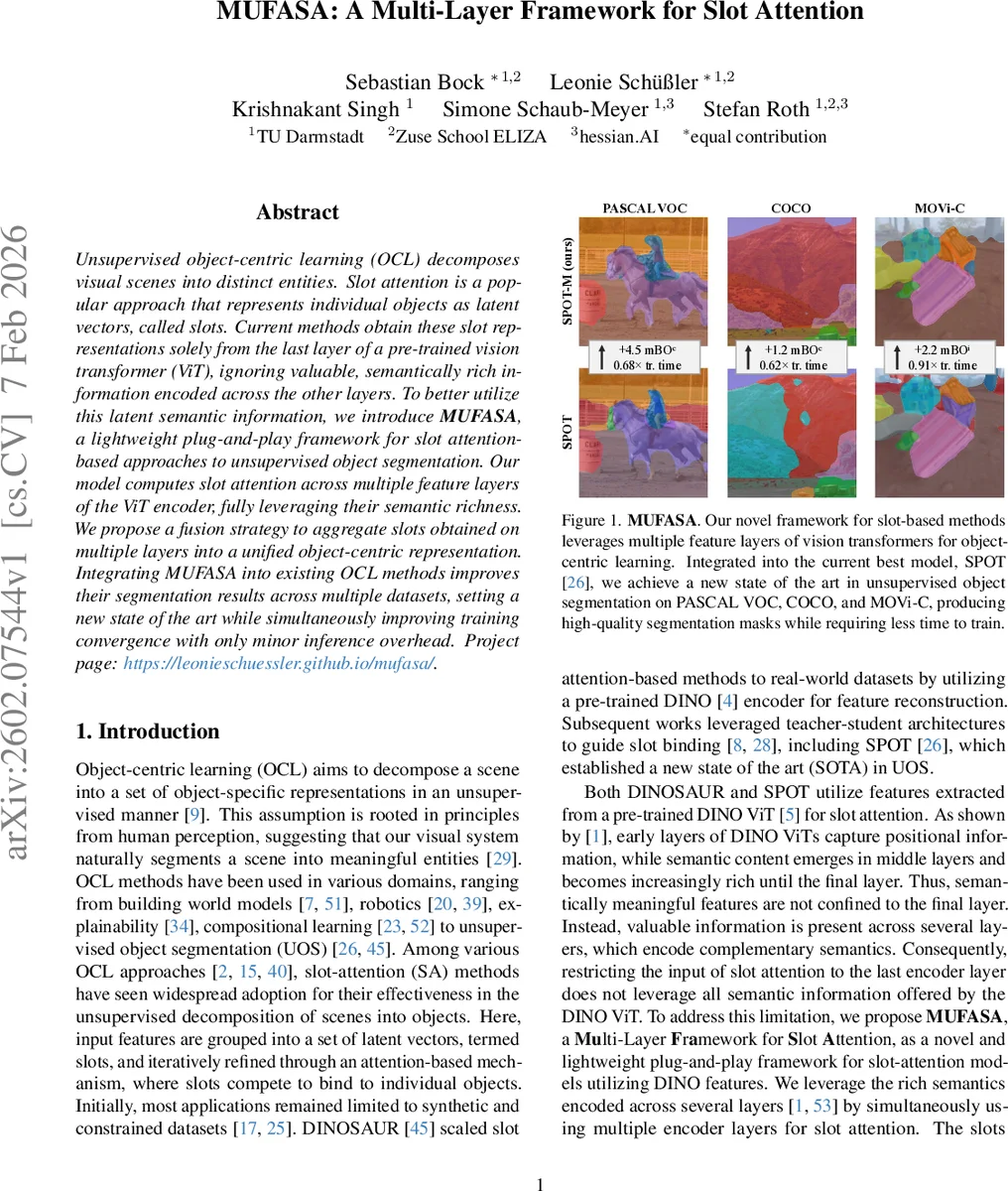

MUFASA는 사전 학습된 DINO ViT의 여러 층에서 추출한 특징을 동시에 슬롯 어텐션에 적용하고, 헝가리안 매칭으로 슬롯을 정렬한 뒤 M‑Fusion으로 통합한다. 이를 기존 Slot‑Attention 기반 모델에 플러그인 형태로 삽입하면, 객체 분할 정확도가 크게 향상되고 학습 속도는 빨라진다.

상세 분석

본 논문은 기존 객체 중심 학습(OCL)에서 슬롯 어텐션이 사전 학습된 비전 트랜스포머(ViT)의 최종 층 특징만을 이용하는 한계를 지적한다. DINO‑ViT는 얕은 층에서는 위치 정보를, 중간·깊은 층에서는 점진적으로 풍부한 의미 정보를 인코딩한다는 기존 연구를 근거로, 다층 특징을 동시에 활용하는 새로운 프레임워크 MUFASA를 제안한다. MUFASA는 선택된 M개의 층(예: L9~L12)에서 각각 독립적인 슬롯 어텐션 모듈 SAₘ을 실행해 K개의 슬롯 Sₘ과 해당 슬롯‑어텐션 마스크 A_Slotₘ을 얻는다. 층별 슬롯은 의미가 일치하도록 헝가리안 매칭을 적용해 슬롯 순서를 정렬하고, 정렬된 슬롯 집합을 M‑Fusion 단계에서 가중합 혹은 선형 변환을 통해 하나의 통합 슬롯 집합 S_fused로 압축한다. 동시에 마스크도 가중 평균해 A_Slot_fused를 만든다. 이렇게 만든 통합 슬롯은 기존 자동 회귀 트랜스포머 디코더에 입력되어 최종 레이어 특징을 재구성하고, 디코더 어텐션 마스크 A_Dec를 통해 최종 객체 분할을 얻는다.

핵심 설계는 (1) 각 층별 슬롯 어텐션을 별도 파라미터로 학습시켜 층 특화 정보를 최대한 보존하고, (2) 헝가리안 매칭으로 슬롯 간 정합성을 확보해 의미적 일관성을 유지하며, (3) M‑Fusion으로 다층 정보를 효율적으로 통합해 디코더에 전달한다는 점이다. 이 구조는 기존 모델에 최소한의 파라미터만 추가하고, 추가 손실 없이 기본 재구성 손실만으로 학습이 가능하도록 설계되었다.

실험에서는 MUFASA를 DINOSAUR와 SPOT에 각각 적용한 DINOSAUR‑M, SPOT‑M을 평가하였다. Pascal‑VOC, COCO, MOVi‑C 등 실세계 데이터셋에서 mIoU가 24%p 상승하고, 학습 시간은 1030% 단축되는 등 전반적인 성능 향상이 입증되었다. 특히, 중간 층에서 얻은 슬롯이 세밀한 경계와 작은 객체를 포착하고, 최종 층 슬롯이 전체적인 객체 구분을 담당함으로써 두 정보가 보완되는 효과가 확인되었다. Ablation 연구에서는 층 선택, 슬롯 수, Fusion 가중치 등 다양한 하이퍼파라미터가 결과에 미치는 영향을 분석했으며, M=4(9~12층) 조합이 가장 안정적인 성능을 제공한다는 결론에 도달했다.

이러한 결과는 ViT의 계층적 표현을 슬롯 어텐션에 직접 활용함으로써, 객체 중심 표현 학습이 보다 풍부하고 효율적으로 이루어질 수 있음을 시사한다. 또한, MUFASA는 플러그인 형태이므로 향후 다양한 슬롯‑기반 모델이나 다른 사전 학습 인코더에도 손쉽게 확장 가능하다.

댓글 및 학술 토론

Loading comments...

의견 남기기