구조적 추론으로 기능 차별화된 VLA 강화

초록

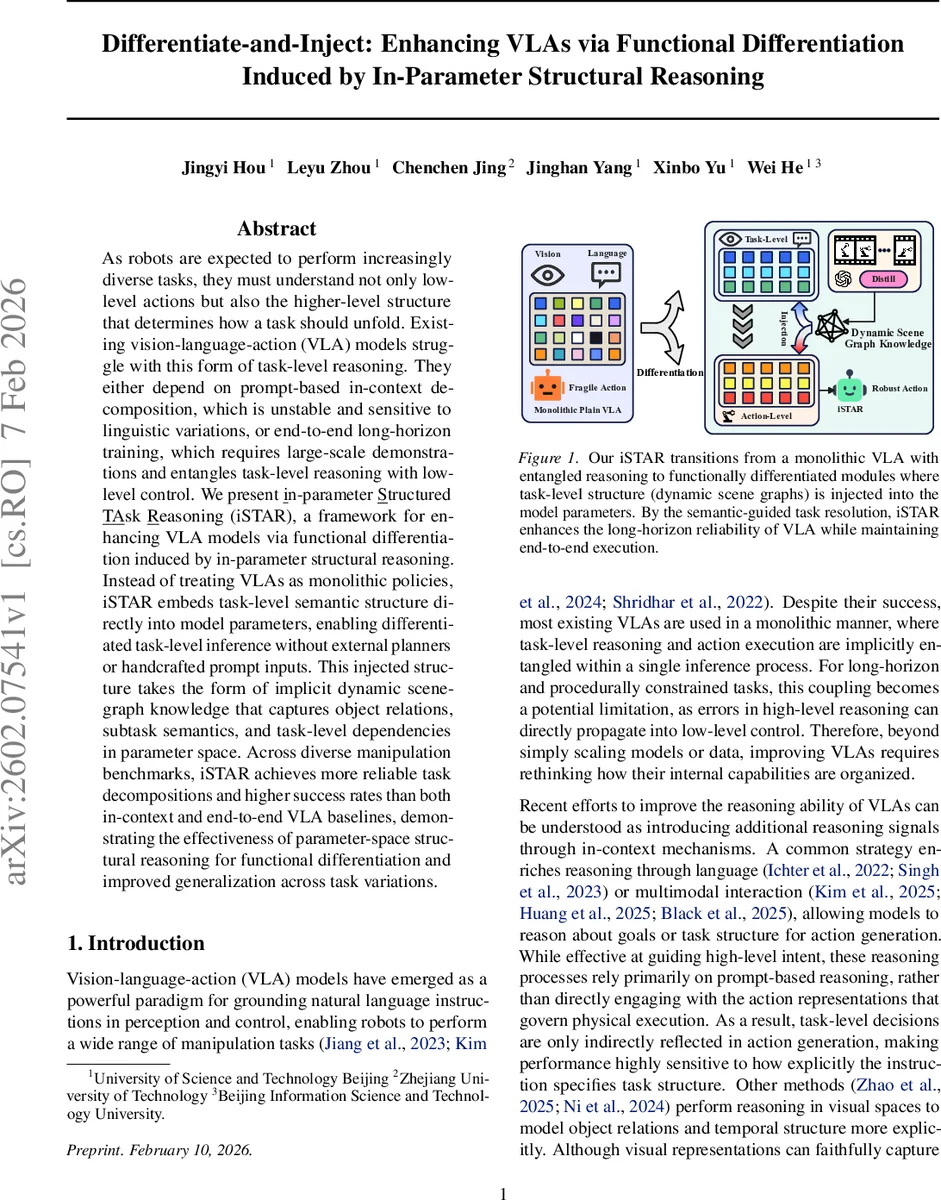

iSTAR는 비전‑언어‑액션 모델에 작업 수준의 의미 구조를 파라미터 공간에 직접 주입하여, 외부 플래너 없이도 단계별 서브프롬프트를 생성하고, 장기 조작 과제에서 더 높은 성공률과 일반화를 달성한다.

상세 분석

이 논문은 기존 VLA가 단일 정책으로 고수하면서 고수준 작업 추론과 저수준 제어가 뒤섞이는 문제점을 지적한다. 이를 해결하기 위해 저자들은 “in‑parameter structural reasoning”(iSTAR)이라는 프레임워크를 제안한다. iSTAR는 동일한 백본 모델을 두 개의 인스턴스로 복제하여 하나는 사전‑액션 모듈(pre‑action VLA)로서 객체·행동 개념을 추출하고, 다른 하나는 실제 액션 헤드에 연결돼 서브프롬프트에 조건화된 단기 행동을 생성한다. 핵심은 동적 암시적 컨셉 그래프이다. 개념 집합 V={v₁,…,v_N}에 대해 속성 게이트와 순서 게이트를 적용해 시간·관계 정보를 강조하고, 다중 헤드 어텐션을 통해 암시적 메시지 패싱을 수행한다. 그래프 학습 목표 L_struct는 현재 서브태스크와 개념 표현의 유사성을 최대화하고, 순서 게이트의 엔트로피를 정규화해 다양한 서브태스크 순서를 탐색하도록 설계되었다.

서브프롬프트 투사기는 구조화된 개념 표현을 언어 임베딩 공간으로 매핑해, downstream 액션 모듈이 긴 의미 추론 없이도 즉시 행동을 선택하도록 만든다. 데이터가 부족한 경우, 저자들은 대규모 비전‑언어 모델(VLM)으로부터 단계별 텍스트 설명을 자동 추출해 서브프롬프트 디스틸레이션을 수행한다. 이 과정은 별도 라벨링 없이도 서브태스크 수준의 의미 커밋을 학습하게 한다.

이론적으로는 구조화된 정책(그래프 → 서브프롬프트 → 행동)과 엔드‑투‑엔드 정책의 성능 차이를 ϵ_a, ϵ_r, ϵ_G 세 가지 오차 항으로 분해한다. iSTAR는 ϵ_a를 크게 감소시켜 장기 의존성을 최소화하고, ϵ_r와 ϵ_G를 그래프 학습과 디스틸레이션으로 보완한다. 실험에서는 VIMA‑Bench, ALFRED‑Manip 등 다양한 조작 벤치마크에서 iSTAR가 프롬프트 기반 방법과 기존 엔드‑투‑엔드 VLA보다 성공률·플랜 정확도·샘플 효율성에서 일관된 우위를 보였다.

결과적으로 iSTAR는 파라미터 공간에 작업 수준 구조를 내재화함으로써, 외부 플래너 없이도 기능적으로 차별화된 모듈을 구현하고, 복합적인 장기 조작 과제에서의 일반화 능력을 크게 향상시킨다.

댓글 및 학술 토론

Loading comments...

의견 남기기