LLM 기반 진단 근거 정렬로 의료 비전‑언어 사전학습 혁신

초록

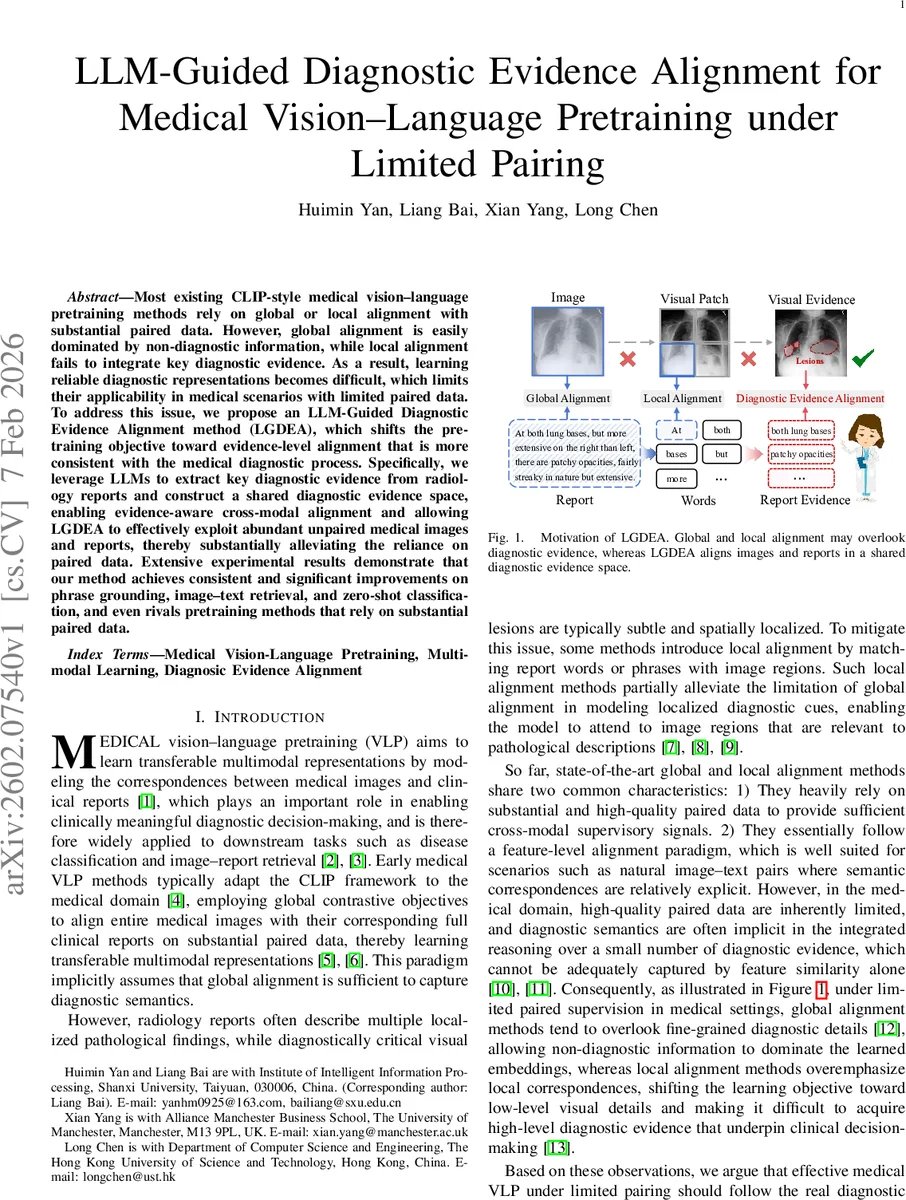

본 논문은 제한된 이미지‑보고서 쌍 데이터만으로도 효과적인 의료 비전‑언어 사전학습을 가능하게 하는 LLM‑Guided Diagnostic Evidence Alignment(LGDEA) 방법을 제안한다. 대형 언어 모델(LLM)을 활용해 방사선 보고서에서 핵심 진단 근거를 추출하고, 이를 공유 진단 근거 공간에 매핑한다. 이미지와 보고서는 각각 병변‑레벨 쿼리와 텍스트 근거를 이 공간에 정렬함으로써, 풍부한 비쌍 데이터까지 활용해 증거‑레벨 교차 모달 정렬을 수행한다. 실험 결과, 구문 정합(phrase grounding), 이미지‑텍스트 검색, 제로샷 분류 등에서 기존 글로벌·로컬 정렬 방식보다 일관되게 우수한 성능을 보이며, 대규모 쌍 데이터에 의존하는 기존 방법을 능가한다.

상세 분석

LGDEA는 의료 영상‑텍스트 사전학습에서 “진단 근거 수준” 정렬이라는 새로운 패러다임을 도입한다. 기존 CLIP‑style 접근법은 전체 이미지와 전체 보고서를 글로벌하게 대비하거나, 단어‑레벨 혹은 영역‑레벨 로컬 매칭에 머물렀다. 전자는 비진단적 배경 정보에 의해 임베딩이 좌우되고, 후자는 병변‑레벨의 미세한 진단 증거를 충분히 통합하지 못한다는 한계가 있다. 특히 의료 분야는 고품질 쌍 데이터가 부족하고, 진단 의미가 소수의 핵심 근거에 집중되는 특성이 강하다.

LGDEA는 두 단계의 핵심 메커니즘을 제시한다. 첫째, 대형 언어 모델(예: GPT‑4, LLaMA 등)을 이용해 방사선 보고서에서 “진단 근거(evidence phrase)”를 자동 추출한다. 이때 LLM은 의학적 컨텍스트를 이해하고, “양쪽 폐 기저부에 반점성 혼탁이 존재한다”와 같은 임상적으로 의미 있는 구문을 선택한다. 추출된 근거는 텍스트 인코더 f_text를 통해 임베딩 z_n 으로 변환되고, K개의 학습 가능한 진단 프로토타입 µ_k (d‑차원)와 소프트 매핑(p(k|z_n))된다. 프로토타입 재구성 손실 L_rec은 텍스트 임베딩이 프로토타입 가중합으로 복원되도록 강제함으로써, 비쌍 보고서조차도 증거‑레벨 의미를 공유 공간에 투영하도록 만든다.

둘째, 이미지 측면에서는 병변‑레벨 쿼리 q_ℓ (ℓ=1…L)을 도입해 패치‑레벨 비전 피처 I_l 에 어텐션을 적용, 잠재 병변 임베딩 v_ℓ 를 얻는다. 이 임베딩을 별도 매핑 ϕ 로 변환해 동일한 프로토타입 공간에 투사하고, 각 병변에 대한 프로토타입 분포 Q_I(ℓ,·) 를 구한다. 이미지‑보고서가 쌍인 경우, 보고서에서 추출된 근거들의 프로토타입 할당을 평균해 교사 분포 ¯Q_R 을 만든 뒤, KL 발산 L_evid^p 로 이미지의 병변 분포 ¯Q_I 와 정렬한다. 이는 명시적 병변 라벨 없이도 “진단 근거”를 이미지에 학습시킨다.

쌍이 없는 이미지에 대해서는, 동일 배치 내에서 코사인 유사도가 높은 병변들 간에 프로토타입 분포를 일관성 있게 맞추는 L_evid^u 를 적용한다. 이때 k‑최근접 이웃 N_k(i) 를 정의하고, 가중 KL 손실을 통해 근접 병변이 공유하는 진단 의미를 전파한다. 결과적으로 비쌍 이미지도 증거‑레벨 정렬에 참여하게 된다.

마지막으로, 증거‑레벨 교차 모달 정렬을 위해 고차 관계 행렬 P_ij 를 도입한다. P_ij 은 이미지 i 와 보고서 j 가 동일한 진단 근거를 공유할 확률을 나타내며, 이는 각 샘플의 증거 임베딩 H_I, H_R (프로토타입 평균) 의 내적을 통해 부드럽게 추정된다. 제한된 쌍 데이터(Y) 를 시드로 삼아, 이미지‑이미지 및 보고서‑보고서 그래프를 통해 P 를 전파함으로써, 비쌍 데이터에서도 의미 있는 교차 모달 신호를 생성한다. 최종 손실 L_evi‑align 은 증거‑가중 대조 학습 형태로, 기존 글로벌 대비 더 진단 중심적인 임베딩을 만든다.

실험에서는 MIMIC‑CXR, OpenI 등 대규모 공개 데이터셋을 활용해, 제한된 쌍 비율(예: 10% 이하)에서도 기존 CLIP‑style 및 로컬 정렬 방법보다 높은 Recall@1, mAP, 그리고 제로샷 질병 분류 정확도를 달성했다. 특히, 구문 정합(phrase grounding)에서는 근거‑레벨 매칭 정확도가 크게 향상돼, 실제 임상 워크플로우에 근접한 해석 가능성을 보여준다.

전반적으로 LGDEA는 (1) LLM 기반 텍스트 근거 추출로 고품질 진단 의미를 자동화, (2) 프로토타입 기반 공유 증거 공간으로 이미지‑텍스트를 정렬, (3) 비쌍 데이터 활용을 위한 그래프 전파와 일관성 손실을 결합함으로써, 제한된 라벨 상황에서도 강건하고 해석 가능한 의료 멀티모달 사전학습을 구현한다.

댓글 및 학술 토론

Loading comments...

의견 남기기