전역 컨텍스트 비전 트랜스포머를 활용한 고세밀 고양이 품종 인식

초록

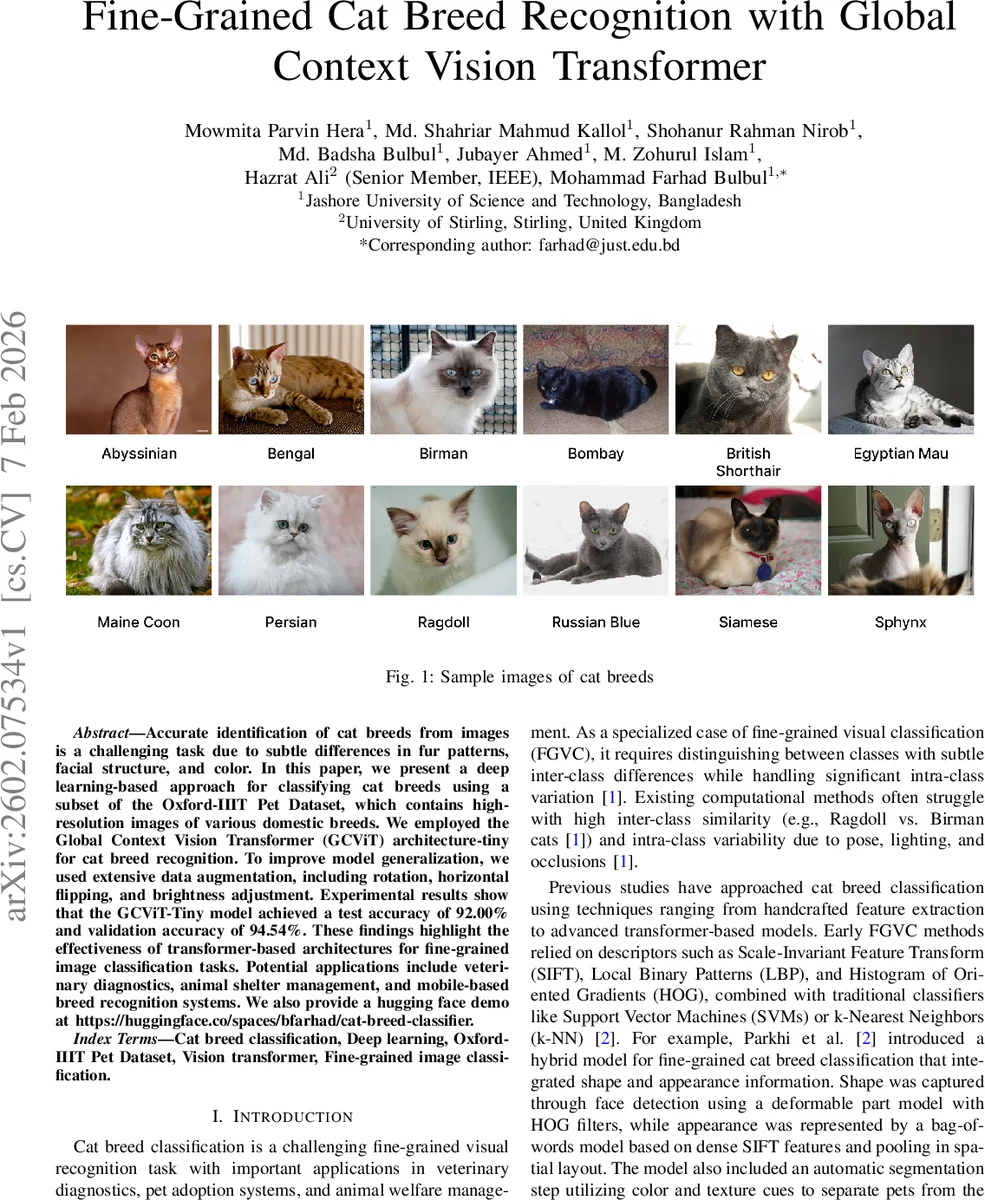

본 논문은 Oxford‑IIIT Pet 데이터셋의 고양이 품종 하위 집합에 GCViT‑Tiny 모델을 fine‑tuning하여 92 %의 테스트 정확도를 달성한 연구이다. 데이터 증강, 전처리, 글로벌 컨텍스트 어텐션을 결합한 트랜스포머 구조가 기존 CNN 기반 방법들을 크게 앞선다.

상세 분석

이 연구는 고양이 품종 구분이라는 전형적인 미세‑입체(FGVC) 문제에 Vision Transformer(ViT) 계열 중 최신 Global Context Vision Transformer(GCViT)를 적용한 점이 가장 큰 강점이다. 기존의 SIFT·HOG·CNN 기반 접근법은 지역 특징에 의존해 배경·조명·포즈 변화에 취약했지만, GCViT‑Tiny는 전역 컨텍스트 모듈(GCM)을 통해 이미지 전체의 통계적 정보를 어텐션에 직접 주입한다. 이는 특히 ‘Ragdoll’처럼 다른 품종과 시각적 유사성이 높은 클래스에서 성능 격차를 줄이는 데 기여한다.

데이터 전처리 단계에서는 이미지 크기를 224×224로 리사이즈하고, 랜덤 크롭·수평 뒤집기·20° 이하 회전·밝기·대비·채도 jitter를 적용해 모델의 일반화 능력을 강화하였다. 또한 ImageNet 평균·표준편차로 정규화함으로써 사전학습 가중치와의 호환성을 확보했다. 데이터셋은 12개 품종, 총 2,371장의 이미지로 구성되며, 80:20 비율로 훈련·검증을 나눈 뒤 1,183장의 별도 테스트 셋을 유지하였다. 층별 균형을 맞추기 위해 stratified sampling을 사용한 점은 클래스 불균형 문제를 완화한다.

GCViT‑Tiny의 구조는 먼저 convolutional stem을 통해 로컬 피처를 추출하고, 이를 16×16 패치로 분할한다. 각 패치는 선형 투영 후 위치 인코딩을 더해 입력 토큰이 된다. 이후 GCM이 삽입된 다중 계층의 self‑attention 블록을 통과하면서 전역 컨텍스트 벡터 g가 키·밸류에 가중합 형태로 결합된다. 이 설계는 전통적인 ViT가 갖는 높은 연산 비용을 유지하면서도 전역 정보를 효율적으로 활용한다.

학습은 categorical cross‑entropy에 label smoothing(ε=0.1)을 적용하고, AdamW 옵티마이저와 cosine annealing 학습률 스케줄을 사용하였다. 초기 학습률 1e‑4, weight decay 1e‑4, 배치 크기 32로 설정했으며, early stopping(patience=5)으로 10 epoch 만에 최적 모델이 수렴했다. 결과적으로 훈련 정확도는 거의 100 %에 도달했으며, 검증 정확도는 94.5 %로 안정적인 일반화가 확인되었다. 테스트 셋에서는 전체 정확도 92 %를 기록했으며, 품종별 F1‑score는 0.79(Ragdoll)에서 1.00(Sphynx)까지 다양했다. 혼동 행렬을 보면 대부분의 오분류가 시각적으로 유사한 품종 사이에 국한된다.

비교 실험에서는 기존 CNN(VGG16, InceptionV3, ResNet50)과 하이브리드 MobileViT‑v3(PetVision) 모델을 포함한 6개 방법과 정확도를 비교하였다. 가장 높은 성능을 보인 Xception(88.8 %)조차 GCViT‑Tiny(92 %)에 못 미쳤으며, 특히 경량 모델임에도 불구하고 전통적인 대형 CNN을 능가한 점이 주목할 만하다. 다만, 논문은 테스트 셋이 동일 데이터셋 내에서 추출된 점을 강조하면서도, 다른 데이터 소스(예: 실시간 모바일 촬영)에서의 검증은 부족하다. 또한 12개 품종만을 대상으로 했기 때문에, 품종 수가 늘어나면 클래스 간 구분이 더욱 어려워질 가능성이 있다.

요약하면, 전역 컨텍스트 어텐션을 도입한 GCViT‑Tiny는 미세‑입체 이미지 분류에 있어 높은 정확도와 경량성을 동시에 달성했으며, 데이터 증강·정규화·학습 스케줄링이 성능 향상에 크게 기여했다. 향후 멀티모달(이미지+텍스트) 통합, 혼합 품종 인식, 그리고 실제 모바일 디바이스에서의 실시간 추론 평가가 연구 과제로 남는다.

댓글 및 학술 토론

Loading comments...

의견 남기기